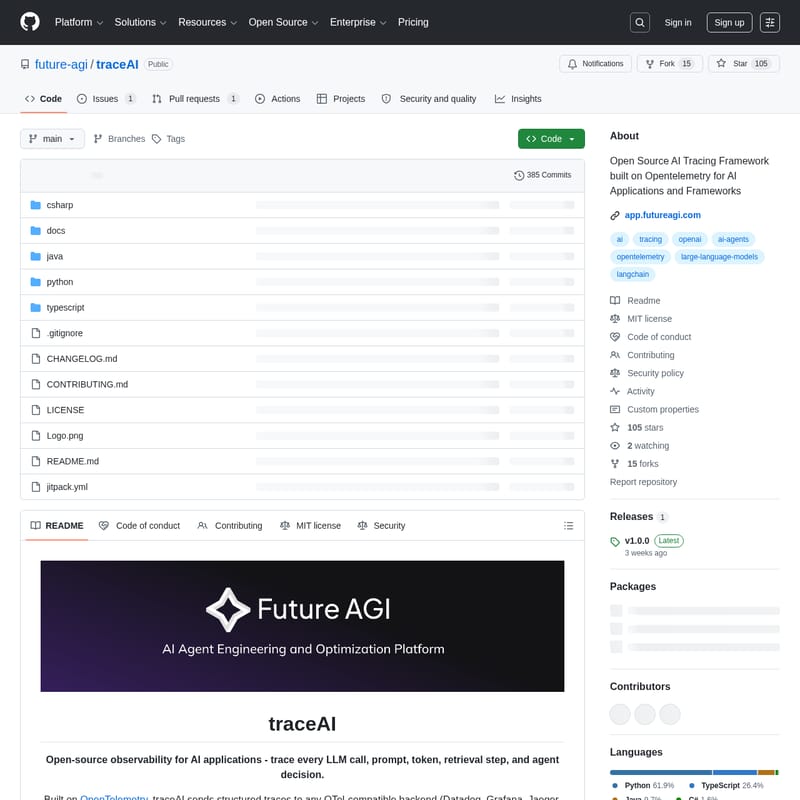

traceAI

traceAI: Open-source Observability en Tracing voor AI-applicaties gebaseerd op OpenTelemetry

traceAI is een krachtige open-source bibliotheek ontworpen voor volledige zichtbaarheid in AI-applicaties. Het stelt ontwikkelaars in staat om elke LLM-aanroep, prompt, token-gebruik en agent-beslissing te volgen via gestructureerde traces. Gebouwd op OpenTelemetry, integreert traceAI naadloos met bestaande backends zoals Datadog en Grafana zonder dat er nieuwe dashboards nodig zijn. Met ondersteuning voor meer dan 50 frameworks en talen zoals Python, TypeScript, Java en C#, biedt het een vendor-agnostische oplossing voor productie-waardige AI-monitoring.

2026-04-03

534773.1K

traceAI Productinformatie

traceAI: De Open-source Standaard voor AI Observability

In het snel evoluerende landschap van kunstmatige intelligentie is inzicht in de interne processen van applicaties cruciaal. traceAI is een geavanceerde open-source bibliotheek die speciaal is ontworpen om volledige zichtbaarheid te bieden in AI-toepassingen. Met traceAI kunt u elke LLM-aanroep, prompt, token-telling, ophaalstap (retrieval) en beslissing van AI-agents nauwkeurig traceren.

Het unieke van traceAI is dat het is gebouwd op OpenTelemetry, de industriestandaard voor applicatie-observability. Dit betekent dat u gestructureerde traces kunt verzenden naar elke OTel-compatibele backend, zoals Datadog, Grafana, Jaeger of Future AGI. Hierdoor is er geen nieuwe vendor-lock-in of een extra dashboard nodig; uw AI-telemetrie leeft direct naast uw bestaande applicatiegegevens.

Wat is traceAI?

traceAI fungeert als een transparante laag binnen uw AI-stack. Het vangt de volledige context van interacties met grote taalmodellen (LLM's) op en zet deze om in gestructureerde traces. Of u nu werkt met complexe agent-frameworks of directe API-aanroepen, traceAI zorgt ervoor dat elke stap in de workflow traceerbaar en analyseerbaar is.

Omdat traceAI OpenTelemetry-native is, maakt het gebruik van gestandaardiseerde semantische conventies voor LLM-aanroepen, vector-databases en tools. Dit biedt een consistente ervaring over verschillende programmeertalen, waaronder Python, TypeScript, Java en C#.

Belangrijkste Kenmerken van traceAI

traceAI onderscheidt zich door een uitgebreide set functies die gericht zijn op ontwikkelaars en SRE-teams:

- Gestandaardiseerde Tracing: Brengt AI-workflows in kaart met consistente OpenTelemetry-spans en attributen.

- Zero-Config Setup: Eenvoudige drop-in instrumentatie met minimale codewijzigingen voor directe resultaten.

- Multi-Framework Ondersteuning: Integratie met meer dan 50 frameworks zoals LangChain, LlamaIndex, CrewAI en meer.

- Vendor Agnostisch: Werkt probleemloos met elk systeem dat OpenTelemetry ondersteunt.

- Rijke Context: Legt niet alleen tekst vast, maar ook metadata zoals modelparameters (temperature, top_p), tokenverbruik en foutdetails.

- Productie-klaar: Geoptimaliseerd voor prestaties met ondersteuning voor asynchrone aanroepen en streaming data.

Hoe te Gebruiken

Het implementeren van traceAI is ontworpen om zo eenvoudig mogelijk te zijn voor verschillende ecosystemen.

Python

- Installeer de bibliotheek via pip:

pip install traceai-openai - Registreer de instrumentor in uw code:

from traceai_openai import OpenAIInstrumentor

from fi_instrumentation import register

# Registreer de provider

trace_provider = register(project_name="mijn_ai_app")

# Instrumenteer OpenAI

OpenAIInstrumentor().instrument(tracer_provider=trace_provider)

TypeScript

- Installeer via npm:

npm install @traceai/openai @traceai/fi-core - Initialiseer de tracing voor uw client-aanroepen:

import { OpenAIInstrumentation } from "@traceai/openai";

// Registreer instrumentatie voor de OpenAI client

Java

Voeg de dependency toe via JitPack en gebruik de TracedOpenAIClient om uw standaard client te wrappen, waarna tracing automatisch plaatsvindt.

C#

Installeer het pakket fi-instrumentation-otel via dotnet en initialiseer de FITracer met uw projectgegevens.

Ondersteunde Frameworks en Integraties

traceAI biedt een indrukwekkende compatibiliteitsmatrix over verschillende categorieën:

- LLM Providers: OpenAI, Anthropic, Google Vertex AI, AWS Bedrock, Mistral AI, Groq, Cohere en Ollama.

- Agent Frameworks: LangChain, LlamaIndex, CrewAI, AutoGen en Pydantic AI.

- Vector Databases: Pinecone, ChromaDB, Qdrant, Weaviate, Milvus en MongoDB Atlas Vector Search.

- Tools: Vercel AI SDK, Guardrails AI, Instructor en Haystack.

Gebruiksscenario's (Use Cases)

traceAI is essentieel in diverse scenario's waarbij AI wordt ingezet:

- Foutopsporing in complexe Chains: Identificeer precies waar een AI-agent vastloopt of een verkeerde afslag neemt in een multi-stap workflow.

- Kostenbeheersing: Monitor het token-gebruik per gebruiker of per verzoek om de operationele kosten van LLM-gebruik in kaart te brengen.

- Latentie-optimalisatie: Analyseer welke stappen in een RAG-proces (Retrieval-Augmented Generation) de meeste tijd in beslag nemen.

- Kwaliteitsbewaking: Inspecteer prompts en de bijbehorende antwoorden om de effectiviteit van prompt engineering te evalueren.

Veelgestelde Vragen (FAQ)

V: Moet ik een nieuw dashboard gebruiken voor traceAI?

A: Nee, dat is niet nodig. Omdat traceAI is gebouwd op OpenTelemetry, kunt u uw bestaande tools zoals Datadog, Grafana of Jaeger blijven gebruiken.

V: Welke gegevens worden precies vastgelegd?

A: traceAI legt prompts, voltooiingen (completions), token-tellingen, modelparameters, tool-aanroepen en gedetailleerde foutrapportages vast.

V: Is traceAI geschikt voor productieomgevingen?

A: Absoluut. Het ondersteunt asynchrone verwerking en streaming, en is ontworpen voor minimale impact op de prestaties van uw applicatie.

V: Kan ik traceAI gebruiken met lokale modellen?

A: Ja, via integraties met tools zoals Ollama en vLLM kunt u ook lokale modellen volledig traceren.

traceAI wordt met zorg gebouwd door het Future AGI-team en blijft zich ontwikkelen met een roadmap die onder andere ondersteuning voor de taal Go en geavanceerde sampling-strategieën bevat.