GPT‑5.3‑Codex‑Spark

GPT-5.3-Codex-Spark: Een ultrasnel AI-model voor real-time codering en directe softwareontwikkeling.

GPT-5.3-Codex-Spark is OpenAI's nieuwste mijlpaal in real-time codering. Als een compacter en sneller lid van de GPT-5.3-familie, is dit model specifiek geoptimaliseerd voor ultra-lage latentie dankzij de samenwerking met Cerebras. Met snelheden van meer dan 1000 tokens per seconde stelt Codex-Spark ontwikkelaars in staat om direct wijzigingen aan te brengen, logica te verfijnen en interfaces te herschalen zonder vertraging. Het model beschikt over een contextvenster van 128k en is ontworpen om naadloos samen te werken met de Codex-app, CLI en VS Code-extensie. Terwijl grotere modellen uitblinken in langdurige, autonome taken, richt Codex-Spark zich op de 'in-het-moment' interactie, waardoor de grens tussen menselijke creativiteit en AI-uitvoering vervaagt. Beschikbaar als research preview voor ChatGPT Pro-gebruikers, markeert het een nieuw tijdperk waarin snelheid en intelligentie samenkomen voor een ongekende ontwikkelervaring.

2026-02-15

210067.3K

GPT‑5.3‑Codex‑Spark Productinformatie

Introductie van GPT-5.3-Codex-Spark: De Toekomst van Real-Time Codering

Op 12 februari 2026 heeft OpenAI een revolutionaire stap gezet in de wereld van softwareontwikkeling met de release van GPT-5.3-Codex-Spark. Dit model is een compactere, ultrasnelle versie van de GPT-5.3-Codex en is specifiek ontworpen voor real-time interactie binnen het Codex-ecosysteem. Dankzij een strategische samenwerking met Cerebras levert de GPT-5.3-Codex-Spark prestaties die voorheen onmogelijk werden geacht, met een focus op snelheid zonder in te leveren op de krachtige capaciteiten die men van de GPT-5-serie verwacht.

Wat is GPT-5.3-Codex-Spark?

GPT-5.3-Codex-Spark is OpenAI's eerste AI-model dat volledig is geoptimaliseerd voor real-time codering. Waar eerdere modellen zoals de standaard GPT-5.3-Codex uitblinken in complexe, langdurige taken die uren of dagen kunnen duren, is de Spark-variant bedoeld voor directe samenwerking. Het model fungeert als een interactieve partner die onmiddellijk reageert op commando's, waardoor ontwikkelaars hun workflow niet hoeven te onderbreken voor laadtijden.

Het model draait op de Cerebras Wafer Scale Engine 3, een speciaal gebouwde AI-accelerator die een latentie-prioritair serverplatform biedt. Hierdoor kan GPT-5.3-Codex-Spark meer dan 1000 tokens per seconde genereren, wat resulteert in een ervaring die nagenoeg instant aanvoelt.

Belangrijkste Kenmerken van GPT-5.3-Codex-Spark

De kracht van GPT-5.3-Codex-Spark ligt in de unieke balans tussen snelheid en intelligentie. Hier zijn de belangrijkste technische specificaties en functies:

- Ultrasnelle Inference: Levert meer dan 1000 tokens per seconde, waardoor het ideaal is voor interactieve programmeersessies.

- 128k Context Window: Ondanks de snelheid kan het model grote hoeveelheden code en documentatie tegelijkertijd verwerken.

- Geoptimaliseerde Pipeline: Door gebruik van persistente WebSocket-verbindingen is de overhead per client/server-ronde met 80% verminderd en de tijd tot de eerste token (TTFT) met 50% verkort.

- Targeted Edits: Het model is getraind om minimale, gerichte aanpassingen te doen, wat de precisie in bestaande codebases verhoogt.

- Cerebras Integratie: Maakt gebruik van gespecialiseerde hardware voor taken die extreem lage latentie vereisen, naast de traditionele GPU-infrastructuur.

- Text-only Preview: In deze fase is het model volledig gericht op tekstuele code-interacties.

Use Case: Hoe GPT-5.3-Codex-Spark de Workflow Verandert

De inzetbaarheid van GPT-5.3-Codex-Spark is breed, maar komt het beste tot zijn recht in scenario's waar directe feedback cruciaal is. Ontwikkelaars kunnen het model gebruiken voor:

- Real-time Interface Verfijning: Pas UI-elementen aan en zie de codeveranderingen onmiddellijk in de Codex-app.

- Interactieve Logica-aanpassing: Terwijl u typt of brainstormt, kan de Spark-variant logische structuren herformuleren of bugs identificeren zonder dat u de editor hoeft te verlaten.

- Rapid Iteration: Perfect voor het bouwen van prototypes, zoals een snake-game of het vertalen van bestanden, waarbij snelheid belangrijker is dan diepgaande, autonome planning.

- Agentic Software Engineering: Op benchmarks zoals SWE-Bench Pro toont het model sterke prestaties door taken in een fractie van de tijd van grotere modellen te voltooien.

"Wat ons het meest opwindt aan GPT-5.3-Codex-Spark is het ontdekken van wat snelle inference mogelijk maakt—nieuwe interactiepatronen, nieuwe use cases en een fundamenteel andere modelervaring." — Sean Lie, CTO en Co-Founder van Cerebras

Hoe te Gebruiken

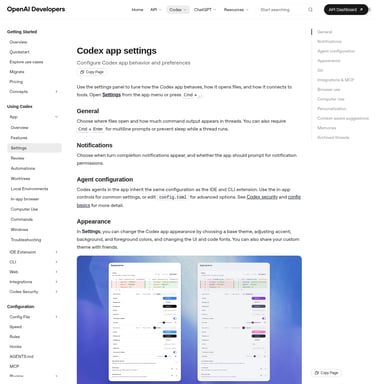

GPT-5.3-Codex-Spark is momenteel beschikbaar als research preview. Gebruikers kunnen op de volgende manieren aan de slag:

- ChatGPT Pro-abonnement: Zorg dat u een actief Pro-lidmaatschap heeft om toegang te krijgen tot de preview.

- Codex App & Extensies: Update naar de nieuwste versies van de Codex-app, de CLI of de VS Code-extensie.

- API Toegang: Voor een geselecteerde groep design partners is de Spark-variant beschikbaar via de API voor integratie in eigen producten.

- WebSocket Path: De snelle verbinding is standaard ingeschakeld voor dit model, wat zorgt voor de laagst mogelijke latentie tijdens het coderen.

Let op: Tijdens de preview-fase gelden er aparte limieten voor dit model die niet meetellen voor uw standaardlimieten, hoewel er bij extreme drukte wachtrijen kunnen ontstaan.

Veiligheid en Betrouwbaarheid

Ondanks de focus op snelheid, doet OpenAI geen concessies aan de veiligheid. GPT-5.3-Codex-Spark bevat dezelfde veiligheidstraining als de grotere modellen, inclusief specifieke training op cyber-relevante risico's. Volgens het Preparedness Framework is vastgesteld dat het model geen verhoogd risico vormt op het gebied van cybersecurity of biologie.

FAQ (Veelgestelde Vragen)

V: Is GPT-5.3-Codex-Spark gratis te gebruiken? A: Het model is momenteel beschikbaar als research preview voor ChatGPT Pro-gebruikers.

V: Ondersteunt dit model afbeeldingen of multimodale invoer? A: Op dit moment is Codex-Spark uitsluitend text-only, hoewel toekomstige versies mogelijk multimodale ondersteuning zullen krijgen.

V: Wat is het verschil tussen de standaard GPT-5.3-Codex en de Spark-versie? A: De Spark-versie is kleiner en aanzienlijk sneller (1000+ tokens/sec), specifiek gericht op real-time samenwerking, terwijl de standaardversie geoptimaliseerd is voor complexere, langdurige autonome taken.

V: Kan ik GPT-5.3-Codex-Spark gebruiken in mijn eigen editor? A: Ja, het is beschikbaar via de VS Code-extensie en de Codex CLI.

V: Telt het gebruik van Spark mee voor mijn standaard ChatGPT-limieten? A: Nee, tijdens de research preview heeft Codex-Spark eigen limieten en heeft het geen invloed op uw reguliere verbruikslimieten.