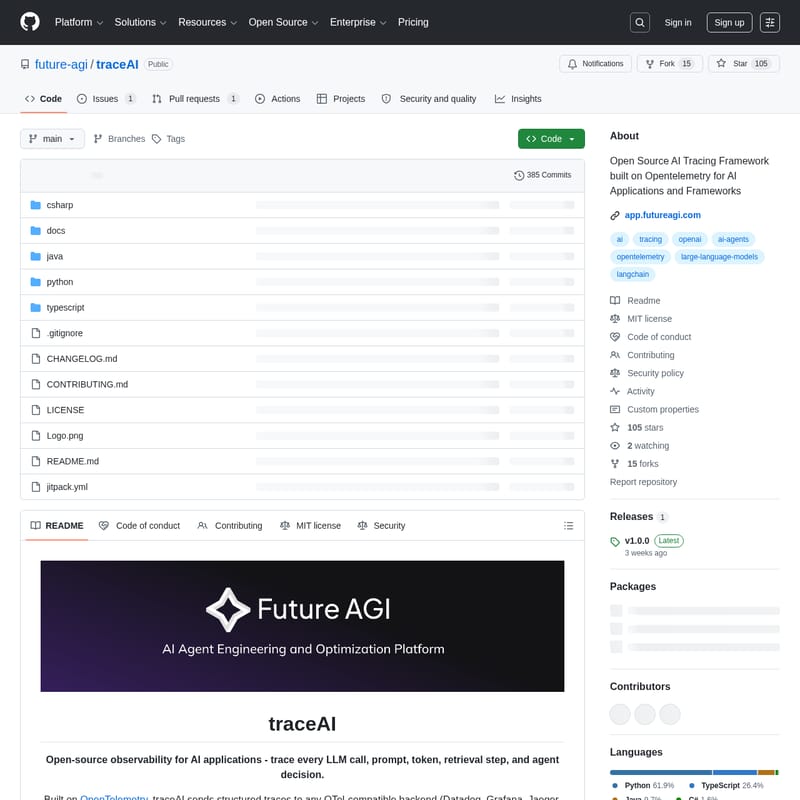

traceAI

traceAI : Observabilité open-source pour applications d'IA basée sur OpenTelemetry

traceAI est une bibliothèque d'observabilité open-source permettant de tracer chaque appel LLM, prompt, jeton et décision d'agent. Construite sur OpenTelemetry, elle s'intègre nativement avec Datadog, Grafana et Jaeger sans nécessiter de nouveau tableau de bord. Elle supporte plus de 50 frameworks d'IA sur Python, TypeScript, Java et C#, offrant une visibilité complète sur les workflows d'IA en production.

2026-04-03

534773.1K

traceAI Informations sur le produit

Optimisez votre Observabilité IA avec traceAI

Dans le paysage technologique actuel, la surveillance des applications basées sur l'intelligence artificielle est devenue cruciale. traceAI se positionne comme la solution leader en tant que bibliothèque d'observabilité open-source dédiée aux applications d'IA. Elle permet de tracer avec précision chaque appel de grand modèle de langage (LLM), chaque prompt, le comptage des jetons (tokens), les étapes de récupération (retrieval) et les décisions prises par les agents autonomes.

Construit sur les fondations solides d'OpenTelemetry, le standard de l'industrie pour l'observabilité, traceAI envoie des traces structurées vers n'importe quel backend compatible OTel, tel que Datadog, Grafana, Jaeger ou Future AGI. L'avantage majeur est qu'il ne nécessite aucun nouveau fournisseur ni aucun tableau de bord supplémentaire : vos traces d'IA vivent nativement au sein de vos outils existants.

Qu'est-ce que traceAI ?

traceAI est une bibliothèque conçue pour offrir une visibilité totale sur vos workflows d'IA. En capturant les données de télémétrie de manière structurée, traceAI transforme les interactions opaques des LLM en informations exploitables. Que vous utilisiez Python, TypeScript, Java ou C#, cette solution propose des API cohérentes pour instrumenter vos applications avec une configuration minimale.

Grâce à son architecture native OpenTelemetry, traceAI respecte les conventions sémantiques pour les appels LLM, les outils et les bases de données vectorielles, garantissant une intégration fluide dans les environnements de production.

Caractéristiques principales de traceAI

L'outil se distingue par une série de fonctionnalités robustes adaptées aux besoins des développeurs d'IA modernes :

- Traçage Standardisé : Associe les flux de travail d'IA à des spans et attributs OpenTelemetry cohérents.

- Configuration Zéro (Zero-Config) : Une instrumentation prête à l'emploi nécessitant des modifications de code minimales.

- Multi-Framework : Plus de 50 intégrations disponibles pour Python, TypeScript, Java et C#.

- Agnostique vis-à-vis des Fournisseurs : Compatible avec tout backend supportant OpenTelemetry.

- Contexte Enrichi : Capture les prompts, les complétions, le nombre de jetons, les paramètres du modèle, les appels d'outils et bien plus.

- Prêt pour la Production : Supporte l'asynchronisme, le streaming, la gestion des erreurs et l'optimisation des performances.

Comment utiliser traceAI (Quickstart)

L'installation et la mise en œuvre de traceAI sont simples et varient selon votre langage de programmation.

Utilisation avec Python

-

Installation :

pip install traceai-openai -

Instrumentation :

import os from fi_instrumentation import register from traceai_openai import OpenAIInstrumentor import openai # Enregistrement du fournisseur de traces trace_provider = register(project_name="mon_application_ia") # Instrumentation automatique OpenAIInstrumentor().instrument(tracer_provider=trace_provider)

Utilisation avec TypeScript

-

Installation :

npm install @traceai/openai @traceai/fi-core -

Instrumentation :

import { register } from "@traceai/fi-core"; import { OpenAIInstrumentation } from "@traceai/openai"; import { registerInstrumentations } from "@opentelemetry/instrumentation"; const tracerProvider = register({ projectName: "mon_app_ia" }); registerInstrumentations({ tracerProvider, instrumentations: [new OpenAIInstrumentation()], });

Cas d'utilisation de traceAI

traceAI est polyvalent et s'adapte à divers scénarios de développement d'IA :

- Débogage de Chaînes d'Agents : Suivez les décisions prises par des frameworks comme LangChain, LlamaIndex ou CrewAI pour comprendre le raisonnement des agents.

- Optimisation des Coûts : Surveillez la consommation de jetons (tokens) en temps réel pour chaque utilisateur ou application.

- Analyse de Latence : Identifiez les étapes de récupération (retrieval) lentes dans vos architectures RAG (Retrieval-Augmented Generation).

- Surveillance de Bases de Données Vectorielles : Intégrez le traçage pour Pinecone, ChromaDB, Weaviate ou Milvus afin de mesurer l'efficacité de vos recherches vectorielles.

Frameworks et Compatibilité

traceAI supporte une vaste gamme de fournisseurs et d'outils :

- Fournisseurs LLM : OpenAI, Anthropic, Google Vertex AI, AWS Bedrock, Mistral AI, Groq, Ollama, et plus.

- Frameworks d'Agents : LangChain, LlamaIndex, AutoGen, Spring AI, Semantic Kernel.

- Bases de Données Vectorielles : Pinecone, Qdrant, MongoDB Atlas, Redis Vector Search, pgvector.

FAQ (Foire Aux Questions)

Q : traceAI nécessite-t-il l'utilisation d'un nouveau tableau de bord ? R : Non. Comme traceAI est basé sur OpenTelemetry, il envoie vos données vers vos outils existants comme Grafana ou Datadog.

Q : Quels langages sont supportés par traceAI ? R : Actuellement, traceAI supporte Python, TypeScript, Java et C#. Le support pour Go est prévu dans la feuille de route.

Q : Est-ce que traceAI capture le contenu des prompts ? R : Oui, traceAI capture les prompts complets, les complétions ainsi que les paramètres du modèle (température, top_p, etc.).

Q : traceAI est-il compatible avec le streaming ? R : Oui, il gère les flux de données (streaming) avec un suivi précis des deltas et des jetons.

Note importante : traceAI est un projet open-source sous licence MIT, développé par l'équipe de Future AGI pour standardiser l'observabilité de l'IA.