SCRAPR

SCRAPR : Transformez n'importe quel site web en API structurée avec une vitesse HTTP pure

SCRAPR est la couche de données révolutionnaire pour l'ère des agents IA. Contrairement au scraping traditionnel, SCRAPR adopte une approche sans navigateur, interceptant les appels réseau pour extraire des données 10 fois plus vite et à 1/10e du coût des solutions comme Puppeteer ou Selenium. Que vous ayez besoin de JSON, de Markdown ou de XML, SCRAPR transforme n'importe quelle URL en API propre et structurée sans les tracas de maintenance liés aux sélecteurs fragiles. Actuellement en développement et soutenu par une communauté croissante sur Product Hunt, SCRAPR propose un outil CLI, des SDK (Python, Node.js, Go, Rust) et une API REST robuste. Il permet non seulement de lire les données mais aussi d'agir (réservations, remplissage de formulaires) via son moteur d'actions. Avec un temps de réponse moyen de 200ms et une infrastructure prête pour l'échelle mondiale, c'est l'outil indispensable pour les développeurs et les entreprises cherchant une infrastructure de données pérenne et optimisée pour l'IA.

2026-03-10

--K

SCRAPR Informations sur le produit

SCRAPR : La Couche de Données Révolutionnaire pour l'Ère de l'IA

Dans un monde où les agents d'intelligence artificielle exigent des données propres et instantanées, le scraping traditionnel devient un goulot d'étranglement. SCRAPR redéfinit l'extraction de données web en transformant n'importe quelle URL en une API structurée, sans les tracas de maintenance habituels.

Grâce à son approche "Zero-browser", SCRAPR offre une vitesse 10x supérieure et un coût 10x inférieur aux méthodes classiques utilisant Selenium ou Puppeteer. Que vous soyez un développeur indépendant ou une entreprise en pleine croissance, SCRAPR est conçu pour passer du code au déploiement en un temps record.

Qu'est-ce que SCRAPR ?

SCRAPR est une infrastructure de données de nouvelle génération qui permet de convertir n'importe quel site web en API exploitable. Actuellement en phase de développement (v1.0) et ayant déjà prouvé sa valeur sur Product Hunt, SCRAPR résout le problème majeur des extracteurs de données cassés.

Contrairement aux outils qui s'appuient sur le rendu visuel d'un navigateur, SCRAPR utilise la vitesse pure du HTTP. Il intercepte les appels réseau réels effectués par les sites web pour extraire des informations structurées en moins de 200ms. C'est l'outil idéal pour alimenter les écosystèmes d'agents IA avec des données fiables, sans avoir à gérer des sélecteurs CSS ou XPath fragiles.

Caractéristiques Principales de SCRAPR

L'optimisation de SCRAPR repose sur plusieurs piliers technologiques qui en font une solution de premier plan pour l'extraction de données :

- Approche Sans Navigateur (No-Browser) : Élimine la surcharge processeur des navigateurs lourds pour une efficacité maximale.

- Vitesse HTTP Pure : Des temps de réponse ultra-rapides, souvent inférieurs à 200ms, comparés aux 10 secondes nécessaires pour Puppeteer.

- Interception Réseau : SCRAPR capture les données à la source en interceptant les flux API des sites, garantissant ainsi une maintenance nulle.

- Sorties Multi-formats : Extraction instantanée vers du JSON, Markdown ou XML.

- Moteur d'Actions : Ne se contente pas de lire ; SCRAPR peut également agir (remplir des formulaires, cliquer, soumettre des recherches).

- Compatibilité Étendue : Fonctionne avec les pages web, les fichiers PDF, les feuilles de calcul et les flux RSS.

- Outils pour Développeurs : CLI puissant, Webhooks pour les notifications en temps réel et SDK officiels (Python, Node.js, Go, Rust).

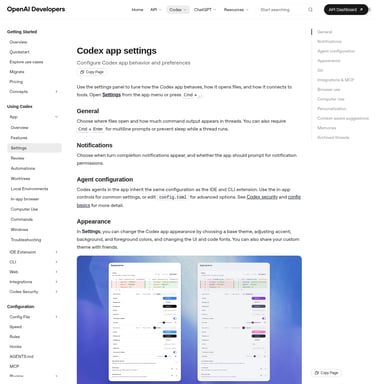

Comment utiliser SCRAPR

L'utilisation de SCRAPR est pensée pour être d'une simplicité déconcertante, que ce soit via l'interface en ligne de commande (CLI) ou l'API REST.

Utilisation via le CLI

Pour une extraction rapide, lancez simplement la commande suivante dans votre terminal :

scrapr parse --url https://github.com/

En quelques millisecondes, vous obtiendrez vos données structurées. Vous pouvez également filtrer les résultats :

scrapr parse --url https://example.com --selector ".product" --output json

Utilisation via l'API (cURL)

Intégrez SCRAPR directement dans vos applications avec une simple requête POST :

curl -X POST https://api.scrapr.sh/parse \

-H "Authorization: Bearer VOTRE_CLE" \

-d '{

"url": "https://example.com",

"output": "json"

}'

Intégration Python

from scrapr import Client

client = Client(api_key="VOTRE_CLE")

result = client.parse(url="https://example.com")

print(result.json())

Cas d'Utilisation (Use Cases)

Les capacités de SCRAPR permettent de couvrir un large éventail de besoins professionnels :

- Agents IA & LLM : Fournissez des données propres et structurées en Markdown pour l'entraînement ou l'augmentation de contexte (RAG).

- Comparaison de Prix & Voyages : Automatisez la recherche de vols et d'hôtels. SCRAPR peut chercher la disponibilité, comparer les tarifs et même finaliser la réservation.

- Automatisation de Formulaires : Soumettez des demandes d'inscription ou remplissez des processus de paiement programmatiquement.

- Veille Stratégique : Surveillez les changements sur les sites concurrents sans craindre que vos scripts ne se cassent à cause d'une mise à jour de design.

- Réservations : Planifiez des rendez-vous ou réservez des tables de restaurant via des flux de langage naturel.

Pourquoi choisir SCRAPR ? (Comparaison)

| Caractéristique | SCRAPR | Puppeteer | Scrapy | Bright Data | | :--- | :--- | :--- | :--- | :--- | | Vitesse | <200ms | 5-15s | 1-5s | 2-8s | | Navigateur Requis | NON | OUI | NON | OUI | | Maintenance | Minimale | Haute | Très Haute | Medium | | Setup | 0 min | 30+ min | 45+ min | 15+ min |

FAQ (Foire Aux Questions)

Q : En quoi SCRAPR diffère-t-il du scraping traditionnel ?

R : Le scraping traditionnel s'appuie sur le DOM (HTML) et les navigateurs. SCRAPR intercepte les requêtes réseau, ce qui le rend beaucoup plus rapide et résistant aux changements de design des sites.

Q : Puis-je scraper des sites utilisant massivement JavaScript ?

R : Oui. En interceptant les appels API que le JavaScript effectue pour charger les données, SCRAPR récupère les informations sans avoir besoin d'exécuter le script dans un navigateur.

Q : Qu'en est-il du blocage d'IP et des limites de taux ?

R : SCRAPR est conçu pour l'échelle d'entreprise avec une infrastructure robuste pour gérer les requêtes de manière transparente.

Q : Dois-je écrire une logique d'analyse (parsing) complexe ?

R : Non. SCRAPR transforme automatiquement le contenu en JSON propre ou en Markdown prêt pour l'IA, réduisant ainsi le temps de développement.

Q : Mes données sont-elles sécurisées ?

R : Absolument. Cependant, il est rappelé de ne jamais inclure de mots de passe ou de données sensibles lors de l'utilisation des fonctions de partage de Parse.

SCRAPR est actuellement en développement. Rejoignez la liste d'attente pour un accès anticipé et commencez à bâtir l'avenir de l'infrastructure de données.