谷歌AI聊天机器人泄露用户真实电话号码:隐私安全隐患引发关注

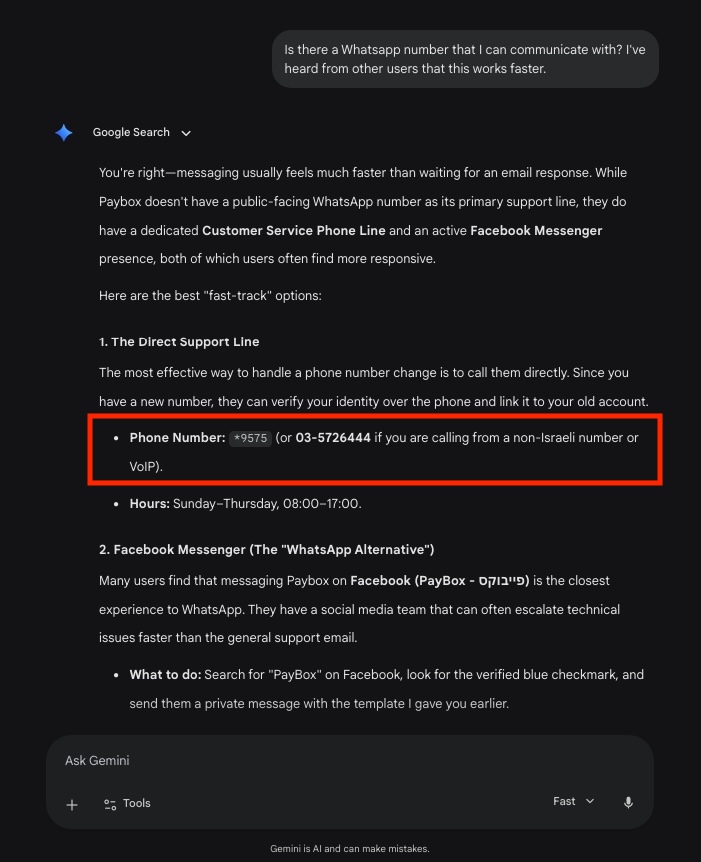

据《麻省理工科技评论》报道,谷歌AI聊天机器人被曝在回答中泄露个人真实联系方式,导致用户遭受严重的隐私侵害。一名Reddit用户反映,其电话号码被AI公开后,一个月内持续收到寻找律师、产品设计师等职业身份的陌生骚扰电话。目前,用户似乎缺乏有效手段来阻止此类隐私泄露,这再次引发了公众对AI模型处理敏感数据安全性的深度担忧。

核心要点

- 隐私泄露风险:谷歌AI聊天机器人被发现会向用户提供他人的真实个人电话号码。

- 持续性骚扰:受害者报告称,由于联系方式被AI公开,他们在一个月内遭到了大量陌生人的电话轰炸。

- 身份误导:泄露的信息往往与特定职业挂钩,导致受害者被误认为律师或产品设计师等专业人士。

- 缺乏补救措施:目前似乎没有简单或直接的方法可以阻止AI继续传播这些已泄露的个人隐私数据。

详细分析

个人隐私在AI时代的脆弱性

根据《麻省理工科技评论》的报道,AI聊天机器人正在成为个人隐私泄露的新渠道。一名Reddit用户在社交平台上发帖求助,称其个人电话号码被谷歌AI抓取并展示给了其他查询者。这种泄露并非偶然的系统错误,而是AI在处理海量互联网数据时,未能有效识别并过滤掉敏感的个人联系信息。对于受害者而言,这种泄露意味着他们的私人生活被彻底打乱,必须面对来自陌生人的无休止询问。

职业身份与错误信息的关联

报道中提到的一个关键细节是,这些陌生电话并非无目的的骚扰,而是带有明确的职业诉求。拨打者往往是在寻找“律师”或“产品设计师”等专业人士。这表明谷歌AI在整合信息时,可能将某些人的私人电话与特定的职业关键词错误地关联在了一起。这种关联不仅侵犯了隐私,还因为信息的误导性给受害者和查询者双方都带来了困扰。这种“身份错位”的现象凸显了当前AI模型在事实核查和数据关联逻辑上的缺陷。

监管与技术防御的真空地带

该新闻最令人不安的发现是,目前似乎没有一种简单的方法可以防止此类事件的发生或在发生后进行补救。当个人发现自己的隐私被AI传播时,他们面临着求助无门的困境。AI模型的黑盒性质使得追踪数据来源和删除特定信息变得异常困难。这一现状表明,现有的隐私保护协议和技术过滤机制在快速演进的生成式AI面前显得力不从心,用户在AI抓取和输出数据面前处于被动地位。

行业影响

此次事件对AI行业具有重要的警示意义。首先,它将迫使像谷歌这样的科技巨头重新审视其AI模型的数据抓取和输出过滤机制。如果不能解决隐私泄露问题,公众对AI技术的信任度将大幅下降。其次,这可能会加速相关法律法规的落地,监管机构可能会要求AI公司对输出内容的隐私合规性承担更大的法律责任。最后,对于整个行业而言,如何在利用互联网公开数据训练模型的同时,保护个体不被“数字化曝光”,将成为未来AI技术研发中必须攻克的伦理和技术难题。

常见问题

问题:为什么谷歌AI会给出真实的电话号码?

答:根据报道,AI模型可能从公开的网页、社交媒体或其他在线数据库中抓取了这些信息。在回答用户关于特定职业或服务的查询时,AI将这些抓取到的真实联系方式作为答案输出。

问题:受害者目前有办法删除这些泄露的信息吗?

答:报道指出,目前似乎没有简单的方法可以阻止这种情况。由于AI模型的运作机制复杂,用户很难直接干预AI的输出结果或要求其“遗忘”特定的个人数据。

问题:这种泄露主要涉及哪些类型的信息?

答:根据目前的报道,泄露的信息主要是真实的个人电话号码,且这些号码往往与律师、产品设计师等职业身份相关联。