AWS 基础模型训练与推理构建模块:Hugging Face 官方指南

Hugging Face 博客发布了关于在 AWS 环境下构建、训练及推理基础模型(Foundation Models)的核心构建模块指南。该内容聚焦于如何利用 AWS 的基础设施优化大规模 AI 模型的全生命周期管理,旨在为开发者提供高效的云端模型部署方案。

核心要点

- 聚焦 AWS 平台:探讨在 Amazon Web Services 基础设施上构建基础模型的技术路径。

- 全生命周期覆盖:内容涵盖了从模型训练(Training)到推理(Inference)的关键阶段。

- 官方技术指导:由 Hugging Face 发布,体现了开源生态与主流云服务商的深度集成。

详细分析

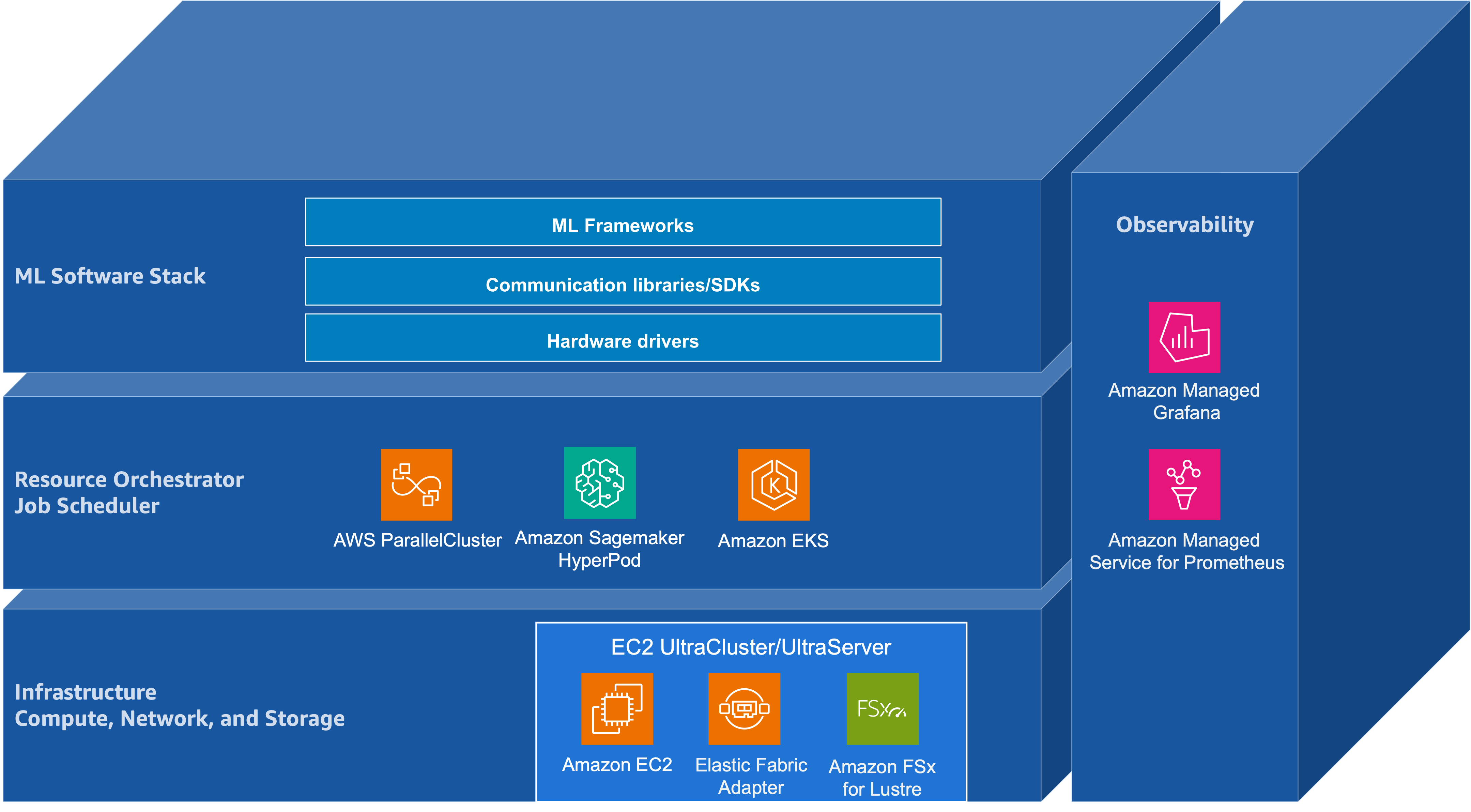

AWS 上的基础模型构建环境

根据 Hugging Face 发布的信息,该指南重点介绍了在 AWS 云端构建基础模型(Foundation Models)所需的“构建模块”。基础模型因其规模庞大,对计算、存储和网络资源有着极高的要求。AWS 提供的弹性计算资源为这些模型的开发提供了必要的基础设施支持。

训练与推理的协同优化

文章标题明确指出了“训练”与“推理”两个核心环节。在训练阶段,重点在于如何高效利用大规模 GPU 资源或专用加速器;而在推理阶段,则侧重于如何降低延迟并提高吞吐量。Hugging Face 提供的这些构建模块旨在简化开发者在 AWS 上配置这些复杂流程的难度。

行业影响

此消息反映了 AI 行业中云服务提供商与开源模型平台之间日益紧密的合作趋势。通过提供标准化的构建模块,Hugging Face 和 AWS 正在降低企业级基础模型的开发门槛,推动大规模 AI 应用从实验室走向生产环境。这对于希望在云端快速部署定制化 AI 解决方案的企业具有重要的参考价值。

常见问题

什么是基础模型(Foundation Models)?

基础模型是指在大规模数据上进行预训练,并可以适应多种下游任务的 AI 模型(如 GPT 系列、Llama 系列等)。它们通常作为构建特定应用的基础。

为什么在 AWS 上进行模型训练和推理?

AWS 提供了可扩展的计算实例(如 P4/P5 实例)以及专门的 AI 芯片(如 Trainium 和 Inferentia),能够满足基础模型对高性能计算和成本效益的双重需求。