AI评估正成为新的算力瓶颈:Hugging Face揭示模型开发新挑战

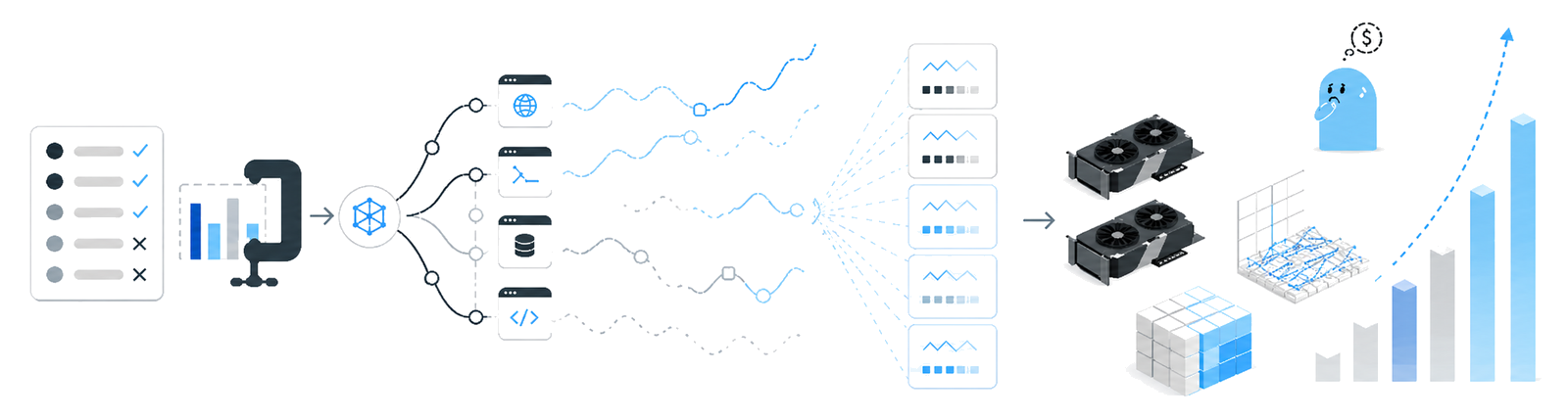

根据Hugging Face发布的最新观点,AI评估(Evals)正逐渐取代模型训练,成为AI研发过程中的主要算力瓶颈。随着大语言模型规模的持续增长,验证模型性能、安全性和准确性所需的计算资源急剧上升。这一趋势表明,AI行业的关注点正在从“如何训练模型”转向“如何高效验证模型”,算力资源的分配格局正面临重大调整。

核心要点

- 算力重心转移:AI评估过程消耗的计算资源正在迅速增加,逐渐成为制约研发速度的新瓶颈。

- 评估复杂度提升:随着模型能力的增强,传统的自动化评测已不足以覆盖所有场景,复杂评估对算力的需求呈指数级增长。

- 研发周期受阻:由于评估环节的算力受限,模型迭代的速度受到直接影响,开发者面临资源分配的新难题。

- 行业范式转变:行业正在从关注训练效率转向关注评估效率,寻找更经济的验证方案成为当务之急。

详细分析

评估环节为何成为算力“吞金兽”

在AI开发的早期阶段,算力瓶颈主要集中在模型的预训练环节。然而,根据Hugging Face的观察,这一情况正在发生显著变化。AI评估(Evals)——即通过大量的测试集和基准测试来衡量模型表现的过程——正在消耗越来越多的算力。这主要是因为现代模型不仅需要进行基础的逻辑和语言测试,还需要在多模态、长文本处理以及安全性等多个维度进行详尽验证。每一次模型的微小改动,往往都需要重新运行全套评估流程,这种高频且高强度的计算需求直接导致了算力的紧张。

从训练瓶颈到评估瓶颈的转变

过去,算力资源主要被投入到GPU集群的并行训练中。但随着模型架构的趋同和训练技术的成熟,评估环节的低效开始显现。评估不仅涉及大规模推理任务,还往往包含复杂的打分机制(如使用更强的模型作为裁判来评估较弱模型的输出)。这种“模型评测模型”的模式虽然提高了自动化程度,但也成倍增加了对高性能计算资源的依赖。当评估速度跟不上训练速度时,整个研发流水线就会发生拥堵,评估环节正式成为新的算力瓶颈。

资源分配的策略性调整

面对评估算力瓶颈,AI行业不得不重新审视资源分配策略。开发者不再仅仅追求更大的训练集群,而是开始思考如何优化评估架构。这包括开发更轻量级的评估基准、引入抽样评估技术以及优化推理引擎以降低评估成本。Hugging Face的这一发现提醒行业,如果不能有效解决评估环节的算力消耗问题,即使拥有再强大的训练能力,也难以实现模型的快速迭代和高质量产出。

行业影响

该新闻揭示了AI基础设施需求的新动向。首先,对于算力提供商而言,推理和评估优化的硬件需求将持续增长。其次,对于模型开发者,评估工具链的效率将成为核心竞争力。此外,这也可能催生出一批专门从事高效评估技术研发的初创企业,推动AI评估方法论的革新。整个行业将更加重视“评估经济学”,即如何在有限的算力预算内,获得最准确的模型性能反馈。

常见问题

问题 1:为什么AI评估会比训练更早遇到算力瓶颈?

虽然训练消耗的总算力巨大,但评估发生在模型开发的每一个微小迭代中。随着测试基准(Benchmarks)的增加和模型推理成本的上升,累积的评估算力需求增长速度极快,且评估任务往往对实时反馈有更高要求,因此更容易在研发流程中形成感官上的瓶颈。

问题 2:如何缓解评估环节的算力压力?

行业目前正在探索多种方案,包括:1. 开发更具代表性的小规模测试集;2. 使用量化技术降低评估时的推理成本;3. 采用更高效的自动化评估框架,减少不必要的重复计算。

问题 3:这一趋势对开源社区有何影响?

对于开源社区而言,评估算力瓶颈意味着个人开发者或小型团队在验证大型模型时将面临更高门槛。这可能促使社区更加依赖像Hugging Face这样的平台提供标准化的、低成本的评估工具和共享算力资源。