LangChain 创始人解析 AI 智能体持续学习的三大核心层级

LangChain 创始人 Harrison Chase 提出,AI 智能体的持续学习不应仅局限于模型权重的更新。他指出,智能体的进化发生在三个关键层级:模型层、架构层(Harness)和上下文层。这一视角为构建能够随时间自我改进的 AI 系统提供了全新的思考框架,重新定义了智能体学习的维度。

核心要点

- 超越权重更新:传统的持续学习侧重于模型参数调整,但对 AI 智能体而言,这只是维度之一。

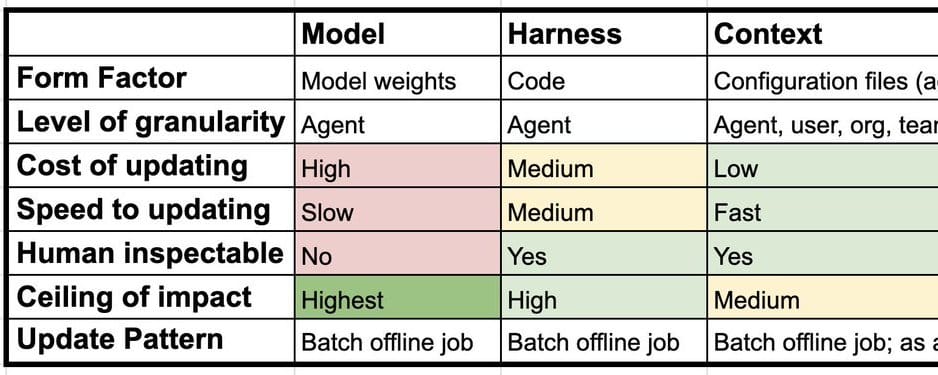

- 三大核心层级:AI 智能体的学习发生在模型(Model)、架构(Harness)和上下文(Context)三个不同层面。

- 系统化改进:理解这三个层级的差异,是构建能够随时间推移不断优化的 AI 系统的关键。

详细分析

重新定义 AI 智能体的学习维度

在当前的 AI 讨论中,持续学习(Continual Learning)往往被等同于模型权重的微调或更新。然而,Harrison Chase 指出,对于 AI 智能体(AI Agents)而言,学习的范畴要广阔得多。智能体不仅仅是一个静态的模型,而是一个在特定环境中运行的动态系统。这意味着,智能体的进步不仅取决于其底层模型的能力提升,还取决于其运行框架和处理信息的方式。

学习的三大关键层级

根据原文,AI 智能体的学习可以划分为三个截然不同的层级:

- 模型层(Model):这是最基础的层面,涉及底层大语言模型本身的知识更新和能力演进。

- 架构层(Harness):指围绕模型构建的逻辑框架、工具调用机制和决策流程。通过优化这一层,可以改变智能体与外部世界交互的方式。

- 上下文层(Context):涉及智能体在特定任务或对话中积累的短期和长期记忆。通过更有效地利用上下文信息,智能体能够实现事实上的“学习”和行为改进。

行业影响

这一观点的提出对 AI 行业具有重要的指导意义。它提醒开发者和研究人员,在追求更强大的基础模型的同时,不应忽视智能体架构和上下文管理的重要性。通过在架构层和上下文层进行创新,开发者可以在不频繁重新训练模型的情况下,实现智能体性能的显著提升。这种多层级的学习模型为构建更具适应性和进化能力的 AI 应用提供了清晰的路线图。

常见问题

问题:AI 智能体的持续学习与传统模型的持续学习有何不同?

传统模型学习主要关注模型权重的更新,而 AI 智能体的持续学习是一个多维过程,涵盖了模型、架构(Harness)以及上下文(Context)三个层面的协同进化。

问题:为什么理解这三个层级对开发者很重要?

理解这些差异可以改变开发者构建系统的方式。它促使开发者不再单一依赖模型微调,而是通过优化架构逻辑和上下文处理,来创建能够随时间推移不断自我改进的更高效系统。