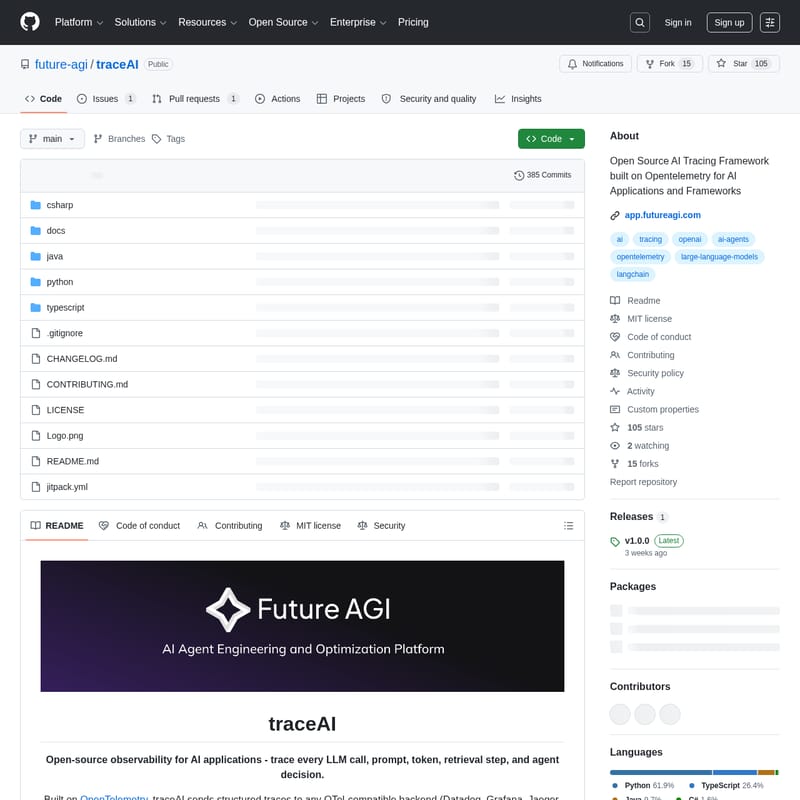

traceAI

traceAI: Open-source платформа для мониторинга AI-приложений на базе OpenTelemetry

traceAI — это мощная библиотека с открытым исходным кодом для обеспечения полной наблюдаемости (observability) AI-приложений. Она позволяет отслеживать каждый вызов LLM, промпты, токены и решения агентов, используя стандарт OpenTelemetry для интеграции с Datadog, Grafana и другими бэкендами.

2026-04-03

534773.1K

traceAI Информация о продукте

traceAI: Профессиональный мониторинг и наблюдаемость для AI-приложений

В современной разработке систем на базе искусственного интеллекта критически важно понимать, что происходит внутри каждой итерации работы модели. traceAI — это передовое решение с открытым исходным кодом, предназначенное для обеспечения полной наблюдаемости (observability) ваших AI-приложений. Инструмент позволяет отслеживать каждый вызов LLM, содержание промптов, количество использованных токенов, этапы поиска информации (retrieval) и логику принятия решений агентами.

Построенный на фундаменте OpenTelemetry, traceAI обеспечивает бесшовную интеграцию с уже существующими инструментами мониторинга, такими как Datadog, Grafana, Jaeger и Future AGI. Это исключает необходимость внедрения новых проприетарных панелей управления, позволяя вашим AI-трассировкам жить нативно в привычной инфраструктуре.

Что такое traceAI?

traceAI представляет собой библиотеку, которая предоставляет разработчикам полный контроль над жизненным циклом работы нейросетевых моделей. Она преобразует взаимодействие с LLM в структурированные трассировки, которые легко анализировать и интерпретировать.

Основная философия проекта — отсутствие привязки к конкретному поставщику (vendor-agnostic). Поскольку библиотека использует отраслевой стандарт OpenTelemetry, вы можете отправлять данные в любой OTel-совместимый бэкенд. traceAI поддерживает более 50 AI-фреймворков и доступен для четырех основных языков программирования: Python, TypeScript, Java и C#.

Основные возможности traceAI

Библиотека обладает широким набором функций для профессиональной разработки:

- Стандартизированная трассировка: Преобразование рабочих процессов AI в согласованные спаны и атрибуты OpenTelemetry.

- Настройка с нулевой конфигурацией: Возможность внедрения инструмента с минимальными изменениями в исходном коде.

- Мультиплатформенность: Поддержка интеграций для Python, TypeScript, Java и C# с идентичными API.

- Богатый контекст данных: Захват промптов, завершений (completions), метаданных моделей, параметров (temperature, top_p) и вызовов инструментов.

- Готовность к продакшну: Поддержка асинхронности, стриминга данных, обработки ошибок и оптимизация производительности.

- Поддержка векторных баз данных: Трассировка операций в Pinecone, ChromaDB, Qdrant, Milvus и других.

Как использовать traceAI

Внедрение traceAI в проект максимально упрощено. Ниже приведены примеры для различных языков программирования.

Python

-

Установите необходимый пакет:

pip install traceai-openai -

Настройте инструменты в коде:

import os

from fi_instrumentation import register

from fi_instrumentation.fi_types import ProjectType

from traceai_openai import OpenAIInstrumentor

import openai

# Регистрация провайдера трассировки

trace_provider = register(

project_type=ProjectType.OBSERVE,

project_name="my_ai_app"

)

# Инструментирование OpenAI

OpenAIInstrumentor().instrument(tracer_provider=trace_provider)

# Используйте OpenAI как обычно — мониторинг работает автоматически!

TypeScript

-

Установите зависимости:

npm install @traceai/openai @traceai/fi-core -

Инициализируйте систему:

import { register, ProjectType } from "@traceai/fi-core";

import { OpenAIInstrumentation } from "@traceai/openai";

import { registerInstrumentations } from "@opentelemetry/instrumentation";

const tracerProvider = register({

projectName: "my_ai_app",

projectType: ProjectType.OBSERVE,

});

registerInstrumentations({

tracerProvider,

instrumentations: [new OpenAIInstrumentation()],

});

Java

Используйте JitPack для добавления зависимости и инициализируйте клиент:

import ai.traceai.core.TraceAI;

import ai.traceai.openai.TracedOpenAIClient;

TraceAI.init("my_ai_app", "your-api-key", "your-secret-key");

var tracedClient = new TracedOpenAIClient(openAIClient);

C#

Установите пакет через NuGet и выполните инициализацию:

using FIInstrumentation;

var tracer = FITracer.Initialize(new FITracerOptions

{

ProjectName = "my_ai_app",

ApiKey = "your-api-key",

SecretKey = "your-secret-key"

});

Сценарии использования

traceAI идеально подходит для решения следующих задач:

- Отладка сложных агентов: Визуализация цепочки решений, которые принимает агент (например, в LangChain или CrewAI).

- Оптимизация затрат: Мониторинг использования токенов в режиме реального времени для контроля расходов на API.

- Анализ качества ответов: Сохранение промптов и ответов для последующей оценки и тонкой настройки моделей.

- Мониторинг производительности: Измерение задержек (latency) на каждом этапе — от поиска в векторной базе данных до генерации финального текста.

- Безопасность и аудит: Полное логирование всех взаимодействий с внешними LLM провайдерами.

Часто задаваемые вопросы (FAQ)

В: Нужно ли мне использовать новый дашборд для просмотра данных? О: Нет. traceAI отправляет данные в формате OpenTelemetry. Вы можете использовать привычные инструменты, такие как Grafana или Datadog.

В: Какие фреймворки поддерживает traceAI? О: Библиотека поддерживает более 50 интеграций, включая LangChain, LlamaIndex, OpenAI, Anthropic, Google Vertex AI, Pinecone и многие другие.

В: Влияет ли traceAI на производительность приложения? О: Инструмент оптимизирован для высоконагруженных систем, поддерживает асинхронную передачу данных и минимально влияет на задержки.

В: Можно ли использовать traceAI со своей конфигурацией OpenTelemetry?

О: Да, вы можете передавать собственные TracerProvider и процессоры спанов в Python и TypeScript версиях.

traceAI — это проект, созданный командой Future AGI с заботой о разработчиках. Используйте мощь открытых стандартов для создания надежных и прозрачных AI-систем.