GLM-5-Turbo

GLM-5-Turbo: Нативная модель OpenClaw для сложных агентских задач и интеграций

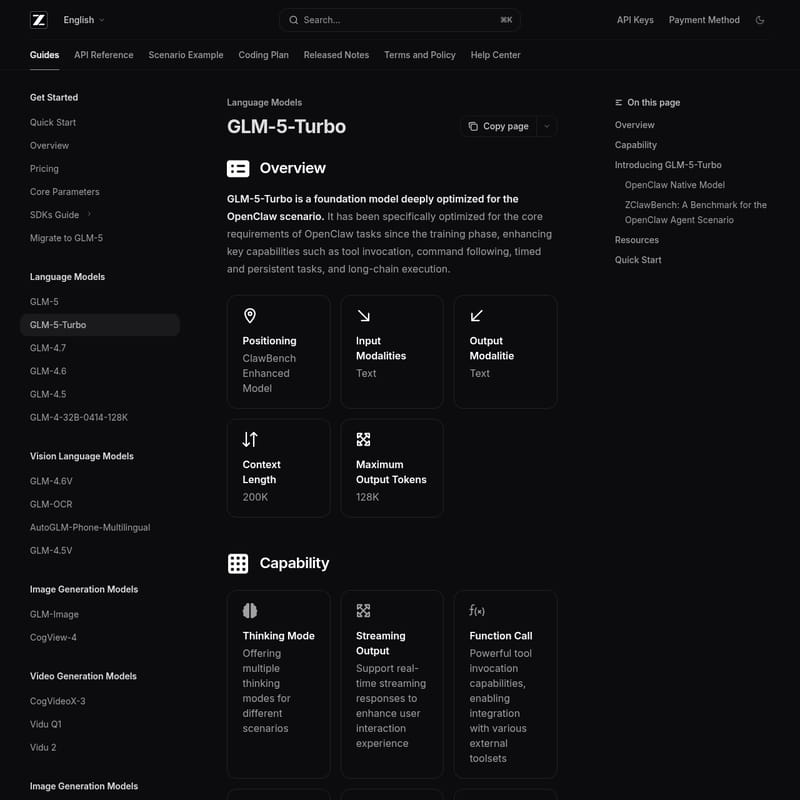

GLM-5-Turbo — это флагманская языковая модель от Z.AI, специально оптимизированная для сценариев OpenClaw. Она поддерживает контекстное окно 200K, глубокое мышление, вызов функций и структурированный вывод. Модель демонстрирует превосходство в выполнении долгосрочных задач, планировании сложных инструкций и стабильном взаимодействии с внешними инструментами через API. Идеально подходит для разработчиков, аналитиков и операционных инженеров.

2026-03-18

--K

GLM-5-Turbo Информация о продукте

GLM-5-Turbo: Новое поколение нативных моделей для сценариев OpenClaw

В современной экосистеме искусственного интеллекта потребность в моделях, способных не просто вести диалог, но и эффективно исполнять задачи, становится критической. GLM-5-Turbo представляет собой базовую модель, глубоко оптимизированную для сценария OpenClaw. С самого этапа обучения эта модель настраивалась на соответствие строгим требованиям задач OpenClaw, что позволило значительно усилить такие функции, как вызов инструментов, следование командам и выполнение длительных цепочек действий.

What's GLM-5-Turbo

GLM-5-Turbo — это высокопроизводительная языковая модель, которая позиционируется как решение, усиленное для бенчмарка ClawBench. Она работает с текстовыми модальностями на входе и выходе, предлагая впечатляющее контекстное окно в 200K токенов. Это позволяет модели обрабатывать огромные массивы данных, сохраняя связность в рамках длинных сессий.

Ключевая особенность GLM-5-Turbo заключается в её нативности по отношению к OpenClaw. Разработчики систематически конструировали сценарии задач на основе реальных рабочих процессов агентов, чтобы гарантировать способность модели исполнять сложные и динамичные инструкции. Максимальный объем выходных токенов составляет 128K, что делает её одной из самых мощных моделей в линейке Z.AI для генерации объемного контента и программного кода.

Features

Модель GLM-5-Turbo обладает набором передовых возможностей, которые выделяют её на фоне предшественников:

- Thinking Mode (Режим мышления): Предлагает несколько режимов обдумывания, адаптированных под различные сценарии сложности.

- Streaming Output (Потоковая передача): Поддержка ответов в реальном времени для улучшения взаимодействия с пользователем.

- Function Call (Вызов функций): Мощные возможности вызова инструментов, обеспечивающие бесшовную интеграцию с внешними наборами API.

- Context Caching (Кэширование контекста): Интеллектуальный механизм оптимизации производительности в длительных диалогах.

- Structured Output (Структурированный вывод): Поддержка форматов JSON, что критически важно для системной интеграции.

- Model Context Protocol (MCP): Гибкая интеграция внешних инструментов MCP и источников данных для расширения вариантов использования.

- Высокая точность Tool Calling: Усиленная стабильность при работе с внешними навыками, минимизирующая количество отказов в многошаговых задачах.

Use Case

GLM-5-Turbo находит применение в широком спектре профессиональных областей благодаря своей способности к декомпозиции сложных инструкций:

- Разработка программного обеспечения: Настройка сред, написание кода и автоматизация отладки через OpenClaw.

- Бизнес-аналитика и финансы: Глубокий анализ данных и поиск информации с использованием долгосрочных логических цепочек.

- Контент-маркетинг: Создание рекламных слоганов, планирование кампаний и генерация структурированных отчетов.

- Операционная инженерия: Управление запланированными и постоянными задачами, требующими понимания временных интервалов и непрерывности исполнения.

- Агентские экосистемы: Использование модели в качестве центрального узла для управления группой специализированных агентов.

Согласно данным бенчмарка ZClawBench, использование навыков (Skills) в таких сценариях выросло с 26% до 45%, что подтверждает эффективность GLM-5-Turbo в модульных экосистемах.

How to Use

Интеграция GLM-5-Turbo в ваш проект осуществляется через API Z.AI. Ниже приведен пример базового и потокового вызова с использованием cURL.

Базовый вызов API

Для выполнения запроса используйте следующий формат:

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer your-api-key" \

-d '{

"model": "glm-5-turbo",

"messages": [

{

"role": "user",

"content": "As a marketing expert, please create an attractive slogan for my product."

},

{

"role": "assistant",

"content": "Sure, to craft a compelling slogan, please tell me more about your product."

},

{

"role": "user",

"content": "Z.AI Open Platform"

}

],

"thinking": {

"type": "enabled"

},

"max_tokens": 4096,

"temperature": 1.0

}'

Потоковый вызов (Streaming)

Для получения ответа в реальном времени добавьте параметр "stream": true в тело запроса. Это позволит отображать текст по мере его генерации моделью GLM-5-Turbo.

FAQ

В чем главное отличие GLM-5-Turbo от стандартной GLM-5? GLM-5-Turbo специально оптимизирована для сценариев OpenClaw, демонстрируя лучшие показатели в декомпозиции инструкций, вызове инструментов и стабильности длинных логических цепочек.

Какое контекстное окно поддерживает модель? Модель поддерживает контекст до 200,000 токенов, что позволяет работать с очень длинными документами и историями переписки.

Поддерживает ли модель JSON-вывод? Да, GLM-5-Turbo поддерживает структурированный вывод (Structured Output), включая формат JSON, что упрощает её интеграцию в программные системы.

Что такое ZClawBench? Это комплексный бенчмарк, разработанный для оценки производительности агентов в экосистеме OpenClaw, охватывающий такие задачи, как поиск информации, анализ данных и создание контента.

Какие SDK доступны для работы с моделью? Доступны официальные SDK для Python и Java, а также поддержка OpenAI Python SDK.