SCRAPR

SCRAPR: Rewolucyjne narzędzie do przekształcania dowolnej strony internetowej w ustrukturyzowane API bez użycia przeglądarki.

SCRAPR to nowoczesna warstwa danych dla ery agentów AI, która pozwala zamienić dowolny adres URL w czyste, ustrukturyzowane API. Dzięki podejściu „zero-browser” i natywnej intercepcji sieciowej, SCRAPR oferuje 10-krotnie większą prędkość oraz 10-krotnie niższe koszty w porównaniu do tradycyjnych rozwiązań takich jak Puppeteer czy Selenium. Narzędzie eliminuje problemy z utrzymaniem i łamliwymi selektorami, dostarczając dane w formacie JSON w czasie poniżej 200ms. SCRAPR wspiera zaawansowane akcje, takie jak wypełnianie formularzy i rezerwacje, oferując jednocześnie CLI, SDK oraz wsparcie dla webhooków. To idealne rozwiązanie dla programistów budujących infrastrukturę danych gotową na AI.

2026-03-10

--K

SCRAPR Informacje o produkcie

SCRAPR: Przyszłość ekstrakcji danych i automatyzacji API

W dobie dynamicznego rozwoju sztucznej inteligencji, dostęp do czystych i ustrukturyzowanych danych staje się kluczowym elementem sukcesu każdej aplikacji. SCRAPR to innowacyjne rozwiązanie, które redefiniuje sposób, w jaki pobieramy informacje z sieci. Zapomnij o powolnych przeglądarkach i łamliwych skryptach. SCRAPR to warstwa danych stworzona dla ery agentów AI, pozwalająca zamienić dowolną stronę internetową w funkcjonalne API w mgnieniu oka.

Czym jest SCRAPR?

SCRAPR to potężne narzędzie programistyczne, które umożliwia transformację dowolnego adresu URL w ustrukturyzowane dane API bez konieczności używania przeglądarki (zero-browser approach). W przeciwieństwie do tradycyjnych metod, takich jak Selenium czy Puppeteer, SCRAPR operuje na czystym protokole HTTP, co przekłada się na niespotykaną dotąd wydajność.

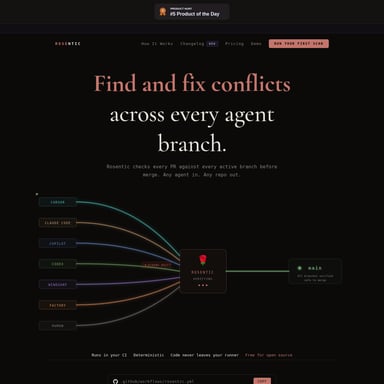

Produkt jest obecnie w fazie rozwoju (v1.0), budując nową infrastrukturę dla ekosystemu agentów AI. SCRAPR rozwiązuje największe bolączki web scrapingu: wysokie koszty utrzymania, powolne działanie i ciągle psujące się selektory CSS/XPath. Dzięki SCRAPR, programiści mogą skupić się na budowaniu produktów, a nie na naprawianiu parserów.

Kluczowe cechy SCRAPR

Narzędzie SCRAPR wyróżnia się na tle konkurencji szeregiem unikalnych właściwości, które czynią je liderem w kategorii nowoczesnej ekstrakcji danych:

- Szybkość Pure HTTP: Działa 10-krotnie szybciej niż Puppeteer, osiągając czasy odpowiedzi poniżej 200ms.

- Brak przeglądarki (No Browser): Eliminuje narzut pamięciowy i procesowy związany z renderowaniem stron.

- Intercepcja sieciowa: SCRAPR przechwytuje faktyczne wywołania API, których dokonuje strona, co gwarantuje stabilność danych.

- Zero konserwacji: Koniec z poprawianiem skryptów po każdej zmianie layoutu strony.

- Gotowość na AI: Dostarcza dane w czystym formacie JSON lub Markdown, idealnym dla modeli LLM i agentów AI.

- Wielozadaniowość: Możliwość wykonywania akcji, takich jak wypełnianie formularzy, kliknięcia i automatyzacja procesów rezerwacji.

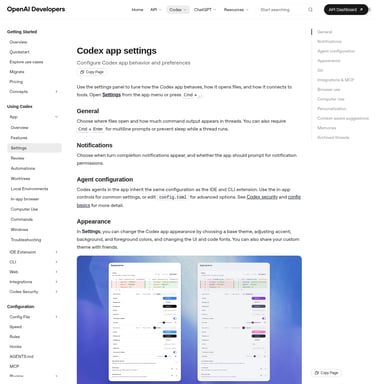

Jak używać SCRAPR?

Korzystanie ze SCRAPR jest niezwykle proste i dostosowane do różnych preferencji programistycznych. Poniżej przedstawiamy główne metody interakcji z systemem:

Interfejs CLI

Dla fanów terminala, SCRAPR oferuje intuicyjne narzędzie wiersza poleceń:

scrapr parse --url https://github.com

To polecenie pozwala na natychmiastową ekstrakcję danych bezpośrednio do formatu JSON.

Biblioteki SDK

Możesz zintegrować SCRAPR ze swoim projektem za pomocą oficjalnych bibliotek (Python, Node.js, Go, Rust):

from scrapr import Client

client = Client(api_key="TWÓJ_KLUCZ")

result = client.parse(url="https://example.com")

print(result.json())

REST API

Standardowe punkty końcowe HTTP pozwalają na integrację z dowolnym frameworkiem:

- GET /api/scrape: Proste pobieranie danych.

- POST /api/scrape: Zaawansowane operacje, takie jak wypełnianie formularzy (actions).

Przypadki użycia (Use Case)

SCRAPR znajduje zastosowanie wszędzie tam, gdzie liczy się czas, koszt i niezawodność danych:

- Agenty AI i LLM: Dostarczanie świeżych danych z sieci do modeli językowych w formacie Markdown lub JSON.

- Monitoring cen i dostępności: Automatyczne śledzenie lotów, hoteli i produktów bez ryzyka zablokowania przez tradycyjne boty.

- Automatyzacja formularzy: Masowe przesyłanie wniosków, rejestracja kont czy procesy checkout w e-commerce.

- Analityka rynkowa: Szybka ekstrakcja tysięcy rekordów z portali społecznościowych czy serwisów ogłoszeniowych (np. GitHub, Product Hunt).

Porównanie wydajności

| Cecha | SCRAPR | Puppeteer | Scrapy | Bright Data | | :--- | :--- | :--- | :--- | :--- | | Czas odpowiedzi | <200ms | 10000ms | 3000ms | 5000ms | | Wymagana przeglądarka | NIE | TAK | NIE | TAK | | Koszt | 1/10 ceny | Wysoki | Średni | Wysoki | | Utrzymanie | Minimalne | Wysokie | Bardzo wysokie | Średnie |

FAQ - Najczęściej zadawane pytania

Czy mogę scrapować strony oparte na JavaScript? Tak, SCRAPR radzi sobie ze stronami intensywnie korzystającymi z JS poprzez intercepcję wywołań sieciowych, co jest szybsze niż tradycyjne renderowanie.

Czy moje dane są bezpieczne? API są współdzielone w celu poprawy szybkości, dlatego nigdy nie należy przesyłać haseł ani danych wrażliwych.

Czy potrzebuję pisać własną logikę parsowania? W większości przypadków nie – SCRAPR automatycznie wyodrębnia ustrukturyzowane dane do formatu JSON.

Jakie są limity w darmowym planie? Plan darmowy oferuje 1,000 zapytań miesięcznie, wyjście JSON oraz wsparcie społeczności.

SCRAPR to nie tylko narzędzie do scrapingu – to nowa infrastruktura dla przyszłości opartej na danych. Dołącz do ponad 500 inżynierów na liście oczekujących i zacznij skalować swoje operacje na danych już dziś!