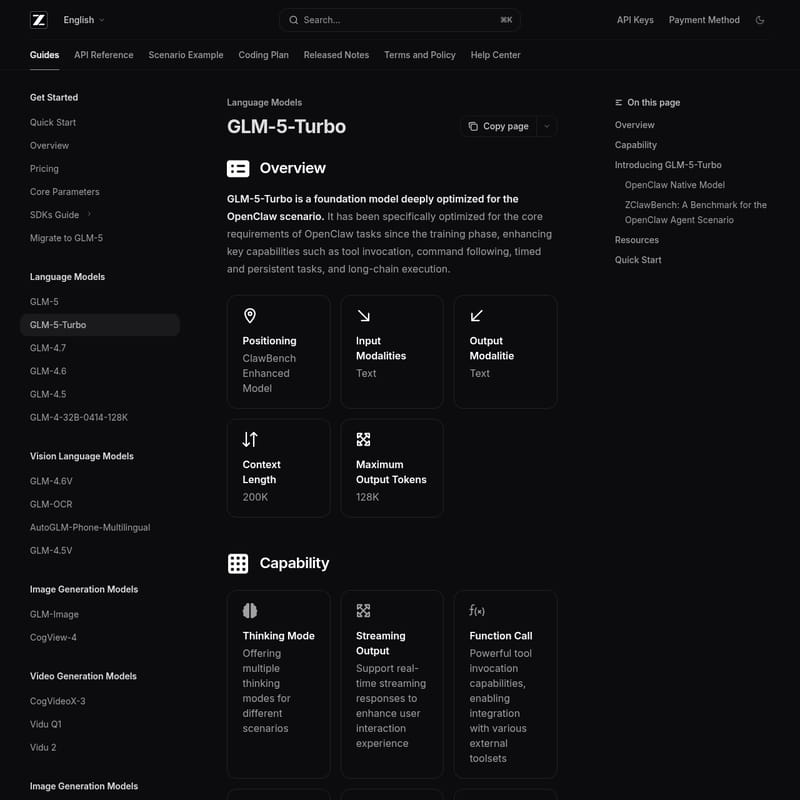

GLM-5-Turbo

GLM-5-Turbo: Geoptimaliseerd Foundation Model voor OpenClaw Scenario's

Ontdek GLM-5-Turbo van Z.AI, een geavanceerd taalmodel dat specifiek is ontworpen voor het OpenClaw-ecosysteem. Met een contextvenster van 200K tokens en superieure prestaties in tool-invocatie, complexe instructies en langdurige taken, zet dit model een nieuwe standaard voor AI-agents. GLM-5-Turbo blinkt uit in stabiliteit, snelheid en precisie bij het uitvoeren van multi-stap workflows, ondersteund door de ZClawBench benchmark.

2026-03-18

--K

GLM-5-Turbo Productinformatie

GLM-5-Turbo: De Kracht achter OpenClaw Native Agent-Workflows

In het snel evoluerende landschap van kunstmatige intelligentie is de behoefte aan modellen die niet alleen praten, maar ook daadwerkelijk acties uitvoeren, groter dan ooit. GLM-5-Turbo is een geavanceerd foundation model dat vanaf de basis is geoptimaliseerd voor het OpenClaw scenario. Door de focus te leggen op real-world agent-workflows, biedt GLM-5-Turbo ongekende mogelijkheden voor ontwikkelaars en bedrijven die complexe, dynamische taken willen automatiseren.

Wat is GLM-5-Turbo?

GLM-5-Turbo is een specifiek geoptimaliseerd taalmodel binnen de Z.AI-familie, gepositioneerd als een ClawBench Enhanced Model. Het model is diepgaand getraind om te voldoen aan de kernvereisten van OpenClaw-taken. Dit betekent dat de training niet alleen gericht was op tekstbegrip, maar specifiek op aspecten zoals tool-invocatie, het opvolgen van commando's en het uitvoeren van langdurige, persistente taken.

Het model ondersteunt tekstuele input en output met een indrukwekkende contextlengte van 200K tokens en een maximale output van 128K tokens. Hierdoor is het uitermate geschikt voor projecten waarbij grote hoeveelheden informatie verwerkt moeten worden zonder het overzicht te verliezen.

Belangrijke Kenmerken van GLM-5-Turbo

De kracht van GLM-5-Turbo ligt in de specifieke optimalisaties die het onderscheiden van standaard taalmodellen. Hier zijn de belangrijkste features:

1. Thinking Mode en Streaming Output

- Thinking Mode: Het model biedt verschillende denkmodi die kunnen worden aangepast aan diverse scenario's, van snelle antwoorden tot diepe analyse.

- Streaming Messages: Ondersteuning voor real-time streaming responsen zorgt voor een verbeterde gebruikersinteractie en direct resultaat.

2. Geavanceerde Tooling en Integratie

- Function Calling: GLM-5-Turbo beschikt over krachtige mogelijkheden voor tool-invocatie, waardoor naadloze integratie met externe toolsets mogelijk is.

- MCP Integratie: Flexibele integratie met externe Model Context Protocol (MCP) tools en databronnen om use cases uit te breiden.

- Structured Output: Ondersteuning voor formaten zoals JSON vergemakkelijkt de integratie in bestaande softwaresystemen.

3. Efficiëntie in Lange Conversaties

- Context Caching: Een intelligent caching-mechanisme optimaliseert de prestaties en kosten bij langdurige gesprekken.

- High-Throughput Long Chains: Voor taken met een hoge data-doorvoer en lange logische ketens biedt het model snellere en stabielere executie.

Use Case: Waarvoor gebruik je GLM-5-Turbo?

GLM-5-Turbo is ontworpen voor scenario's waarbij actie centraal staat. Dankzij de ZClawBench resultaten weten we dat het model uitblinkt in:

- Softwareontwikkeling en Environment Setup: Het automatiseren van complexe programmeertaken en systeemconfiguraties.

- Informatieherstel en Data-analyse: Het doorzoeken van grote hoeveelheden data en het genereren van gestructureerde inzichten.

- Contentcreatie: Van marketingmateriaal tot technische documentatie.

- Operationeel beheer: Het plannen en uitvoeren van taken met een tijdselement, zoals geplande triggers en continue workflows.

- Multi-Agent Systemen: Het decomponeren van complexe instructies voor samenwerking tussen verschillende AI-agents.

Hoe te gebruiken: Quick Start Gids

Het implementeren van GLM-5-Turbo in uw workflow is eenvoudig via de API van Z.AI. Hieronder vindt u een voorbeeld van een basisaanroep en een streamingaanroep.

Basis API Aanroep (cURL)

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions" \ -H "Content-Type: application/json" \ -H "Authorization: Bearer your-api-key" \ -d '{ "model": "glm-5-turbo", "messages": [ { "role": "user", "content": "Z.AI Open Platform" } ], "thinking": { "type": "enabled" }, "max_tokens": 4096, "temperature": 1.0 }'

Streaming Aanroep voor Real-time Respons

Voor een snellere gebruikerservaring kunt u de stream parameter op true zetten. Dit is ideaal voor interactieve applicaties waar de gebruiker de tekst ziet verschijnen terwijl deze wordt gegenereerd.

FAQ

V: Wat maakt GLM-5-Turbo een 'OpenClaw Native Model'? A: Dit betekent dat het model vanaf de fase van data-constructie en optimalisatiedoelen is ontworpen op basis van echte OpenClaw agent-workflows. Het is specifiek getraind om foutloos tools aan te roepen en complexe instructies te ontleden.

V: Hoe presteert GLM-5-Turbo vergeleken met de standaard GLM-5? A: Volgens de ZClawBench benchmark levert GLM-5-Turbo aanzienlijke verbeteringen in OpenClaw-scenario's en presteert het beter dan verschillende andere toonaangevende modellen in kritieke taakcategorieën.

V: Welke modaliteiten worden ondersteund? A: GLM-5-Turbo ondersteunt tekstinvoer en tekstuitvoer, geoptimaliseerd voor een contextlengte van 200.000 tokens.

V: Is er ondersteuning voor gestructureerde data? A: Ja, het model ondersteunt Structured Output (zoals JSON), wat essentieel is voor systeemintegratie en betrouwbare dataverwerking.

Met de introductie van GLM-5-Turbo biedt Z.AI een robuuste oplossing voor de volgende generatie AI-agents, waarbij stabiliteit, snelheid en precisie in executie voorop staan.