SCRAPR

SCRAPR: 브라우저 없이 모든 웹사이트를 고성능 API로 변환하는 혁신적인 데이터 추출 솔루션

SCRAPR는 기존의 무거운 브라우저 기반 스크래핑 방식에서 벗어나 순수 HTTP 속도를 활용한 차세대 데이터 추출 플랫폼입니다. 10배 더 빠르고 10분의 1 비용으로 운영되는 이 도구는 복잡한 웹사이트를 깨끗하고 구조화된 JSON API로 즉시 변환합니다. AI 에이전트 시대를 위해 설계된 SCRAPR는 유지보수가 필요 없는 제로 브라우저 접근 방식을 통해 엔터프라이즈급 성능과 확장성을 제공하며, 현재 얼리 액세스를 위한 대기자 명단을 모집 중입니다.

2026-03-10

--K

SCRAPR 제품정보

SCRAPR: 모든 웹사이트를 고속 API로 변환하는 차세대 데이터 레이어

웹 데이터 추출의 패러다임이 바뀝니다. SCRAPR는 기존의 번거롭고 깨지기 쉬운 스크래핑 방식을 혁신하여, 어떤 URL이든 즉시 깨끗하고 구조화된 JSON API로 변환해주는 고성능 데이터 플랫폼입니다. AI 에이전트 시대를 위해 구축된 SCRAPR는 유지보수 걱정 없이 데이터를 스케일링할 수 있는 최적의 환경을 제공합니다.

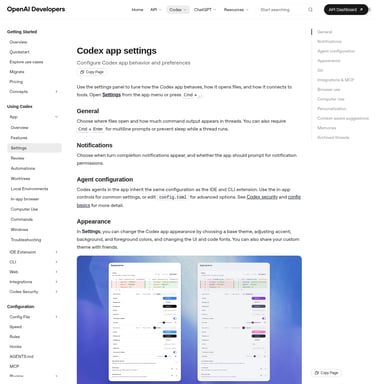

What's SCRAPR?

SCRAPR는 브라우저를 띄우지 않고(No-Browser) 순수 HTTP 속도만을 활용하여 데이터를 추출하는 네트워크 네이티브(Network-native) 데이터 레이어입니다. 기존의 Selenium이나 Puppeteer와 같은 도구들이 수 초에서 수십 초의 로딩 시간을 필요로 했다면, SCRAPR는 웹사이트가 내부적으로 호출하는 API를 가로채어 200ms 미만의 기록적인 속도로 데이터를 추출합니다.

인도에서 시작된 이 프로젝트는 스스로의 데이터 추출 고충을 해결하기 위해 구축된 MVP에서 시작되었습니다. 현재 Product Hunt에서 그 가치를 입증받았으며, 전 세계 AI 에이전트 에코시스템을 위한 인프라 레이어로 도약하고 있습니다.

주요 특징 (Features)

SCRAPR는 기존 도구들과 비교할 수 없는 강력한 기능을 자랑합니다.

1. 초고속 성능과 저렴한 비용

- 순수 HTTP 속도: 브라우저 실행 없이 작동하여 Puppeteer보다 10배 더 빠릅니다.

- 경제성: 전통적인 방식 대비 운영 비용을 1/10 수준으로 절감할 수 있습니다.

- 즉각적인 추출: 복잡한 페이지에서도 156ms~234ms 내외의 응답 속도를 보장합니다.

2. 유지보수 제로 (Zero Maintenance)

- 네트워크 가로채기: 깨지기 쉬운 HTML 선택자(Selector) 대신 실제 API 호출을 가로채므로 사이트 UI가 변경되어도 안정적입니다.

- 설정 시간 제로: 별도의 환경 설정 없이 즉시 API를 생성하고 사용할 수 있습니다.

3. AI Ready 데이터 구조

- 구조화된 출력: 모든 데이터는 즉시 JSON, Markdown, XML 등 AI 모델이 이해하기 쉬운 형태로 제공됩니다.

- 엔터프라이즈급 확장성: 99.9% 업타임 SLA를 제공하며 대규모 데이터 처리에 최적화되어 있습니다.

4. 강력한 액션 엔진 (Action Engine)

- 단순 조회를 넘어 항공권 예약, 호텔 검색, 양식 제출, 식당 예약 등 복잡한 상호작용을 자동화할 수 있습니다.

사용 사례 (Use Case)

SCRAPR는 개발자와 비즈니스가 데이터를 활용하는 모든 곳에서 빛을 발합니다.

- REST API 활용: 표준 HTTP 엔드포인트를 통해 어떤 프로그래밍 언어나 프레임워크에서도 데이터를 호출할 수 있습니다.

- CLI 도구: 명령줄 인터페이스를 통해 일회성 데이터 추출이나 자동화 스크립트를 즉석에서 실행합니다.

- 웹훅(Webhooks): 백그라운드 작업 완료 시 실시간 알림을 받아 데이터 파이프라인을 구축합니다.

- 공식 SDK 지원: Python, Node.js, Go, Rust용 SDK를 통해 서비스에 직접 통합할 수 있습니다.

- AI 에이전트 인프라: 실시간으로 깨끗한 데이터를 필요로 하는 AI 서비스의 핵심 데이터 레이어로 활용됩니다.

사용 방법 (How to Use)

SCRAPR는 매우 간단한 인터페이스를 제공하여 누구나 쉽게 시작할 수 있습니다.

CLI를 통한 즉시 추출

터미널에서 아래와 같은 명령어를 입력하는 것만으로 충분합니다.

$ scrapr parse --url github.com

# 459개 저장소 추출 완료 (156ms)

API 호출 (Python 예시)

from scrapr import Client

client = Client(api_key="YOUR_KEY")

result = client.parse(url="https://example.com")

print(result.json())

복잡한 액션 수행

단순 추출을 넘어 클릭, 필드 입력 등의 동작이 필요한 경우 POST /api/scrape 엔드포인트를 통해 actions 파라미터를 사용하여 폼 제출이나 예약 등을 자동화할 수 있습니다.

FAQ

Q: SCRAPR는 기존의 웹 스크래핑과 어떻게 다른가요?

A: 기존 방식은 무거운 브라우저를 실행하여 화면을 렌더링하지만, SCRAPR는 네트워크 레벨에서 데이터를 가로챕니다. 이를 통해 속도는 10배 높이고 리소스 사용량은 획기적으로 줄였습니다.

Q: 자바스크립트가 많이 사용된 사이트도 스크래핑할 수 있나요?

A: 네, SCRAPR의 인터랙티브 모드와 네트워크 가로채기 기술을 통해 동적으로 로드되는 데이터도 완벽하게 추출 가능합니다.

Q: 속도 제한이나 IP 차단 문제는 어떻게 해결하나요?

A: SCRAPR는 엔터프라이즈급 인프라를 통해 이러한 문제를 관리하며, 사용자에게는 안정적인 API 응답만을 제공합니다.

Q: 데이터 보안은 안전한가요?

A: 네, SCRAPR는 안전한 데이터 처리를 지향합니다. 다만, 공유 API 환경에서는 비밀번호나 민감한 개인 정보를 포함하지 않는 것을 권장합니다.

Q: 별도의 파싱 로직을 직접 작성해야 하나요?

A: 아니요, SCRAPR가 자동으로 URL을 분석하여 깨끗한 구조화된 데이터를 반환하므로 복잡한 로직 작성이 필요 없습니다.