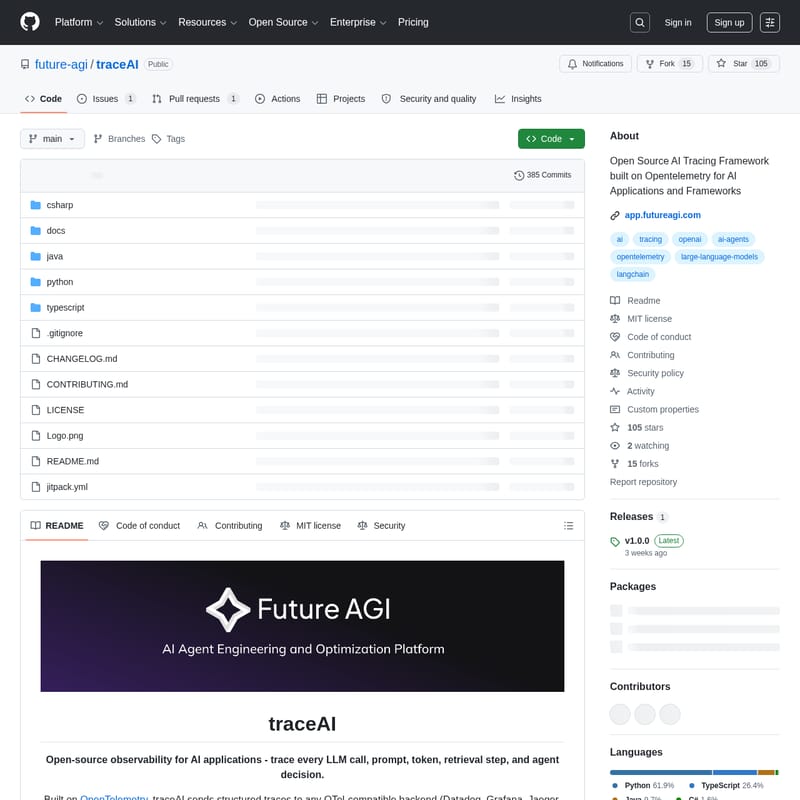

traceAI

traceAI:AIアプリケーションのためのOpenTelemetry準拠オープンソース観測プラットフォーム

traceAIは、OpenTelemetryをベースにしたAIアプリケーション向けのオープンソース観測フレームワークです。LLMの呼び出し、プロンプト、トークン使用量、エージェントの意思決定など、AIワークフローの全ステップを可視化します。特定のベンダーに依存せず、DatadogやGrafana等の既存ツールと連携可能。Python、TypeScript、Java、C#に対応し、50以上の主要AIフレームワークをサポートします。

2026-04-03

534773.1K

traceAI 製品情報

traceAI:AIアプリケーションのための究極のオープンソース観測フレームワーク

AIアプリケーションの開発において、複雑なエージェントの挙動やLLMの呼び出しプロセスを完全に把握することは困難です。traceAIは、この課題を解決するために設計されたOpenTelemetryベースのオープンソース観測フレームワークです。

traceAIを利用することで、すべてのLLM呼び出し、プロンプトの内容、トークン消費量、ベクトルデータベースの検索ステップ、そしてAIエージェントの最終的な意思決定に至るまで、構造化されたトレースとして記録・分析することが可能になります。

What's traceAI? (traceAIとは)

traceAIは、AIアプリケーションに特化した可視化ライブラリです。業界標準である**OpenTelemetry (OTel)**を採用しているため、新しいダッシュボードを導入したり、特定のベンダーに縛られたりする必要はありません。

traceAIがキャプチャしたデータは、Datadog、Grafana、Jaeger、Future AGIといった、既存のOTel互換バックエンドへ直接送信できます。Python、TypeScript、Java、C#といった主要な4言語をサポートし、50以上のAIフレームワークに対してゼロ構成での計測(インストルメンテーション)を提供します。

traceAIの主な特徴 (Features)

traceAIは、本番環境での利用に耐えうる強力な機能を備えています。

- 標準化されたトレーシング: AIのワークフローを一貫性のあるOpenTelemetryのスパンと属性にマッピングします。

- ゼロ構成セットアップ: 最小限のコード変更で導入可能なドロップイン・インストルメンテーションを実現しています。

- マルチフレームワーク対応: Python、TypeScript、Java、C#にわたる50以上の統合機能を搭載しています。

- ベンダーに依存しない: あらゆるOpenTelemetry互換バックエンドで動作するため、既存の監視インフラを活用できます。

- 豊富なコンテキストキャプチャ: プロンプト、補完結果、トークン数、モデルパラメータ、ツール呼び出しなどを詳細に記録します。

- プロダクションレディ: 非同期サポート、ストリーミング、エラーハンドリング、パフォーマンス最適化が施されています。

traceAIの使い方 (How to Use)

各言語での基本的な導入方法は以下の通りです。

Pythonでのクイックスタート

-

インストール

pip install traceai-openai -

アプリケーションへの組み込み

import os from fi_instrumentation import register from fi_instrumentation.fi_types import ProjectType from traceai_openai import OpenAIInstrumentor import openai # トレーサープロバイダーの登録 trace_provider = register( project_type=ProjectType.OBSERVE, project_name="my_ai_app" ) # OpenAIの自動計測を有効化 OpenAIInstrumentor().instrument(tracer_provider=trace_provider) # 通常通りOpenAIを使用するだけで、自動的にトレースが生成されます

TypeScriptでのクイックスタート

-

インストール

npm install @traceai/openai @traceai/fi-core -

計測の設定

register関数を使用してプロジェクトを登録し、OpenAIInstrumentationを初期化することで、自動的にAPI呼び出しを追跡します。

JavaおよびC#の対応

- Java: JitPack経由で依存関係を追加し、

TraceAI.init()を呼び出すことで利用可能です。 - C#: NuGetから

fi-instrumentation-otelをインストールし、FITracer.Initializeで初期化します。

traceAIの活用シーン (Use Case)

traceAIは、以下のような高度なAI開発シーンで威力を発揮します。

- デバッグとトラブルシューティング: AIエージェントがなぜ誤った判断をしたのか、どのステップでエラーが発生したのかを詳細なトレースから特定します。

- コスト最適化: モデルごとのトークン使用量を正確に把握し、プロンプトの効率化やコスト削減に役立てます。

- パフォーマンス監視: LLMの応答待ち時間や、ベクトルデータベースの検索時間を可視化し、システム全体のボトルネックを解消します。

- コンプライアンスとログ記録: モデルに送信されたプロンプトと応答の履歴を構造化データとして保持し、監査や品質管理に利用します。

よくある質問 (FAQ)

Q: traceAIを使用するために新しいダッシュボードを導入する必要はありますか?

A: いいえ、必要ありません。traceAIはOpenTelemetryをベースにしているため、DatadogやGrafanaなど、すでにお使いのOTel互換ツールをそのまま利用できます。

Q: どのようなAIフレームワークをサポートしていますか?

A: LangChain、LlamaIndex、CrewAI、AutoGen、Spring AIなどの主要なフレームワークに加え、OpenAI、Anthropic、Google Vertex AI、MistralなどのLLMプロバイダー、さらにPineconeやChromaDBなどのベクトルデータベースも幅広くサポートしています。

Q: ストリーミングレスポンスには対応していますか?

A: はい、対応しています。個別のチャンクとデルタトラッキングを含め、ストリーミング出力も正確にキャプチャします。

Future AGIチームによって丹精込めて構築されました。

詳細なドキュメントや最新情報は、公式サイトおよびGitHubリポジトリをご確認ください。