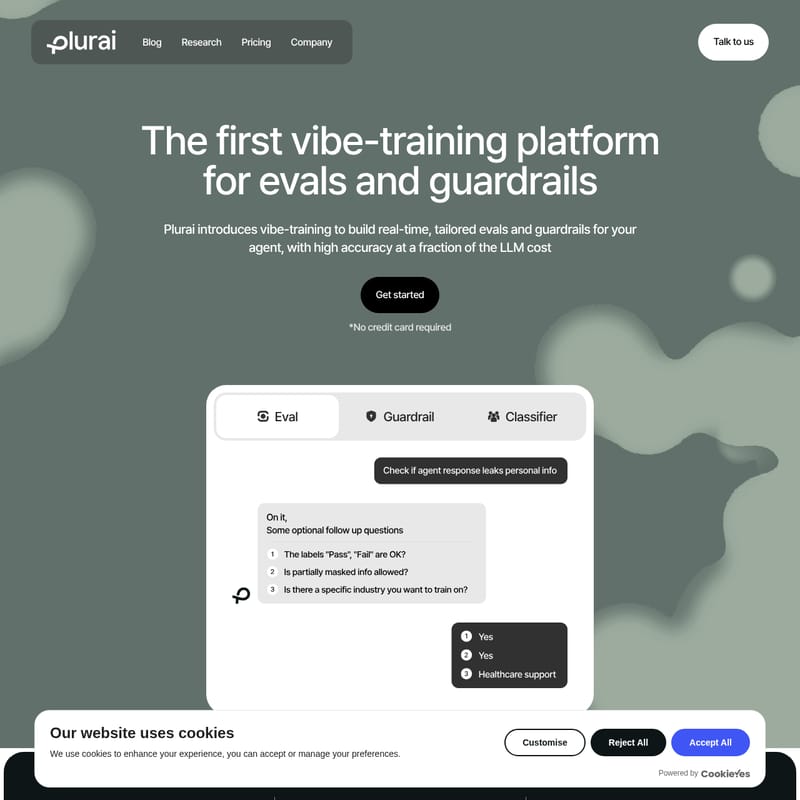

Plurai

Plurai: AIエージェントの評価(Evals)とガードレールを最適化するvibe-trainingプラットフォーム

Pluraiは、AIエージェント向けの評価(Evals)とガードレール(Guardrails)を構築するための、世界初のvibe-trainingプラットフォームです。独自の意図キャリブレーションとSLM(小規模言語モデル)の最適化により、GPT 5.2と比較して8倍以上のコスト削減と43%以上のエラー低減を実現。リアルタイムでの高い精度と100ms未満の低遅延を提供し、AI開発における速度と安全性のトレードオフを解消します。

2026-05-01

--K

Plurai 製品情報

Plurai:AIエージェントの評価(Evals)とガードレールを革新するvibe-trainingプラットフォーム

AIエージェントの開発において、精度、コスト、そして安全性のバランスを維持することは常に大きな課題です。Pluraiは、この課題を解決するために登場した、世界初のvibe-trainingプラットフォームです。従来のLLM(大規模言語モデル)に依存した評価手法を超え、**SLM(小規模言語モデル)**を最適化することで、圧倒的なパフォーマンスとコスト効率を実現します。

What's Plurai?

Pluraiは、AIエージェントのためのリアルタイムでパーソナライズされた**評価(Evals)とガードレール(Guardrails)**を構築するための最先端プラットフォームです。

独自の「vibe-training」手法を用いることで、個別のユースケースに特化した高精度な評価モデルを構築できます。これにより、開発者はAIエージェントの振る舞いを精密にコントロールし、本番環境での信頼性を劇的に向上させることが可能です。クレジットカード不要で、すぐにその実力を試すことができます。

「Pluraiは、LLMのコストを大幅に抑えつつ、AIエージェントにリアルタイムで最適化された評価とガードレールを提供します。」

Pluraiの主な特徴(Features)

Pluraiが提供するソリューションは、従来の「LLM-as-judge」アプローチが抱えていた限界を打破します。

1. 圧倒的なコスト削減と精度の向上

Pluraiのモデルは、GPT 5.2と比較して8倍以上のコスト削減を実現しています。また、独自の最適化プロセスにより、失敗率(Failure rate)を43%以上削減することに成功しました。これにより、予算を抑えながらより安全で高精度なAI運用が可能になります。

2. 超低遅延(Inference Latency)

本番環境でのガードレールにはスピードが不可欠です。Pluraiのインファレンス遅延は100ms以下を達成しています。リアルタイム性が求められるエージェントの対話においても、ユーザー体験を損なうことなく安全性を確保します。

3. 意図キャリブレーション(Intent Calibration)

Pluraiは独自の意図キャリブレーションプロセスを採用しています。これにより、特定のタスクを深く理解し、高品質なテストセットと一貫性のある評価モデル(Evaluator)を生成します。これは、従来の一般的なLLMによる評価よりもはるかに生産的でスケーラブルな手法です。

4. 合成データ生成(Synthetic Data Generation)

過去のラベル付きデータが不足している場合でも、Pluraiはユースケースに合わせた**高精度な合成データ(High-fidelity synthetic data)**を生成します。これにより、データ収集の手間をかけずに、特定タスクに特化したSLMを訓練することが可能です。

5. セキュリティとオンプレミス展開

データコントロールとさらなる低遅延を求める企業向けに、VPC(仮想プライベートクラウド)内へのデプロイが可能です。機密性の高いデータを扱うエンタープライズ環境でも、安全にインフラを構築できます。

主なユースケース(Use Case)

Pluraiのモデルは、多岐にわたるセマンティックタスクに対応しています。

- 対話評価(Conversation Evaluation): ユーザーとエージェントのやり取りが適切かどうかを自動評価します。

- セマンティック類似性(Semantic Similarity): 文脈や意味の近さを高精度に判定します。

- グラウンディング検証(Grounding Validation): 回答が根拠に基づいているか、ハルシネーションがないかを確認します。

- ポリシーコンプライアンス(Policy Compliance): 企業のガイドラインや法的制約を遵守しているかを常時監視します。

FAQ(よくある質問)

Q: エージェントでEvalsやガードレールをどのように使用しますか?

A: Pluraiのモデルは、会話の評価、セマンティック類似性、グラウンディング検証、ポリシーコンプライアンスなど、幅広いセマンティックタスクで使用できます。ユースケースカタログを通じて、具体的な活用方法を探索いただけます。

Q: 既存のEvals手法と何が違うのですか?

A: 従来の「LLM-as-judge」はコストが高く、本番環境での全面的な適用が困難でした。Pluraiは意図キャリブレーションを通じて、特定のタスクに最適化された**SLM(小規模言語モデル)**を使用します。これにより、本番環境レベルの評価とガードレールを、はるかに高いコスト効率で実現します。

Q: オンプレミスでの利用は可能ですか?

A: はい、可能です。セキュリティとデータコントロールを最大化するため、お客様のVPCへのデプロイに対応しています。具体的なインフラ要件については、お問い合わせください。

Q: なぜSLM(小規模言語モデル)で高い精度が出せるのですか?

A: PluraiのSLMは、汎用的なLLMとは異なり、お客様の特定のタスクに合わせて**目的別(purpose-built)**に構築されるためです。意図キャリブレーションと合成データ生成プロセスを組み合わせることで、特定のデータセットに対して高度に最適化された評価を実現しています。

Q: SLM以外のモデルも提供していますか?

A: はい。最高レベルの精度を求めるオフライン評価やサンプリングデータ向けに、最適化されたLLMベースの評価モデルも提供しています。ただし、リアルタイムのガードレールには低遅延なSLMが最適です。

Q: Proton製品はEvalsとガードレール専用ですか?

A: Protonのモデルは、会話評価だけでなく、セマンティック類似性やグラウンディング検証、ポリシーコンプライアンスなど、多様なセマンティックタスクに応用可能です。

まとめ:AI開発のスピードと安全性を両立

Pluraiは、AI開発における「速度 vs 安全性」のトレードオフを解消します。vibe-trainingとSLMの力を活用し、あなたのAIエージェントを現実世界で通用するレベルへと引き上げましょう。

- [今すぐ始める](Get started)

- [デモを予約する](Get a demo)