GPT‑5.3‑Codex‑Spark

GPT-5.3-Codex-Spark:1000トークン/秒を超える超高速リアルタイムコーディングAI

GPT-5.3-Codex-Sparkは、OpenAIとCerebrasの提携により誕生した、リアルタイムコーディング専用の超高速AIモデルです。毎秒1000トークン以上の生成速度を誇り、128kのコンテキストウィンドウを備えています。開発者がコードの編集や論理の再構築をニアインスタントに行えるよう設計されており、ChatGPT Proユーザー向けに研究プレビューとして提供されています。

2026-02-15

210067.3K

GPT‑5.3‑Codex‑Spark 製品情報

GPT-5.3-Codex-Spark:リアルタイムコーディングを実現する超高速AIモデル

OpenAIは、コーディング向けモデルの最新進化形としてGPT-5.3-Codex-Sparkを発表しました。このモデルは、GPT-5.3-Codexの小型版でありながら、リアルタイムでのインタラクティブな開発作業に特化して最適化されています。Cerebras社とのパートナーシップにより、これまでにない低レイテンシと高スループットを実現した、次世代の開発パートナーです。

What's GPT-5.3-Codex-Spark

GPT-5.3-Codex-Sparkは、OpenAIが提供する「Codex」エコシステムにおける最初のリアルタイムコーディング専用モデルです。最大の特徴は、毎秒1000トークン以上という驚異的な生成速度にあります。これは、開発者がコードを入力したり指示を出したりした瞬間に、まるで思考と同期するかのような速さでレスポンスが返ってくることを意味します。

本モデルは、Cerebrasの「Wafer Scale Engine 3」という専用AIアクセラレータ上で動作しており、従来のGPUベースの推論と比較して、特にインタラクティブなワークフローにおいて圧倒的な優位性を発揮します。現在はChatGPT Proユーザー向けに、Codexアプリ、CLI、およびVS Code拡張機能を通じて研究プレビューとして公開されています。

Features:GPT-5.3-Codex-Sparkの主な特徴

GPT-5.3-Codex-Sparkは、単に速いだけでなく、実用的なコーディング支援を可能にする数多くの機能を備えています。

1. 圧倒的な推論スピードと低レイテンシ

Cerebrasとの提携により実現した超高速推論層により、1000トークン/秒を超える速度を達成。WebSocket接続の導入やレスポンスパイプラインの最適化により、クライアント・サーバー間のオーバーヘッドを80%削減、最初のトークンが表示されるまでの時間(TTFT)を50%短縮しました。

2. リアルタイム・コラボレーション最適化

GPT-5.3-Codex-Sparkは、開発者が作業を中断させたり、途中で指示を書き換えたりする「インタラクティブな編集」に最適化されています。軽量で的を絞った編集スタイルをデフォルトとしており、ロジックの再構築やUIの微調整を即座に反映させることができます。

3. 強力なエージェント能力

小型モデルながら、SWE-Bench ProやTerminal-Bench 2.0といったベンチマークで高い性能を実証しています。GPT-5.3-Codexと比較しても、わずかな時間で同等のエージェントタスクを完遂する能力を持っています。

4. 128kコンテキストウィンドウ

広大な128kコンテキストウィンドウをサポートしており、大規模なコードベースや複数のファイルをまたぐプロジェクトでも、文脈を失うことなく正確なコード生成が可能です。

Use Case:活用シーン

GPT-5.3-Codex-Sparkは、特に「スピード」と「反復」が求められる場面で真価を発揮します。

- 即時的なコード修正: 動作中のコードに対して、特定箇所のロジック変更やリファクタリングを瞬時に行いたい場合。

- リアルタイムUI開発: インターフェースのデザインやスタイルを微調整し、その結果をリアルタイムで確認しながら開発を進める場合。

- インタラクティブなデバッグ: モデルとの対話を通じて、エラーの原因を素早く特定し、修正案を次々と試すワークフロー。

- CLIでの高速スクリプト生成: コマンドラインツール(CLI)を通じて、定型作業の自動化スクリプトをその場で生成・実行する場合。

FAQ

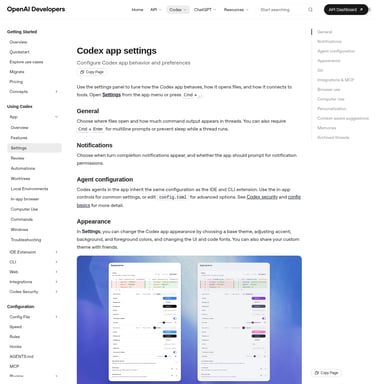

Q: GPT-5.3-Codex-Sparkは誰が利用できますか? A: 現在、ChatGPT Proユーザーを対象に、Codexアプリ、CLI、およびVS Code拡張機能を通じて研究プレビューとして提供されています。また、一部の限定的なデザインパートナーにはAPI経由での提供も開始されています。

Q: 他のモデルとの使い分けはどうすればよいですか? A: 数時間から数日かかるような長期的なタスクや高度な推論が必要な場合は、GPT-5.3-Codexのようなフロンティアモデルが適しています。一方で、瞬時のレスポンスや頻繁なやり取りが必要なリアルタイム編集には、GPT-5.3-Codex-Sparkが最適です。

Q: 使用量に制限はありますか? A: 研究プレビュー期間中、GPT-5.3-Codex-Sparkには独自のレート制限が適用されます。この制限は標準のレート制限にはカウントされませんが、需要が高い場合にはキュー(待ち行列)が発生する可能性があります。

Q: セキュリティや安全性の対策はなされていますか? A: はい。GPT-5.3-Codex-Sparkには、サイバーセキュリティ関連のトレーニングを含む、OpenAIの標準的な安全性トレーニングが施されています。評価の結果、サイバーセキュリティや生物学における高いリスク閾値には達していないことが確認されています。

「GPT-5.3-Codex-Sparkで最もエキサイティングなのは、高速推論が可能にする新しいインタラクションパターンとユースケースを、開発者コミュニティと共に発見していくことです。」 — Sean Lie, CTO and Co-Founder of Cerebras