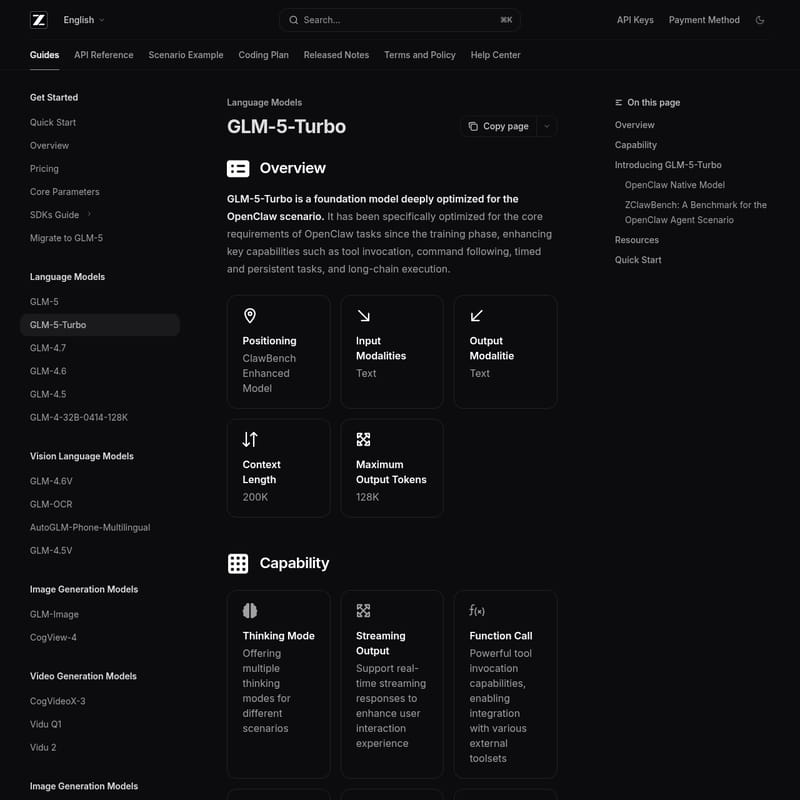

GLM-5-Turbo

Découvrez GLM-5-Turbo : Le Modèle Natif OpenClaw de Z.AI pour Agents Intelligents et Tâches Complexes

GLM-5-Turbo est un modèle de fondation de pointe optimisé par Z.AI spécifiquement pour l'écosystème OpenClaw. Conçu pour l'exécution de tâches à longue chaîne, ce modèle excelle dans l'invocation d'outils, le suivi d'instructions complexes et la gestion de tâches persistantes. Avec une fenêtre de contexte de 200K jetons et une capacité de sortie de 128K, GLM-5-Turbo surpasse ses prédécesseurs dans les flux de travail réels grâce à son intégration native OpenClaw et au benchmark ZClawBench. Il offre des fonctionnalités avancées telles que le mode de pensée profonde, le streaming, l'appel de fonctions et la mise en cache du contexte, ce qui en fait l'outil idéal pour les développeurs et les entreprises cherchant une automatisation robuste et stable via des agents IA.

2026-03-18

--K

GLM-5-Turbo Informations sur le produit

Tout savoir sur GLM-5-Turbo : Le Modèle de Fondation Optimisé pour l'Écosystème OpenClaw

Le paysage de l'intelligence artificielle évolue vers une automatisation de plus en plus complexe. Dans ce contexte, GLM-5-Turbo s'impose comme une solution de premier plan. Développé par Z.AI, ce modèle de fondation est profondément optimisé pour le scénario OpenClaw, offrant des performances inégalées pour les agents intelligents et les flux de travail dynamiques.

Qu'est-ce que GLM-5-Turbo ?

GLM-5-Turbo est un modèle de langage (LLM) natif OpenClaw conçu pour répondre aux exigences critiques des tâches d'agents modernes. Contrairement aux modèles généralistes, GLM-5-Turbo a été spécifiquement entraîné pour maîtriser l'invocation d'outils, le suivi de commandes complexes et l'exécution de tâches persistantes sur le long terme.

Positionné comme un modèle amélioré pour le benchmark ClawBench, il accepte des entrées textuelles et produit des sorties textuelles avec une efficacité redoutable. Sa capacité de traitement est impressionnante :

- Longueur de contexte : 200 000 jetons (200K).

- Maximum de jetons en sortie : 128 000 jetons (128K).

Caractéristiques Principales de GLM-5-Turbo

Le modèle GLM-5-Turbo se distingue par une suite de fonctionnalités avancées conçues pour l'intégration logicielle et l'expérience utilisateur :

1. Modes de Pensée (Thinking Mode)

GLM-5-Turbo propose plusieurs modes de pensée adaptés à différents scénarios, permettant une réflexion approfondie avant de formuler une réponse.

2. Invocation d'Outils et Function Calling

Grâce à ses capacités de Function Calling, le modèle garantit une invocation précise des outils externes sans échec. Cela permet une transition fluide entre le dialogue et l'exécution concrète de tâches.

3. Sortie en Streaming

Pour améliorer l'interaction avec l'utilisateur, GLM-5-Turbo supporte les réponses en temps réel via le streaming, réduisant la latence perçue lors de la génération de contenus longs.

4. Gestion du Contexte et Structured Output

- Context Caching : Un mécanisme intelligent de mise en cache pour optimiser les performances lors de conversations prolongées.

- Sortie Structurée : Support natif du format JSON pour faciliter l'intégration avec des systèmes tiers.

- MCP : Intégration flexible des outils et sources de données externes via le Model Context Protocol.

Cas d'Utilisation de GLM-5-Turbo

L'utilisation de GLM-5-Turbo s'étend bien au-delà du simple développement logiciel. Voici les principaux domaines d'application :

- Développement de Logiciels : Automatisation du code et configuration d'environnements.

- Analyse de Données et Finance : Traitement de flux de données massifs pour les professionnels du secteur.

- Création de Contenu : Génération de textes structurés et planification de campagnes marketing.

- Opérations d'Ingénierie : Gestion de tâches planifiées et persistantes nécessitant une compréhension temporelle.

- Recherche et Analyse : Extraction d'informations complexes à travers de longues chaînes logiques.

Selon le benchmark ZClawBench, l'utilisation des « Skills » (compétences) dans l'écosystème OpenClaw est passée de 26 % à 45 %, soulignant l'importance d'un modèle comme GLM-5-Turbo capable de gérer un écosystème d'agents modulaire.

Comment utiliser GLM-5-Turbo ?

L'intégration de GLM-5-Turbo est simplifiée par une API compatible et des SDK officiels (Python, Java). Voici comment effectuer un appel de base via cURL :

Appel de Base (Basic Call)

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer votre-cle-api" \

-d '{

"model": "glm-5-turbo",

"messages": [

{

"role": "user",

"content": "En tant qu'expert marketing, créez un slogan pour Z.AI."

}

],

"thinking": {

"type": "enabled"

},

"max_tokens": 4096,

"temperature": 1.0

}'

Appel en Streaming (Streaming Call)

Pour une réponse instantanée, il suffit d'ajouter le paramètre "stream": true dans le corps de votre requête JSON pour activer le flux de données continu de GLM-5-Turbo.

FAQ (Foire Aux Questions)

Quelle est la différence entre GLM-5 et GLM-5-Turbo ?

GLM-5-Turbo offre des améliorations substantielles par rapport au modèle GLM-5 standard, particulièrement dans les scénarios OpenClaw. Il est plus stable pour les tâches à longue chaîne et plus précis dans l'invocation d'outils externes.

Qu'est-ce que le ZClawBench ?

ZClawBench est un benchmark de bout en bout conçu spécifiquement par Z.AI pour évaluer les performances des agents dans l'écosystème OpenClaw. Il couvre des domaines comme la recherche d'information, la création de contenu et le développement logiciel.

GLM-5-Turbo supporte-t-il les tâches planifiées ?

Oui, le modèle a été optimisé pour comprendre les dimensions temporelles, permettant l'exécution ininterrompue de tâches planifiées et de processus longs sans perte de continuité.

Quels sont les formats de sortie supportés ?

En plus du texte brut, GLM-5-Turbo supporte les sorties structurées telles que le JSON, ce qui est idéal pour les intégrations API complexes.