GLM-5-Turbo

GLM-5-Turbo: Das fortschrittliche native OpenClaw-Sprachmodell für komplexe Agent-Workflows und präzise Tool-Invocations.

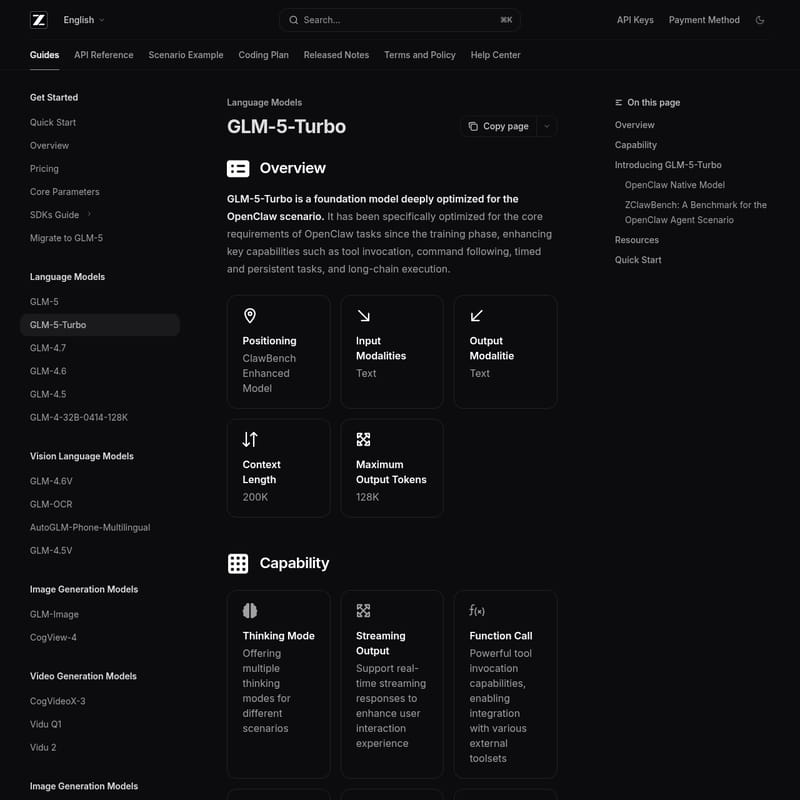

GLM-5-Turbo ist ein spezialisiertes Foundation-Modell der Z.AI Developer Plattform, das gezielt für das OpenClaw-Szenario optimiert wurde. Mit einer beeindruckenden Kontextlänge von 200K Token und einem maximalen Output von 128K Token setzt GLM-5-Turbo neue Maßstäbe in der Verarbeitung langer, komplexer Befehlsketten. Das Modell zeichnet sich durch exzellente Fähigkeiten in der Werkzeugaufrufung (Tool Calling), der präzisen Befolgung mehrschichtiger Instruktionen und der Verwaltung zeitgesteuerter, persistenter Aufgaben aus. Dank nativer Integration in das OpenClaw-Ökosystem und der Validierung durch den ZClawBench-Benchmark bietet GLM-5-Turbo eine überlegene Stabilität und Effizienz für Entwickler, Finanzexperten und Content-Ersteller, die hochperformante KI-Agenten in reale Geschäftsprozesse integrieren möchten.

2026-03-18

--K

GLM-5-Turbo Produktinformationen

GLM-5-Turbo: Die Evolution der OpenClaw Nativen Sprachmodelle

In der dynamischen Welt der künstlichen Intelligenz stellt das GLM-5-Turbo Modell einen signifikanten Fortschritt dar. Als Foundation-Modell, das tiefgreifend für das OpenClaw-Szenario optimiert wurde, bietet GLM-5-Turbo Entwicklern und Unternehmen eine robuste Basis für die Erstellung intelligenter Agenten. Von der Trainingsphase an wurde GLM-5-Turbo speziell darauf ausgerichtet, komplexe Anforderungen wie Tool-Invocations, das Befolgen von Befehlen und langkettige Ausführungen mit höchster Präzision zu bewältigen.

Was ist GLM-5-Turbo?

GLM-5-Turbo ist ein hochleistungsfähiges Sprachmodell (Large Language Model), das als OpenClaw Native Model konzipiert wurde. Es ist darauf spezialisiert, reale Agent-Workflows abzubilden, die weit über einfache Dialoge hinausgehen. Das Modell fungiert als Herzstück für Anwendungen, die eine tiefe Integration in externe Systeme und eine stabile Ausführung von Aufgaben über lange Zeiträume erfordern.

Die Positionierung von GLM-5-Turbo ist klar definiert: Es ist ein ClawBench Enhanced Model, das Text als Eingabe- und Ausgabemodalität nutzt. Mit einer Kontextlänge von 200K und einer maximalen Kapazität von 128K Output-Tokens ist es prädestiniert für datenintensive Prozesse und komplexe logische Ketten.

Features von GLM-5-Turbo

Das Modell zeichnet sich durch eine Reihe von Kernkompetenzen aus, die es von herkömmlichen Sprachmodellen abheben:

Fortschrittliche Thinking Modes

GLM-5-Turbo bietet verschiedene Thinking Modes (Denkmodi), die auf unterschiedliche Szenarien zugeschnitten sind. Dies ermöglicht es dem Modell, Probleme strukturiert zu durchdenken, bevor eine Antwort generiert wird.

Präzises Tool Calling

Die Fähigkeit zur Werkzeugaufrufung wurde massiv gestärkt. GLM-5-Turbo garantiert eine präzise Invokation ohne Fehler, was die Stabilität in Multi-Step-Tasks erhöht. Damit transformiert GLM-5-Turbo reine Konversationen in echte produktive Ausführungen.

Instruction Following auf höchstem Niveau

Komplexe, mehrschichtige und langkettige Instruktionen werden von GLM-5-Turbo besser dekomponiert. Das Modell identifiziert Ziele exakt, plant notwendige Schritte und unterstützt die kollaborative Aufgabenteilung zwischen mehreren Agenten.

Optimierung für persistente Aufgaben

Ein besonderes Merkmal ist das Verständnis für die zeitliche Dimension. GLM-5-Turbo ist für geplante (scheduled) und persistente Aufgaben optimiert. Es behält die Kontinuität bei lang laufenden Prozessen bei und versteht zeitbezogene Anforderungen besser als Vorgängermodelle.

Technische Spezifikationen im Überblick

- Modellname: GLM-5-Turbo

- Kontextfenster: 200.000 Token

- Maximaler Output: 128.000 Token

- Streaming Output: Unterstützung von Echtzeit-Streaming für verbesserte Interaktion.

- Structured Output: Unterstützung von Formaten wie JSON für nahtlose Systemintegration.

- Context Caching: Intelligenter Mechanismus zur Leistungsoptimierung bei langen Konversationen.

- MCP Integration: Flexible Einbindung externer MCP-Tools und Datenquellen.

Use Case Szenarien

GLM-5-Turbo findet Anwendung in einer Vielzahl von professionellen Bereichen:

- Softwareentwicklung: Automatisierung von Environment-Setups und Code-Analysen.

- Finanzwesen: Komplexe Datenanalysen und die Erstellung von Berichten durch spezialisierte Agenten.

- Content Creation: Unterstützung für Content-Ersteller bei der Planung und Generierung umfangreicher Inhalte.

- Operations Engineering: Verwaltung von Workflows, die eine hohe Datendurchsatzrate und stabile logische Ketten erfordern.

- Research: Informationsbeschaffung und strukturierte Aufbereitung wissenschaftlicher Daten.

Durch den Anstieg der Skill-Nutzung von 26% auf 45% zeigt sich, dass GLM-5-Turbo perfekt in ein modular aufgebautes, skill-getriebenes Agent-Ökosystem passt.

How to Use: Integration von GLM-5-Turbo

Die Einbindung von GLM-5-Turbo in Ihre Projekte erfolgt unkompliziert über die Z.AI API. Hier ist ein Beispiel für einen Basis-Aufruf mittels cURL:

Hinweis: Ersetzen Sie

your-api-keydurch Ihren persönlichen API-Schlüssel.

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer your-api-key" \

-d '{

"model": "glm-5-turbo",

"messages": [

{

"role": "user",

"content": "Erstelle einen Slogan für die Z.AI Open Platform."

}

],

"thinking": {

"type": "enabled"

},

"max_tokens": 4096,

"temperature": 1.0

}'

Für interaktive Anwendungen wird zudem ein Streaming Call unterstützt, bei dem der Parameter "stream": true gesetzt wird, um Antworten in Echtzeit zu erhalten.

FAQ - Häufig gestellte Fragen

F: Was unterscheidet GLM-5-Turbo von GLM-5? A: GLM-5-Turbo wurde spezifisch für OpenClaw-Szenarien optimiert. Laut ZClawBench-Ergebnissen liefert es erhebliche Verbesserungen in den Bereichen Tool-Calling, Befolgung komplexer Instruktionen und bei Aufgaben mit hohem Datendurchsatz.

F: Was ist ZClawBench? A: ZClawBench ist ein End-to-End-Benchmark, der speziell für Agent-Aufgaben im OpenClaw-Ökosystem entwickelt wurde. Er bewertet die Leistung in realen Anwendungsfällen wie Softwareentwicklung und Datenanalyse.

F: Unterstützt GLM-5-Turbo strukturierte Daten? A: Ja, das Modell unterstützt Structured Output (z. B. JSON), was die Integration in bestehende IT-Infrastrukturen und automatisierte Workflows erheblich erleichtert.

F: Wie groß ist das Kontextfenster? A: GLM-5-Turbo bietet ein großzügiges Kontextfenster von 200.000 Token, was die Verarbeitung sehr langer Dokumente und Konversationsverläufe ermöglicht.