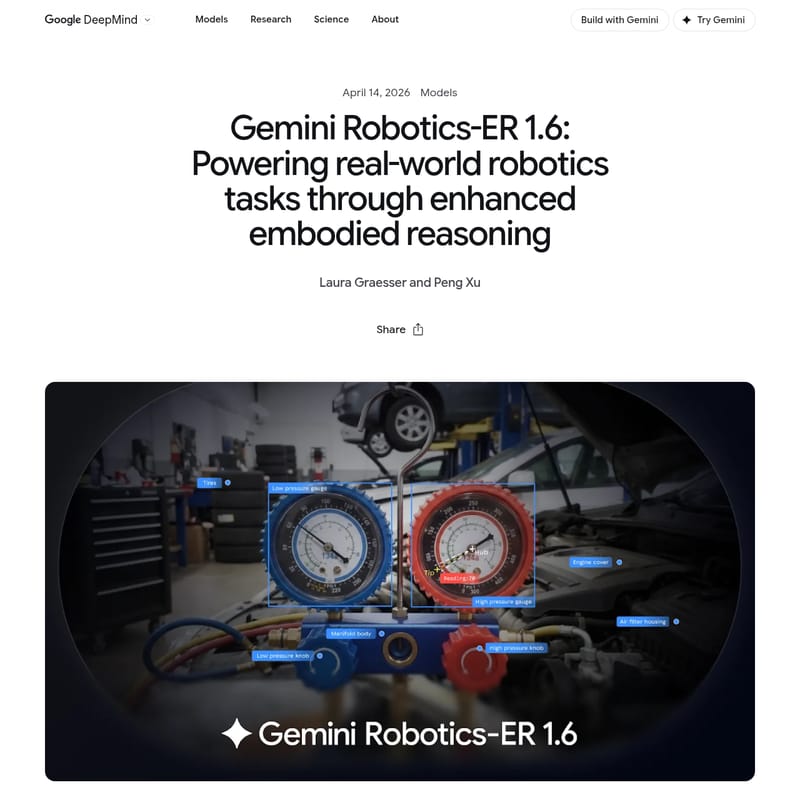

Gemini Robotics ER 1.6

Gemini Robotics-ER 1.6: Die neue Ära des verkörperten Denkens für die Robotik von Google DeepMind

Gemini Robotics-ER 1.6 ist ein fortschrittliches KI-Modell für das verkörperte Denken (Embodied Reasoning), das Robotern hilft, ihre physische Umgebung präzise zu verstehen und komplexe Aufgaben autonom auszuführen. Durch Verbesserungen in der räumlichen Wahrnehmung, Multiview-Bildverarbeitung und Instrumentenablesung schließt es die Lücke zwischen digitaler Intelligenz und physischer Aktion.

2026-04-17

4704.8K

Gemini Robotics ER 1.6 Produktinformationen

Gemini Robotics-ER 1.6: Präzises Embodied Reasoning für die Robotik

Für Roboter ist es in modernen Industrien und im Alltag unerlässlich, nicht nur einfachen Anweisungen zu folgen, sondern die physische Welt aktiv zu begreifen. Mit der Einführung von Gemini Robotics-ER 1.6 präsentiert Google DeepMind ein signifikantes Upgrade für das verkörperte Denken (Embodied Reasoning), das die Brücke zwischen digitaler Intelligenz und physischer Aktion schlägt.

Was ist Gemini Robotics-ER 1.6?

Gemini Robotics-ER 1.6 ist ein spezialisiertes KI-Modell, das als hochgradiges Denkmodell für Roboter fungiert. Es ermöglicht physischen Agenten, ihre Umgebung mit beispielloser Präzision zu verstehen, räumliche Zusammenhänge zu analysieren und komplexe Aufgaben autonom zu planen.

Im Vergleich zu Vorgängermodellen wie Gemini Robotics-ER 1.5 oder Gemini 3.0 Flash bietet Gemini Robotics-ER 1.6 erhebliche Verbesserungen in den Bereichen visuelles Verständnis, Aufgabenplanung und Erfolgserkennung. Das Modell kann nativ Werkzeuge wie die Google-Suche oder Vision-Language-Action-Modelle (VLAs) aufrufen, um Informationen zu beschaffen oder Befehle auszuführen.

Features von Gemini Robotics-ER 1.6

Das Modell zeichnet sich durch eine Reihe von technologischen Fortschritten aus, die speziell auf die Anforderungen der Robotik zugeschnitten sind:

Fortschrittliches Pointing (Zeigen)

Das Zeigen ist die Grundlage für räumliches Denken. Gemini Robotics-ER 1.6 nutzt Punkte, um komplexe Konzepte auszudrücken:

- Präzise Objekterkennung: Zählen und Identifizieren von Gegenständen (z. B. Hämmer, Scheren, Pinsel).

- Relationale Logik: Vergleiche anstellen, wie das Finden des kleinsten Objekts.

- Bewegungsplanung: Kartierung von Trajektorien und Identifizierung optimaler Griffpunkte.

- Constraint-Einhaltung: Verständnis komplexer Bedingungen, wie z. B. "Zeige auf alle Objekte, die klein genug für diesen Becher sind".

Multiview-Erfolgserkennung

In der Robotik ist die Erfolgserkennung der Motor der Autonomie. Gemini Robotics-ER 1.6 kann Informationen aus mehreren Kameraperspektiven (z. B. Überkopfkameras und Handgelenkkameras) kombinieren, um zu entscheiden, ob eine Aufgabe erfolgreich abgeschlossen wurde oder ein neuer Versuch notwendig ist.

Instrumentenablesung (Instrument Reading)

Durch die Kombination von räumlichem Denken und Weltwissen kann das Modell komplexe Instrumente wie:

- Analoge Druckmanometer

- Vertikale Füllstandsanzeigen

- Digitale Anzeigen präzise auswerten. Dies geschieht durch Agentic Vision, bei der das Modell Details heranzoomt und Code ausführt, um Proportionen und Intervalle exakt zu berechnen.

Höchste Sicherheitsstandards

Gemini Robotics-ER 1.6 ist das bisher sicherste Robotikmodell. Es zeigt eine überlegene Einhaltung von Sicherheitsrichtlinien bei räumlichen Aufgaben und erkennt Verletzungsrisiken in Text- und Videoszenarien deutlich besser als bisherige Modelle.

Use Case: Einsatzbereiche in der Praxis

Die Anwendungsmöglichkeiten von Gemini Robotics-ER 1.6 sind vielfältig und zielen auf reale Herausforderungen ab:

- Industrielle Inspektion: In Zusammenarbeit mit Boston Dynamics wird das Modell eingesetzt, um den Roboter Spot zu befähigen, Thermometer und Manometer in Anlagen autonom zu überwachen.

- Komplexe Manipulation: Roboter können in dynamischen Umgebungen Aufgaben wie das Einräumen von Gegenständen übernehmen, indem sie Hindernisse und Verdeckungen durch Multiview-Reasoning verstehen.

- Sicherheitskritische Aufgaben: Dank verbesserter physischer Sicherheitsaspekte kann das Modell entscheiden, welche Objekte unter Berücksichtigung von Materialbeschränkungen (z. B. "keine Flüssigkeiten handhaben") sicher bewegt werden können.

FAQ (Häufig gestellte Fragen)

Wie unterscheidet sich Gemini Robotics-ER 1.6 von Gemini 3.0 Flash? Gemini Robotics-ER 1.6 zeigt eine signifikant bessere Leistung bei spezifischen Robotik-Aufgaben wie dem Pointing, der Erfolgserkennung und der räumlichen Analyse, während Gemini 3.0 Flash eher als allgemeines Basismodell dient.

Was ist Agentic Vision? Agentic Vision kombiniert visuelles Denken mit Code-Ausführung. Das Modell kann beispielsweise in ein Bild hineinzoomen, um kleine Details einer Anzeige besser zu lesen und mathematische Operationen zur Schätzung von Werten durchzuführen.

Ist das Modell für Entwickler zugänglich? Ja, Gemini Robotics-ER 1.6 ist über die Gemini API und im Google AI Studio verfügbar. Es gibt zudem ein Entwickler-Colab mit Beispielen zur Konfiguration und zum Prompting.

Welche Rolle spielt die Erfolgserkennung? Die Erfolgserkennung ermöglicht es dem Roboter, autonom zu entscheiden, ob eine Phase eines Plans abgeschlossen ist oder ob er eine Handlung wiederholen muss, was die Grundlage für echtes autonomes Handeln bildet.

"Fähigkeiten wie die Instrumentenablesung und ein zuverlässigeres Denken über Aufgaben werden es Spot ermöglichen, Herausforderungen in der realen Welt völlig autonom zu sehen, zu verstehen und darauf zu reagieren." — Marco da Silva, Vice President bei Boston Dynamics