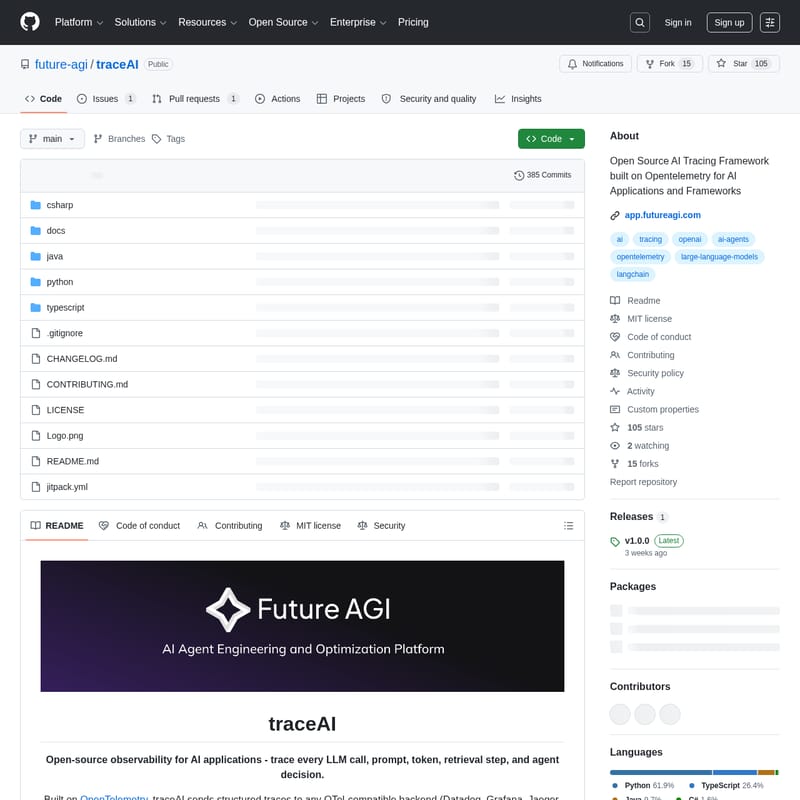

traceAI

traceAI:基于 OpenTelemetry 的开源 AI 应用可观测性追踪框架

traceAI 是一款开源的 AI 应用追踪库,专为大语言模型(LLM)开发。它基于 OpenTelemetry 标准,能够全面捕获 LLM 调用、提示词、Token 使用、检索步骤及智能体决策。traceAI 支持 Python、TypeScript、Java 和 C# 等多语言,可将结构化追踪数据发送至 Datadog、Grafana 等任何兼容 OTel 的后端,实现零配置、无厂商锁定的 AI 可观测性。

2026-04-03

534773.1K

traceAI 产品信息

traceAI:面向 AI 应用的开源可观测性追踪框架

在生成式人工智能飞速发展的今天,了解 AI 应用的内部运行机制至关重要。traceAI 是一款专为 AI 应用打造的开源可观测性框架,旨在帮助开发者追踪每一次 LLM 调用、提示词(Prompt)、Token 消耗、检索步骤以及智能体(Agent)决策过程。通过 traceAI,您可以获得 AI 工作流的深度可见性,从而优化性能并确保系统的稳定性。

什么是 traceAI?

traceAI 是一个基于 OpenTelemetry (OTel) 行业标准的开源库,能够为您的 AI 应用程序提供全方位的监控。它不仅捕获基础的请求数据,还能记录结构化的追踪信息,并将其发送到您现有的观测工具中,如 Datadog、Grafana、Jaeger 或 Future AGI。

使用 traceAI 的核心优势在于它不绑定任何特定的供应商或仪表盘。只要您的后端兼容 OpenTelemetry,traceAI 就能无缝接入。它支持 50 多种 AI 框架,涵盖 Python、TypeScript、Java 和 C# 四大主流编程语言,真正实现了跨平台的 AI 追踪。

traceAI 的核心特性

1. 标准化追踪 (Standardized Tracing)

traceAI 将复杂的 AI 工作流映射为一致的 OpenTelemetry Spans 和属性,确保所有追踪数据符合行业标准。

2. 零配置安装 (Zero-Config Setup)

通过掉入式(Drop-in)插桩技术,开发者只需极少的代码改动即可启动 traceAI,实现快速部署。

3. 多框架与多语言支持

traceAI 已集成超过 50 种 AI 框架,支持包括 OpenAI、Anthropic、LangChain、LlamaIndex 在内的流行工具,覆盖 Python、TypeScript、Java 和 C#。

4. 供应商无关 (Vendor Agnostic)

由于构建在 OpenTelemetry 之上,traceAI 生成的数据可以发送到任何兼容 OTel 的后端。无需引入新供应商,无需学习新的 UI。

5. 丰富的上下文捕获

traceAI 能够自动记录:

- 提示词与补全结果:完整的请求和响应内容。

- Token 使用量:包括输入、输出及总 Token 数。

- 模型参数:如 Temperature、Top_p、Max_tokens 等。

- 工具调用:函数名称、参数及返回结果。

- 流式传输:追踪增量块及数据流。

- 错误处理:详细的异常上下文与堆栈跟踪。

如何使用 traceAI

traceAI 针对不同语言提供了简洁的集成方式:

Python 快速入门

- 安装:

pip install traceai-openai - 初始化:

import os

from fi_instrumentation import register

from traceai_openai import OpenAIInstrumentor

import openai

# 注册追踪提供者

trace_provider = register(project_name="my_ai_app")

# 插桩 OpenAI

OpenAIInstrumentor().instrument(tracer_provider=trace_provider)

# 正常使用 OpenAI,追踪将自动完成!

TypeScript 快速入门

- 安装:

npm install @traceai/openai @traceai/fi-core - 初始化:

import { register } from "@traceai/fi-core";

import { OpenAIInstrumentation } from "@traceai/openai";

import { registerInstrumentations } from "@opentelemetry/instrumentation";

const tracerProvider = register({ projectName: "my_ai_app" });

registerInstrumentations({

tracerProvider,

instrumentations: [new OpenAIInstrumentation()]

});

典型使用场景 (Use Case)

性能优化与延迟分析

通过 traceAI 捕获的每个步骤耗时,开发者可以定位 AI 链条中的瓶颈。例如,分析是向量数据库检索慢,还是 LLM 生成响应耗时过长。

成本监控与管理

利用 traceAI 记录的 Token 消耗数据,团队可以精确计算不同模型、不同用户的资源开销,从而更好地控制项目预算。

调试智能体决策流

在复杂的 Agent 系统中,traceAI 可以记录智能体做出的每一个决策、调用的每一个工具及其结果。这对于理解智能体为何产生特定输出至关重要。

生产环境监控

traceAI 采用异步支持和性能优化设计,非常适合在生产环境中使用。它能实时捕获错误和异常,并提供详细的上下文用于快速排查问题。

常见问题 (FAQ)

Q: traceAI 是否会锁定我的数据? A: 不会。traceAI 基于 OpenTelemetry 开源标准,您可以自由地将数据导出到任何支持 OTel 的平台,不存在厂商锁定问题。

Q: 使用 traceAI 会显著增加应用延迟吗? A: traceAI 经过生产级优化,支持异步操作,旨在以极低的开销提供强大的追踪能力。

Q: 它支持哪些 AI 模型提供商? A: traceAI 目前支持 OpenAI、Anthropic、Google Vertex AI、AWS Bedrock、Mistral AI、Groq、Ollama、DeepSeek 等众多主流供应商。

Q: traceAI 是否可以追踪向量数据库? A: 是的,traceAI 支持 Pinecone、ChromaDB、Qdrant、Milvus、Weaviate、MongoDB 等多种向量数据库的追踪。