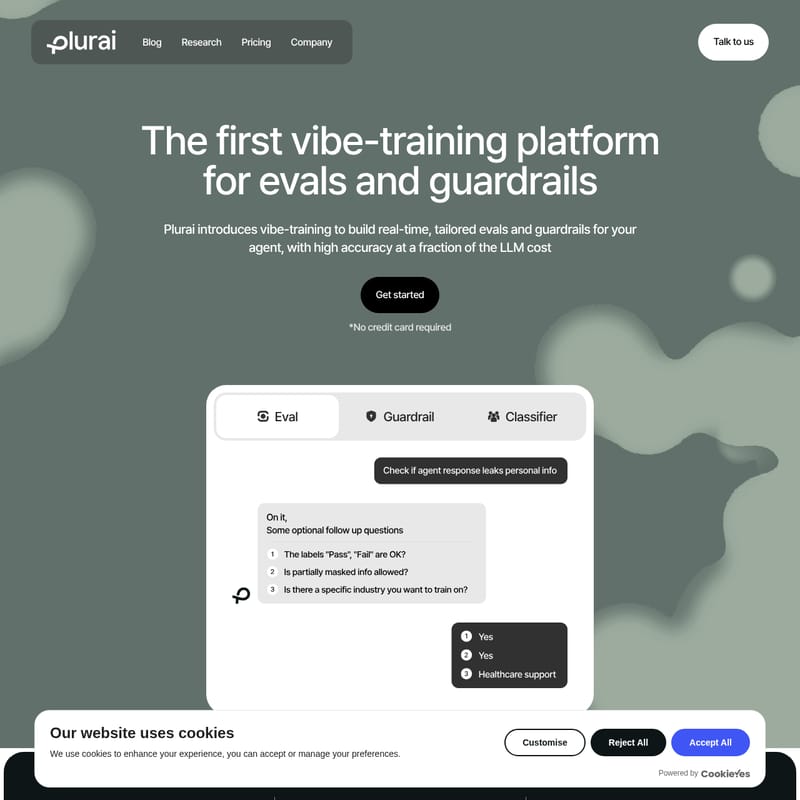

Plurai

Plurai:首个 Vibe-training 驱动的 AI 代理评估与防护栏优化平台

Plurai 是一款革命性的 Vibe-training 平台,专为 AI 代理(Agents)提供实时、定制化的评估(Evals)与防护栏(Guardrails)。通过优化的 SLM 模型,Plurai 在保证高准确率的同时,将推理成本降低至 GPT 5.2 的八分之一以下,延迟缩短至 100ms 以内,助力企业实现生产级的 AI 安全与效能。

2026-05-01

--K

Plurai 产品信息

Plurai:首个 Vibe-training 驱动的 AI 代理评估与防护栏平台

在人工智能驱动的业务场景中,如何平衡 AI 代理(Agents)的生成速度与输出安全性始终是一个核心挑战。Plurai 作为全球首个引入 Vibe-training 技术的平台,致力于为开发者提供实时、量身定制的**评估(Evals)与防护栏(Guardrails)**方案。通过 Plurai,企业可以在保持极高准确率的前提下,以远低于传统大语言模型(LLM)的价格实现 AI 应用的稳健运行。

什么是 Plurai?

Plurai 是一个专注于 AI 代理性能优化与合规性的先进平台。它引入了创新的 Vibe-training 模式,旨在为 AI 代理构建实时的、量身定制的评估(Evals)系统和防护栏(Guardrails)。

与传统的“LLM-as-judge”(大模型作为评判者)方法不同,Plurai 采用了经过优化的小语言模型(SLMs)。这种方法不仅能够提供生产级别的评估覆盖率,还能显著解决传统方式中成本昂贵、难以全量覆盖生产数据的痛点。Plurai 旗下的 Proton 产品系列,正是为了消除 AI 开发过程中“速度与安全”的权衡而设计的。

Plurai 的核心特性 (Features)

1. 卓越的性能表现

Plurai 在多项关键指标上超越了主流的大模型(如 GPT 5.2):

- 失败率降低:相比 GPT 5.2,使用 Plurai 的评估系统可将故障率降低 43% 以上。

- 极速响应:推理延迟低于 100ms,完全满足实时交互场景的需求。

- 高准确率:通过专用模型训练,确保在语义任务中表现出极高的精确度。

2. 极致的成本优势

Plurai 的 SLMs(小语言模型) 经过特殊优化,其运行成本仅为 GPT 5.2 的 1/8。这使得企业能够在不承担巨额计算支出的情况下,对全量生产数据进行不间断的**评估(Evals)和防护栏(Guardrails)**监控。

3. 专利意图校准技术 (Intent Calibration)

Plurai 使用专有的意图校准流程来深度理解用户的特定任务。即使您没有历史标记数据,Plurai 也能通过**合成数据生成(Synthetic Data Generation)**技术,为您定制高质量的测试集和一致的评估器。

4. 灵活的部署方案

为了满足数据安全和隐私的高标准要求,Plurai 支持在用户的 VPC(虚拟私有云) 中进行本地化(On-prem)部署。这不仅增强了数据控制权,还进一步降低了网络延迟。

5. 多样化的模型选择

除了核心的 SLMs,Plurai 还提供经过优化的 LLM 评估器。SLM 适用于大规模实时测试和防护栏,而 LLM 评估器则非常适合样本数据分析和离线评估工作流。

Plurai 的典型应用场景 (Use Case)

Plurai 的模型和技术可以广泛应用于各类语义任务中,帮助开发者提升 AI 代理的可靠性:

- 对话评估 (Conversation Evaluation):实时分析 AI 代理与用户的对话质量,确保交互符合预期。

- 语义相似度 (Semantic Similarity):检测文本间的语义偏差,优化搜索或匹配逻辑。

- 接地性验证 (Grounding Validation):确保 AI 代理的回答基于事实或特定文档库,减少幻觉现象。

- 政策合规性 (Policy Compliance):通过定制防护栏(Guardrails),确保 AI 输出符合企业安全政策和法律法规。

- 大规模生产监控:利用 SLM 的低成本特性,对生产环境中的每一条指令进行实时合规性扫描。

如何使用 Plurai 构建评估与防护栏?

Plurai 的使用流程旨在简化 AI 开发者的工作流:

- 意图校准:首先,通过 Plurai 的意图校准流程明确您的任务目标。系统会深度解析您的业务逻辑。

- 数据准备:如果您缺乏历史标记数据集,Plurai 将为您生成高保真的合成数据,这些数据专门针对您的用例进行了优化。

- 模型训练与优化:基于校准后的意图和数据,Plurai 会训练专门的 SLM 评估器。这些模型针对特定任务进行了高度优化,而非泛化的通用模型。

- 集成与部署:您可以将生成的**评估(Evals)和防护栏(Guardrails)**集成到您的 AI 代理中。支持云端 API 调用或 VPC 私有化部署。

- 持续迭代:在生产环境中运行模型,利用 Plurai 的分类器(Classifier)持续监控性能并减少失败率。

常见问题解答 (FAQ)

Q1: 如何在我的 AI 代理上使用评估和防护栏?

您可以将 Plurai 的模型应用于广泛的语义任务,包括对话评估、语义相似度、接地性验证、政策合规性等。您可以参考我们的用例目录来探索更多可能性。

Q2: Plurai 与我现有的评估方式有什么不同?

Plurai 使用专有的意图校准流程来深度理解您的任务。这使得我们能够生成由优化后的 SLMs 驱动的生产级评估器。相比传统昂贵且难以覆盖全量数据的“LLM-as-judge”方法,Plurai 更加经济高效且具备可扩展性。

Q3: Plurai 支持本地化部署(On-prem)吗?

是的。Plurai 可以部署在您的 VPC 中,以实现最高级别的安全性和数据控制,同时还能获得更低的延迟。欢迎联系我们讨论您的基础设施要求。

Q4: 为什么你们的小语言模型(SLMs)如此准确且具成本效益?

我们的 SLMs 是通过意图校准和合成数据生成流程专为您的特定任务构建的。我们不依赖通用大模型,而是通过在高度针对性的数据集上训练评估器。这使得我们在保持高准确率的同时,大幅降低了推理成本和延迟。

Q5: Plurai 只提供 SLMs 吗?

不是的。除了针对大规模任务优化的 SLMs,我们还提供经过优化的 LLM 评估器,以在样本数据或离线评估中实现最高的准确率。您可以根据业务规模和实时性要求灵活选择。

了解更多关于 Plurai 的最新研究成果或阅读我们的技术论文,请访问官方博客。立即通过 Plurai 将您的 AI 代理提升至工业级标准。