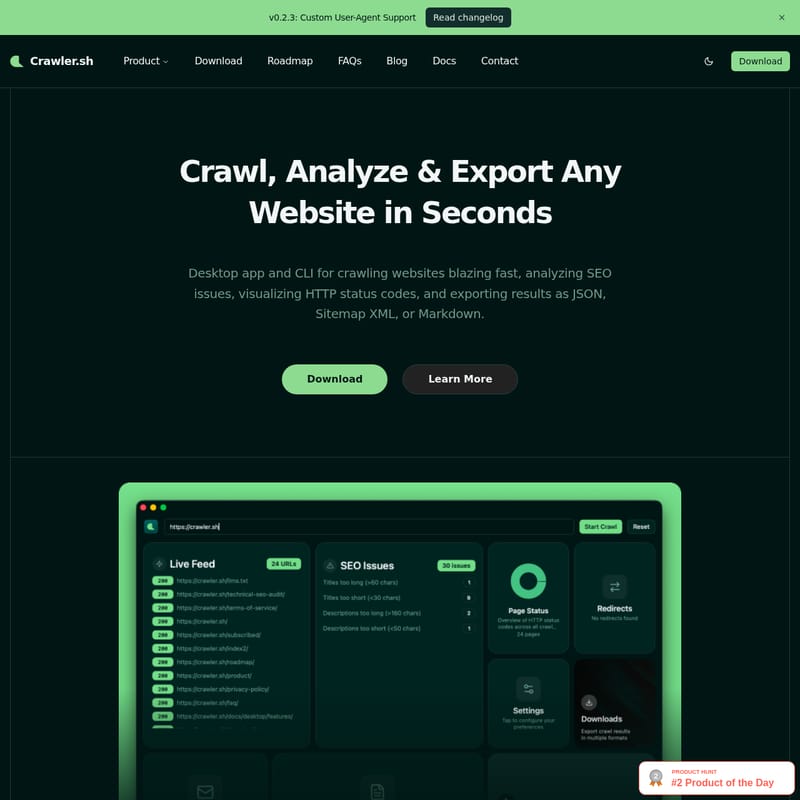

Crawler.sh

Crawler.sh — мощный инструмент для SEO-аудита, парсинга контента и генерации Sitemap XML в форматах JSON и Markdown

Crawler.sh — это высокопроизводительное десктопное приложение и CLI-инструмент для сканирования веб-сайтов, глубокого SEO-анализа и извлечения контента. Программа позволяет мгновенно обходить тысячи страниц, выявлять критические SEO-ошибки, такие как дубликаты мета-описаний и отсутствующие заголовки, а также конвертировать страницы в чистый Markdown. Инструмент поддерживает экспорт в NDJSON, JSON и Sitemap XML, обеспечивая полный контроль над данными локально и приватно.

2026-03-04

--K

Crawler.sh Информация о продукте

Crawler.sh: Мощный инструмент для сканирования, анализа и экспорта веб-сайтов

В современном мире поисковой оптимизации скорость и точность данных имеют решающее значение. Crawler.sh — это профессиональное решение, объединяющее в себе десктопное приложение и мощный интерфейс командной строки (CLI), созданное для тех, кому нужно сканировать сайты за считанные секунды, анализировать SEO-показатели и экспортировать результаты в удобных форматах.

Что такое Crawler.sh?

Crawler.sh представляет собой высокопроизводительный инструмент для веб-краулинга, который позволяет обходить целые домены, анализировать HTTP-коды состояния и визуализировать структуру сайта. Это локальное решение, ориентированное на приватность, которое работает непосредственно на вашем компьютере. С версией v0.2.3 продукт также получил поддержку Custom User-Agent, что расширяет возможности обхода различных ресурсов.

Основные возможности сканирования

- Мгновенный обход сайтов: Сканирование тысяч страниц в рамках одного домена.

- Гибкая конфигурация: Настройка параллелизма (concurrency), лимитов глубины и вежливых задержек между запросами.

- Локальная работа: Все данные обрабатываются на вашей машине, обеспечивая максимальную конфиденциальность.

Особенности и функции Crawler.sh

Продукт предлагает широкий спектр функций, которые делают его незаменимым для SEO-специалистов и разработчиков.

1. Глубокий SEO-анализ

Crawler.sh автоматически выполняет 16 проверок на каждой странице. Система находит:

- Отсутствующие заголовки (Titles).

- Дубликаты мета-описаний.

- Директивы noindex.

- Тонкий контент (thin content).

- Слишком длинные URL-адреса и многое другое.

2. Извлечение контента в Markdown

Одной из уникальных особенностей является автоматическое извлечение основного контента статьи и его конвертация в чистый Markdown. Дополнительно для каждой страницы собираются:

- Количество слов.

- Имя автора.

- Краткий отрывок (excerpt).

3. Множественные форматы вывода

Результаты работы можно сохранять в различных форматах:

- NDJSON и JSON: Для дальнейшей обработки программными методами.

- Sitemap XML: Полностью соответствующий стандартам W3C.

- CSV и TXT: Для удобных SEO-отчетов и командной работы.

- Markdown: Для архивации контента.

Варианты использования (Use Cases)

Crawler.sh адаптируется под любые рабочие процессы, от быстрых проверок до сложных конвейеров данных.

SEO-аудит

Запускайте автоматизированные проверки для поиска технических ошибок до того, как они повлияют на рейтинг сайта в поисковых системах. Экспортируйте отчеты об ошибках и передавайте их команде разработки.

Архивация контента

Идеально подходит для бэкапов или миграции сайтов. Извлекайте читаемое содержимое страниц в формате Markdown для последующего использования в других инструментах или базах знаний.

Генерация карт сайта (Sitemap)

Создавайте актуальные файлы Sitemap XML на основе реального сканирования живого сайта, избавляясь от необходимости ручного обслуживания.

Мониторинг сайта

Регулярно сканируйте свои ресурсы для обнаружения битых ссылок, отсутствующих страниц и изменений в кодах состояния HTTP, обеспечивая бесперебойную работу для пользователей.

Как использовать Crawler.sh

Инструмент предлагает два основных интерфейса: CLI Tool и Desktop Pro.

Использование через CLI

Интерфейс командной строки позволяет интегрировать сканер в автоматизированные цепочки. Пример базового сканирования:

crawler crawl https://example.com

Эта команда запустит обход сайта с настройками по умолчанию (100 страниц, глубина 10) и создаст файл example-com.crawl в формате NDJSON. Доступны дополнительные подкоманды: info, export, seo.

Использование Desktop Pro

Десктопная версия предоставляет визуальную панель управления:

- Интерактивные карты: 8 карточек для визуализации данных.

- Лента в реальном времени: Отслеживание хода сканирования с бейджами статусов.

- SEO-панель: Детальная информация по каждому URL.

Стоимость и тарифы

Crawler.sh предлагает единую подписку, которая открывает доступ сразу к обоим инструментам:

- CLI Tool / Desktop Pro: $99 в год.

- Включает 16 категорий SEO-анализа.

- Экспорт в NDJSON, JSON, Sitemap XML, CSV.

- Извлечение контента в Markdown.

Часто задаваемые вопросы (FAQ)

В: Какие форматы экспорта поддерживает Crawler.sh? О: Вы можете экспортировать данные в форматах NDJSON, JSON, Sitemap XML (W3C-compliant), CSV, TXT и Markdown.

В: Сколько SEO-проверок выполняет инструмент? О: Система автоматически проводит 16 различных тестов на каждой просканированной странице, выявляя критические проблемы оптимизации.

В: Можно ли настроить User-Agent? О: Да, начиная с версии v0.2.3, реализована поддержка Custom User-Agent.

В: Работает ли программа в облаке или локально? О: Это локальное приложение (Desktop и CLI), что гарантирует скорость работы и приватность ваших данных.

Crawler.sh — это комплексное решение для тех, кому нужен быстрый, надежный и глубокий анализ веб-ресурсов прямо на рабочем столе.