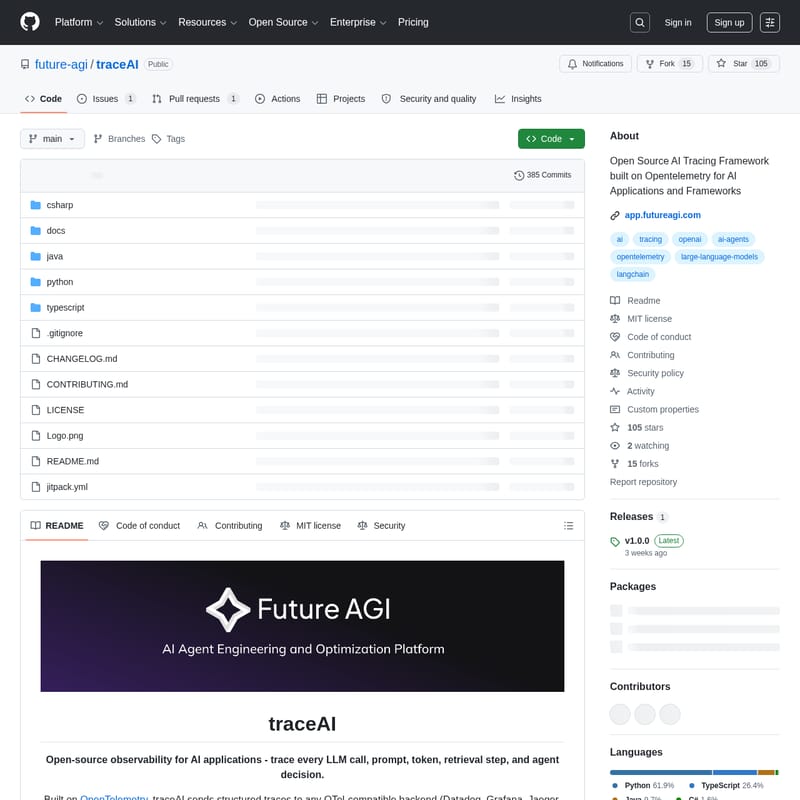

traceAI

traceAI - Open-source'owe śledzenie i obserwowalność dla aplikacji AI oparte na OpenTelemetry

traceAI to zaawansowana biblioteka open-source przeznaczona do pełnej obserwowalności aplikacji AI. Zbudowana na standardzie OpenTelemetry, umożliwia monitorowanie każdego wywołania LLM, promptu, zużycia tokenów oraz decyzji agentów. Dzięki traceAI deweloperzy mogą przesyłać ustrukturyzowane ślady do dowolnego backendu kompatybilnego z OTel, takiego jak Datadog, Grafana czy Jaeger, bez konieczności wdrażania nowych pulpitów nawigacyjnych. Narzędzie obsługuje ponad 50 frameworków AI w językach Python, TypeScript, Java oraz C#, oferując gotowe instrumentacje dla najpopularniejszych modeli i baz wektorowych.

2026-04-03

534773.1K

traceAI Informacje o produkcie

traceAI: Kompleksowa Obserwowalność Open-Source dla Twoich Aplikacji AI

W dobie gwałtownego rozwoju sztucznej inteligencji, monitorowanie zachowania modeli staje się kluczowe dla sukcesu projektów technologicznych. traceAI to innowacyjna biblioteka typu open-source, która zapewnia pełną widoczność wewnątrz aplikacji AI. Pozwala ona na śledzenie każdego wywołania LLM, promptu, liczby tokenów, kroków wyszukiwania (retrieval) oraz decyzji podejmowanych przez agentów.

Czym jest traceAI?

traceAI to narzędzie klasy enterprise służące do obserwowalności (observability), które integruje się bezpośrednio z Twoim istniejącym ekosystemem monitoringu. Zbudowane w oparciu o OpenTelemetry (OTel) – branżowy standard obserwowalności aplikacji – traceAI przesyła ustrukturyzowane ślady (traces) do dowolnego backendu zgodnego z OTel, takiego jak Datadog, Grafana, Jaeger czy Future AGI.

Największą zaletą traceAI jest brak konieczności wiązania się z nowym dostawcą usług (no vendor lock-in) oraz brak potrzeby nauki obsługi kolejnych interfejsów. Twoje dane dotyczące AI żyją natywnie tam, gdzie reszta metryk Twojej infrastruktury.

Kluczowe Funkcje traceAI

System traceAI został zaprojektowany z myślą o nowoczesnych zespołach inżynierskich, oferując bogaty zestaw funkcjonalności:

- Standardowe Śledzenie (Standardized Tracing): Mapuje przepływy pracy AI na spójne spany i atrybuty OpenTelemetry.

- Konfiguracja Zero-Config: Oferuje gotowe instrumentacje, które wymagają minimalnych zmian w kodzie źródłowym.

- Wsparcie dla wielu Frameworków: Obsługuje ponad 50 integracji, w tym popularne rozwiązania takie jak OpenAI, LangChain czy LlamaIndex.

- Niezależność od Dostawcy: Współpracuje z każdym backendem kompatybilnym z OpenTelemetry.

- Bogaty Kontekst Danych: Przechwytuje nie tylko prompty i odpowiedzi, ale także parametry modelu (temperature, top_p), wywołania narzędzi oraz błędy.

- Gotowość Produkcyjna: Obsługuje asynchroniczność, streaming danych oraz jest zoptymalizowany pod kątem wydajności.

Obsługiwane Frameworki i Technologie

traceAI oferuje szerokie wsparcie w czterech głównych językach programowania:

1. Python

Obsługuje dostawców LLM takich jak OpenAI, Anthropic, Google Vertex AI, Mistral AI oraz frameworki agentowe: LangChain, CrewAI i AutoGen. Wspiera także bazy wektorowe: Pinecone, ChromaDB i Milvus.

2. TypeScript

Zapewnia wsparcie dla Vercel AI SDK, LangChain.js oraz licznych dostawców chmurowych i baz danych takich jak MongoDB Atlas czy Redis.

3. Java i C#

Dostępne poprzez JitPack i NuGet, oferują wsparcie dla kluczowych bibliotek, w tym Spring AI, LangChain4j oraz Semantic Kernel.

Jak korzystać z traceAI (Quickstart)

Python

-

Zainstaluj bibliotekę:

pip install traceai-openai -

Zainstrumentuj aplikację:

import os

from fi_instrumentation import register

from fi_instrumentation.fi_types import ProjectType

from traceai_openai import OpenAIInstrumentor

import openai

# Rejestracja providera

trace_provider = register(

project_type=ProjectType.OBSERVE,

project_name="moja_aplikacja_ai"

)

# Instrumentacja OpenAI

OpenAIInstrumentor().instrument(tracer_provider=trace_provider)

# Używaj OpenAI jak zwykle - śledzenie dzieje się automatycznie!

TypeScript

-

Zainstaluj pakiety:

npm install @traceai/openai @traceai/fi-core -

Skonfiguruj instrumentację:

import { register, ProjectType } from "@traceai/fi-core";

import { OpenAIInstrumentation } from "@traceai/openai";

import { registerInstrumentations } from "@opentelemetry/instrumentation";

const tracerProvider = register({

projectName: "moja_aplikacja_ai",

projectType: ProjectType.OBSERVE,

});

registerInstrumentations({

tracerProvider,

instrumentations: [new OpenAIInstrumentation()],

});

Architektura i Przechwytywane Dane

traceAI opiera się na wzorcach instrumentacji OpenTelemetry, co pozwala na pełną kompatybilność z eksporterami OTLP (HTTP/gRPC).

Co dokładnie jest monitorowane? traceAI automatycznie gromadzi dane takie jak: pełna treść promptów i uzupełnień, zużycie tokenów (wejściowe, wyjściowe i całkowite), parametry modelu, nazwy i argumenty wywoływanych narzędzi, a także szczegółowe stosy błędów i opóźnienia na każdym etapie.

Przypadki Użycia (Use Case)

- Debugowanie Agentów AI: Zrozumienie, dlaczego agent podjął konkretną decyzję lub użył danego narzędzia w wieloetapowym procesie.

- Optymalizacja Kosztów: Dokładne śledzenie zużycia tokenów w rozbiciu na poszczególne modele i funkcjonalności.

- Monitorowanie Wydajności: Analiza opóźnień (latency) w wywołaniach LLM i wyszukiwaniach w bazach wektorowych w środowisku produkcyjnym.

- Zgodność i Audyt: Przechowywanie historii promptów i odpowiedzi w celu zapewnienia bezpieczeństwa i jakości generowanych treści.

FAQ - Najczęściej Zadawane Pytania

Czy traceAI wymaga nowego konta u innego dostawcy? Nie. traceAI przesyła dane do narzędzi, których już używasz, takich jak Grafana czy Datadog.

Czy traceAI obsługuje streaming odpowiedzi? Tak, biblioteka śledzi poszczególne fragmenty (chunks) podczas streamingu wraz z ich deltami.

Jakie języki programowania są wspierane? Obecnie traceAI wspiera języki Python, TypeScript, Java oraz C#. Wsparcie dla języka Go znajduje się w planach rozwojowych.

Czy mogę używać własnej konfiguracji OpenTelemetry? Tak, traceAI pozwala na użycie własnych TracerProviderów, procesorów spanów oraz eksporterów.