GLM-5-Turbo

GLM-5-Turbo: Natywny Model OpenClaw od Z.AI do Złożonych Zadań Agentowych

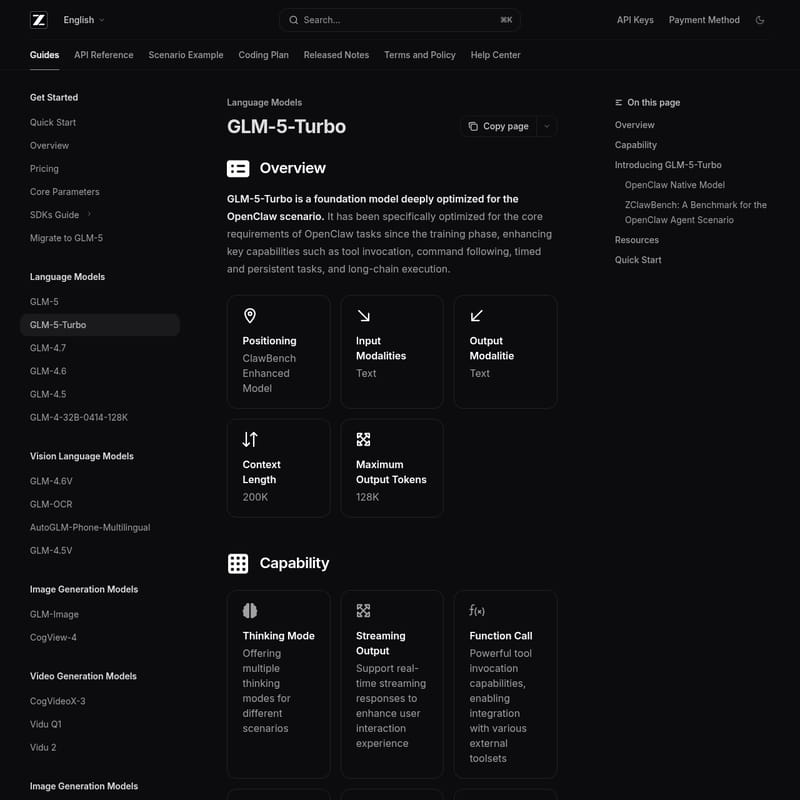

GLM-5-Turbo to zaawansowany model fundamentowy zoptymalizowany pod kątem scenariuszy OpenClaw. Oferuje kontekst 200K, potężne funkcje przywoływania narzędzi, obsługę zadań długofalowych oraz tryb głębokiego myślenia, idealny dla systemów agentowych.

2026-03-18

--K

GLM-5-Turbo Informacje o produkcie

Kompleksowy Przewodnik po GLM-5-Turbo: Potęga Modelu Natywnego OpenClaw

GLM-5-Turbo reprezentuje nową generację modeli językowych zaprojektowanych specjalnie z myślą o ekosystemie agentowym. Jako model fundamentowy głęboko zoptymalizowany pod kątem scenariuszy OpenClaw, GLM-5-Turbo redefiniuje sposób, w jaki sztuczna inteligencja radzi sobie ze złożonymi, wieloetapowymi zadaniami w rzeczywistych środowiskach pracy.

Czym jest GLM-5-Turbo?

GLM-5-Turbo to model językowy (LLM) typu „OpenClaw Native”, co oznacza, że już na etapie trenowania został przystosowany do wymagań nowoczesnych agentów AI. W przeciwieństwie do standardowych modeli, GLM-5-Turbo kładzie nacisk na egzekucję zadań, a nie tylko na samą konwersację. Dzięki długości kontekstu wynoszącej 200K oraz maksymalnej liczbie tokenów wyjściowych na poziomie 128K, model ten jest idealny do przetwarzania obszernych dokumentacji i długich łańcuchów logicznych.

GLM-5-Turbo został zaprojektowany, aby przejść od zwykłego dialogu do realnego wykonawstwa (execution), oferując stabilność i niezawodność w wywoływaniu narzędzi zewnętrznych.

Kluczowe Funkcje GLM-5-Turbo (Features)

Model GLM-5-Turbo wyróżnia się szeregiem zaawansowanych możliwości, które czynią go liderem w testach wydajnościowych ZClawBench:

1. Precyzyjne Wywoływanie Narzędzi (Tool Calling)

GLM-5-Turbo charakteryzuje się wzmocnioną zdolnością do bezbłędnego przywoływania zewnętrznych umiejętności i zestawów narzędzi. Eliminuje to błędy w zadaniach wielokrokowych, zapewniając płynne przejście między planowaniem a działaniem.

2. Zaawansowane Śledzenie Instrukcji (Instruction Following)

Model wykazuje silne zdolności dekompozycji złożonych, wielowarstwowych instrukcji. Potrafi precyzyjnie identyfikować cele, planować kroki i wspierać podział zadań między wieloma agentami.

3. Zadania Harmonogramowane i Trwałe

Optymalizacja pod kątem zadań wyzwalanych czasowo (scheduled triggers) oraz długoterminowych procesów sprawia, że GLM-5-Turbo lepiej rozumie wymiar czasu i utrzymuje ciągłość wykonania nawet w bardzo długich sesjach.

4. Thinking Mode i Structured Output

- Thinking Mode: Oferuje różne tryby myślenia dostosowane do specyfiki problemu.

- Structured Output: Wsparcie dla formatów takich jak JSON ułatwia integrację z systemami zewnętrznymi.

- Context Caching: Inteligentny mechanizm buforowania optymalizuje wydajność w długich konwersacjach.

Scenariusze Użycia (Use Case)

Model GLM-5-Turbo znajduje zastosowanie wszędzie tam, gdzie wymagana jest wysoka precyzja i autonomia agentów:

- Programowanie i Deweloperka: Konfiguracja środowisk, analiza kodu i automatyzacja workflow.

- Analiza Finansowa i Biznesowa: Przetwarzanie dużych zbiorów danych przy użyciu narzędzi zewnętrznych.

- Tworzenie Treści: Generowanie sloganów marketingowych, artykułów i planów komunikacji.

- Zarządzanie Operacyjne: Automatyzacja zadań cyklicznych i monitorowanie procesów w czasie rzeczywistym.

- Badania Naukowe: Wykorzystanie narzędzi do wyszukiwania informacji i syntezy wiedzy z wielu źródeł.

Jak korzystać z GLM-5-Turbo (How to Use)

Integracja z modelem jest prosta i odbywa się za pośrednictwem API Z.AI. Poniżej znajduje się przykład podstawowego wywołania przy użyciu narzędzia cURL:

Podstawowe wywołanie API

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer TWOJ_KLUCZ_API" \

-d '{

"model": "glm-5-turbo",

"messages": [

{

"role": "user",

"content": "Jako ekspert marketingu, stwórz atrakcyjny slogan dla platformy Z.AI."

}

],

"thinking": {

"type": "enabled"

},

"max_tokens": 4096,

"temperature": 1.0

}'

Wywołanie Strumieniowe (Streaming)

Możesz również korzystać z odpowiedzi w czasie rzeczywistym, ustawiając parametr "stream": true. Pozwala to na szybszą interakcję z użytkownikiem końcowym.

FAQ - Najczęściej Zadawane Pytania

Czym różni się GLM-5-Turbo od standardowego modelu GLM-5? GLM-5-Turbo dostarcza znaczących ulepszeń w scenariuszach OpenClaw, przewyższając model bazowy w kategoriach takich jak precyzja wywoływania narzędzi, stabilność długich łańcuchów logicznych oraz wydajność w teście ZClawBench.

Jaka jest maksymalna długość kontekstu w GLM-5-Turbo? Model obsługuje kontekst o długości do 200 000 tokenów (200K), co pozwala na pracę z bardzo obszernymi danymi wejściowymi.

Czy model obsługuje format JSON? Tak, GLM-5-Turbo wspiera ustrukturyzowane wyjście (Structured Output), co jest kluczowe dla integracji z systemami informatycznymi.

Co to jest ZClawBench? To dedykowany benchmark typu end-to-end, stworzony przez Z.AI do oceny wydajności agentów w ekosystemie OpenClaw, obejmujący zadania od analizy danych po tworzenie treści.

Czy GLM-5-Turbo obsługuje multimodalność? Model ten akceptuje tekst jako dane wejściowe i generuje tekst jako dane wyjściowe.