Edgee Codex Compressor

Edgee – Innowacyjna warstwa kompresji dla Codex optymalizująca koszty i wydajność tokenów

Edgee to zaawansowana bramka kompresji danych, która rewolucjonizuje pracę z modelami AI, takimi jak Codex. Dzięki unikalnej technologii usuwania redundancji w kontekście, Edgee pozwala zredukować zużycie świeżych tokenów wejściowych o niemal 50% oraz obniżyć koszty sesji o ponad 35%. Rozwiązanie to zwiększa efektywność pamięci podręcznej (cache) i eliminuje problem przeładowanego kontekstu w zadaniach programistycznych. Edgee jest idealnym narzędziem dla zespołów inżynierskich korzystających z agentów AI, oferując oszczędność zasobów przy zachowaniu pełnej jakości generowanych odpowiedzi. To wydajność mierzona realną oszczędnością czasu i budżetu.

2026-04-14

--K

Edgee Codex Compressor Informacje o produkcie

Edgee: Rewolucja w optymalizacji Codex – Przestań płacić za ponowne odczytywanie kontekstu

Codex to potężne narzędzie, jednak jego wydajność drastycznie spada, gdy zaczyna operować na zbyt dużym kontekście. To właśnie w tym miejscu pojawiają się niepotrzebne koszty: więcej tokenów wejściowych, większe wydatki i narastające tarcia w procesie tworzenia kodu. Rozwiązaniem tego problemu jest Edgee, innowacyjna warstwa kompresji, która redefiniuje sposób, w jaki Codex przetwarza informacje.

Czym jest Edgee?

Edgee to zaawansowana bramka (gateway) kompresji, zaprojektowana w celu optymalizacji interakcji z modelami językowymi, takimi jak gpt-5.4 (Codex). Działa jako inteligentny filtr umieszczony przed modelem, który analizuje i kompresuje kontekst repozytorium oraz historii rozmowy, zanim trafią one do API.

Wykorzystując Edgee, programiści mogą korzystać z tego samego modelu i tych samych przepływów pracy, ale przy znacznie niższym obciążeniu infrastruktury. Głównym celem Edgee nie jest skracanie wypowiedzi modelu, lecz eliminacja nadmiarowości, co pozwala na płynniejszą i tańszą pracę z agentami AI.

Kluczowe cechy Edgee

Zastosowanie Edgee w codziennej pracy z modelem Codex niesie ze sobą szereg korzyści technicznych i ekonomicznych:

- Inteligentna kompresja kontekstu: Edgee usuwa powtarzające się fragmenty danych, sprawiając, że sesje są lżejsze.

- Redukcja tokenów wejściowych: Drastyczne zmniejszenie liczby świeżych tokenów (input tokens) przesyłanych do modelu.

- Zwiększona wydajność cache: Wyższy wskaźnik trafień w pamięci podręcznej (cache hit rate) dzięki lepszemu zarządzaniu strukturą danych.

- Pełna jakość odpowiedzi: Kompresja nie wpływa negatywnie na jakość generowanego kodu – model nadal produkuje kompletne i poprawne odpowiedzi.

- Oszczędność budżetu: Bezpośrednia redukcja kosztów operacyjnych związanych z korzystaniem z API Codex.

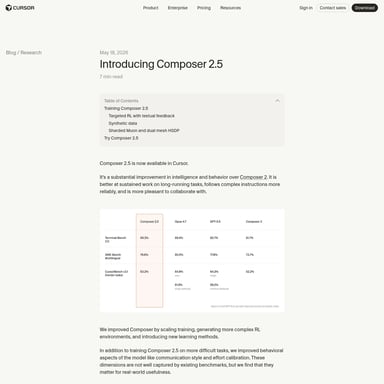

Wyniki benchmarku: Codex vs Codex + Edgee

Przeprowadziliśmy kontrolowany test przy użyciu open-source'owego narzędzia compression-lab. Porównaliśmy dwie sesje na tym samym kodzie źródłowym i modelu gpt-5.4. Wyniki pokazują, jak potężnym narzędziem jest Edgee:

| Metryka | Sam Codex | Codex + Edgee | Poprawa | | :--- | :--- | :--- | :--- | | Tokeny wejściowe | 1 136 974 | 573 881 | −49.5% | | Tokeny w cache | 3 622 656 | 3 358 848 | −7.28% | | Całkowity koszt | $4.0024 | $2.5784 | −35.6% | | Cache hit rate | 76.1% | 85.4% | +9.3 pkt |

"Edgee nie próbuje sprawić, by Codex był 'krótszy'. Sprawia, że Codex przenosi mniej redundantnego kontekstu do każdego zapytania."

Przypadki użycia (Use Case)

1. Agentowe sesje kodowania

W długich sesjach, gdzie agent AI musi wielokrotnie analizować całe repozytorium, Edgee zapobiega puchnięciu kontekstu. Pozwala to na dłuższą pracę bez konieczności resetowania sesji z powodu limitów tokenów.

2. Skalowanie w zespołach inżynierskich

Przy 1000 sesjach oszczędność rzędu $1.42 na sesję przekłada się na ponad $1400 czystego zysku. Dla dużych firm technologicznych Edgee staje się kluczowym elementem strategii optymalizacji kosztów AI.

3. Zarządzanie złożonymi repozytoriami

Dzięki Edgee, praca z dużymi bazami kodu staje się bardziej płynna. Model otrzymuje tylko niezbędne, unikalne informacje, co przekłada się na lepszą wydajność na jednostkę wydatków.

Dlaczego Edgee wygrywa?

Kluczem do sukcesu Edgee jest oszczędność, a nie tylko niska cena. Zmniejszenie liczby świeżych tokenów wejściowych o prawie połowę oznacza, że model musi przetworzyć znacznie mniej powtarzających się informacji. Wyższy współczynnik trafień w cache (85.4%) potwierdza, że ekonomia pracy z AI staje się znacznie korzystniejsza, gdy wyeliminujemy redundancję.

FAQ

Czy Edgee pogarsza jakość odpowiedzi Codex? Nie. W testach sesja z Edgee wygenerowała nawet nieco więcej tokenów wyjściowych niż sesja bazowa. Oznacza to, że model nie jest ograniczany w swojej kreatywności ani precyzji, a jedynie otrzymuje lepiej zorganizowane dane wejściowe.

O ile Edgee może obniżyć koszty API? W naszych benchmarkach uzyskaliśmy obniżkę kosztów o 35.6% na pojedynczej sesji. Rzeczywiste oszczędności zależą od specyfiki repozytorium i długości rozmowy.

Czy Edgee wpływa na opóźnienia (latency)? Benchmark koncentrował się na wydajności obciążenia i zużyciu tokenów, a nie na czasie reakcji. Jednak mniejszy ładunek danych wejściowych to zazwyczaj bardziej efektywne przetwarzanie po stronie modelu.

Jak zacząć korzystać z Edgee? Możesz zacząć optymalizować swoje przepływy pracy AI, odwiedzając Edgee Console i integrując swoją infrastrukturę z naszą bramką kompresji.