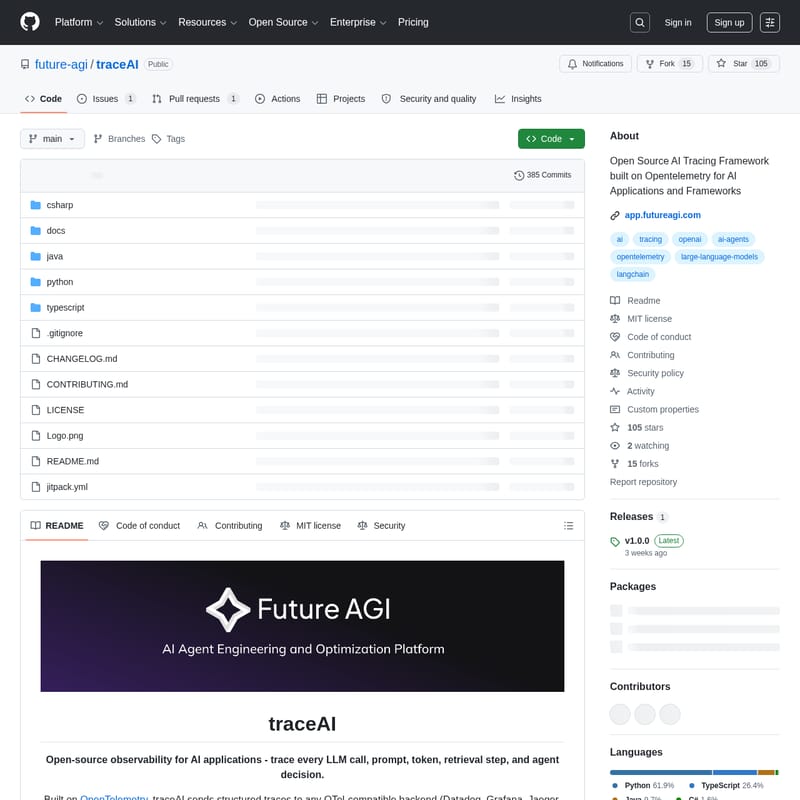

traceAI

traceAI: AI 애플리케이션을 위한 오픈 소스 OpenTelemetry 기반 관측성 프레임워크

traceAI는 AI 애플리케이션의 모든 LLM 호출, 프롬프트, 토큰, 검색 단계 및 에이전트 결정을 추적하는 오픈 소스 라이브러리입니다. OpenTelemetry를 기반으로 구축되어 기존의 Datadog, Grafana, Jaeger 등 OTel 호환 백엔드와 완벽하게 통합되며, Python, TypeScript, Java, C# 등 다양한 언어와 50개 이상의 AI 프레임워크를 지원합니다.

2026-04-03

534773.1K

traceAI 제품정보

traceAI: AI 애플리케이션을 위한 오픈 소스 관측성 라이브러리

AI 기술이 발전함에 따라 대규모 언어 모델(LLM)과 에이전트의 내부 동작을 가시화하는 것이 매우 중요해졌습니다. traceAI는 AI 애플리케이션의 모든 LLM 호출, 프롬프트, 토큰 사용량, 검색 단계 및 에이전트의 결정을 추적할 수 있는 강력한 오픈 소스 라이브러리입니다.

What's traceAI?

traceAI는 AI 애플리케이션에 대한 완벽한 가시성을 제공하기 위해 설계된 오픈 소스 관측성(Observability) 프레임워크입니다. 이 도구는 업계 표준인 **OpenTelemetry(OTel)**를 기반으로 구축되었으므로, 별도의 새로운 벤더나 대시보드를 도입할 필요 없이 기존에 사용하던 Datadog, Grafana, Jaeger, Future AGI 등 모든 OTel 호환 백엔드에 구조화된 트레이스 데이터를 전송할 수 있습니다.

traceAI를 사용하면 프롬프트가 어떻게 구성되는지, 토큰이 얼마나 소비되는지, 그리고 복잡한 에이전트가 어떤 단계를 거쳐 의사결정을 내리는지 실시간으로 파악할 수 있습니다.

주요 기능 (Features)

traceAI는 생산성을 높이고 AI 워크플로우를 최적화하기 위한 다양한 기능을 제공합니다.

- 표준화된 트레이싱: AI 워크플로우를 일관된 OpenTelemetry 스팬(Span) 및 속성으로 매핑합니다.

- 제로 설정(Zero-Config): 최소한의 코드 변경만으로 즉시 적용 가능한 드롭인(Drop-in) 계측을 지원합니다.

- 멀티 프레임워크 지원: Python, TypeScript, Java, C# 등 4개 언어와 50개 이상의 AI 프레임워크와 통합됩니다.

- 벤더 중립성: 특정 플랫폼에 종속되지 않으며 모든 OTel 호환 백엔드에서 작동합니다.

- 풍부한 컨텍스트 캡처: 프롬프트, 완료 결과, 토큰 수, 모델 파라미터(temperature, top_p 등), 도구 호출 등을 상세히 기록합니다.

- 프로덕션 준비 완료: 비동기 지원, 스트리밍 처리, 오류 처리 및 성능 최적화가 되어 있어 실제 서비스 환경에 적합합니다.

사용 사례 (Use Case)

traceAI는 다음과 같은 상황에서 매우 유용합니다.

- LLM 성능 최적화: 어떤 프롬프트가 가장 효율적인지, 혹은 어떤 모델 파라미터가 최적의 결과를 내는지 분석할 때.

- 디버깅 및 문제 해결: 복잡한 에이전트 워크플로우에서 결정을 내리는 단계 중 어디에서 오류가 발생하는지 추적할 때.

- 비용 관리: 각 요청당 소비되는 입력 및 출력 토큰 수를 모니터링하여 운영 비용을 예측하고 최적화할 때.

- 기존 인프라 통합: 이미 구축된 Grafana나 Datadog 시스템에 AI 트레이싱 데이터를 통합하여 단일 관제 지점을 유지하고 싶을 때.

시작하기 (How to Use)

traceAI는 각 언어별로 간편한 설치와 계측 방법을 제공합니다.

Python에서 사용하기

-

설치

pip install traceai-openai -

코드 적용

import os from fi_instrumentation import register from traceai_openai import OpenAIInstrumentor import openai # 트레이서 등록 trace_provider = register(project_name="my_ai_app") # OpenAI 계측 OpenAIInstrumentor().instrument(tracer_provider=trace_provider) # 평소처럼 OpenAI 사용 - 자동으로 추적됩니다!

TypeScript에서 사용하기

-

설치

npm install @traceai/openai @traceai/fi-core -

코드 적용

import { register } from "@traceai/fi-core"; import { OpenAIInstrumentation } from "@traceai/openai"; import { registerInstrumentations } from "@opentelemetry/instrumentation"; const tracerProvider = register({ projectName: "my_ai_app" }); registerInstrumentations({ tracerProvider, instrumentations: [new OpenAIInstrumentation()], });

지원되는 프레임워크 및 호환성

traceAI는 광범위한 생태계를 지원합니다.

- LLM 공급자: OpenAI, Anthropic, Google Vertex AI, AWS Bedrock, Mistral AI, Ollama, DeepSeek 등.

- 에이전트 프레임워크: LangChain, LlamaIndex, CrewAI, AutoGen, Spring AI(Java) 등.

- 벡터 데이터베이스: Pinecone, ChromaDB, Qdrant, Milvus, Weaviate, MongoDB Atlas 등.

자주 묻는 질문 (FAQ)

Q: traceAI를 사용하려면 새로운 대시보드가 필요한가요? A: 아니요. traceAI는 OpenTelemetry 표준을 따르므로 기존에 사용하던 Datadog, Grafana, Jaeger 등의 도구를 그대로 사용할 수 있습니다.

Q: 어떤 데이터가 캡처되나요? A: 프롬프트와 완료 내용, 토큰 사용량(입력/출력/합계), 모델 파라미터, 도구 및 함수 호출 결과, 에러 스택 트레이스 및 지연 시간(Latency) 등이 캡처됩니다.

Q: 스트리밍 응답도 지원하나요? A: 네, traceAI는 개별 청크와 델타 트래킹을 포함한 스트리밍 데이터를 지원합니다.

Q: 유료 서비스인가요? A: traceAI는 MIT 라이선스 기반의 오픈 소스 프로젝트로, 누구나 자유롭게 사용하고 기여할 수 있습니다.