GLM-5-Turbo

Z.AI GLM-5-Turbo: OpenClaw 시나리오에 최적화된 차세대 AI 파운데이션 모델

GLM-5-Turbo는 OpenClaw 에이전트 환경을 위해 설계된 혁신적인 AI 모델입니다. 200K의 방대한 컨텍스트 길이와 128K의 출력 토큰을 지원하며, 도구 호출, 복잡한 명령어 이행, 장기 체인 실행 능력이 대폭 강화되었습니다. ZClawBench 벤치마크를 통해 검증된 성능으로 데이터 분석, 소프트웨어 개발, 콘텐츠 생성 등 다양한 비즈니스 워크플로우를 자동화합니다.

2026-03-18

--K

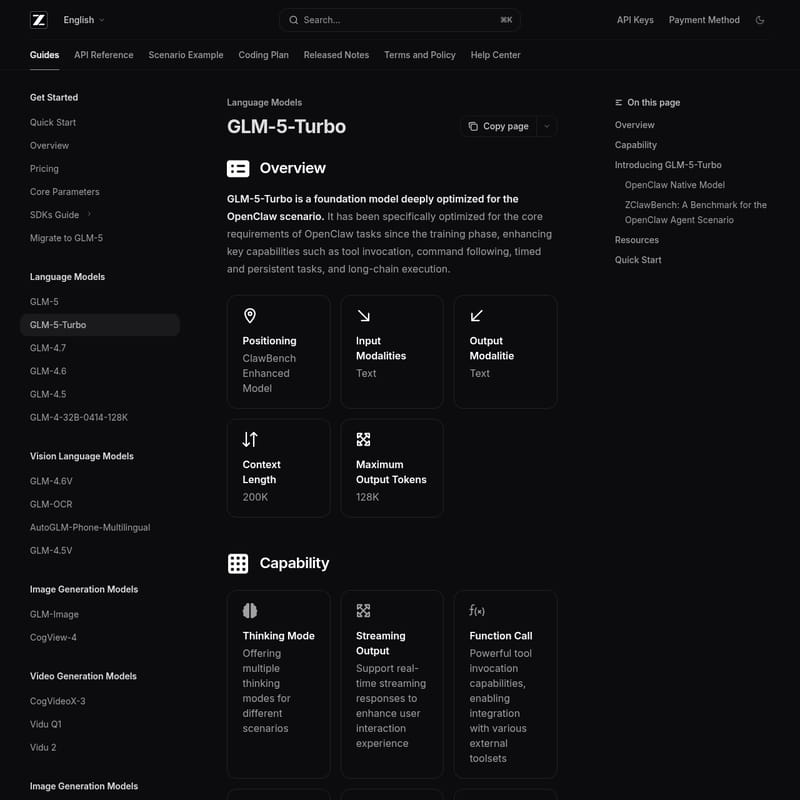

GLM-5-Turbo 제품정보

Z.AI GLM-5-Turbo: OpenClaw 에이전트 시나리오를 위한 최적의 파운데이션 모델

AI 기술의 진화에 따라 단순한 대화를 넘어 실제적인 업무를 수행하는 에이전트 모델의 중요성이 커지고 있습니다. GLM-5-Turbo는 이러한 흐름에 발맞춰 OpenClaw 시나리오에 깊이 있게 최적화된 최첨단 파운데이션 모델입니다. 훈련 단계부터 OpenClaw 태스크의 핵심 요구 사항을 반영하여 설계된 GLM-5-Turbo는 도구 호출, 복잡한 명령어 실행, 시간 기반 작업 및 장기 체인 실행 분야에서 탁월한 성능을 발휘합니다.

What's GLM-5-Turbo

GLM-5-Turbo는 Z.AI 개발자 생태계의 핵심 모델로, 특히 OpenClaw 네이티브 모델로서의 정체성을 가집니다. 이 모델은 텍스트 입력과 출력을 모두 지원하며, 대규모 데이터를 처리할 수 있는 200K 컨텍스트 길이와 최대 128K 출력 토큰을 제공합니다.

단순한 언어 처리를 넘어 실제 에이전트 워크플로우 내에서 발생하는 복잡하고 동적인 작업을 수행하기 위해 시스템적으로 구축되었습니다. GLM-5-Turbo는 개발자뿐만 아니라 생산성 사용자, 금융 전문가, 운영 엔지니어, 콘텐츠 크리에이터 등 다양한 분야의 전문가들이 안정적으로 사용할 수 있는 고성능 AI 솔루션입니다.

Features

GLM-5-Turbo는 강력한 에이전트 기능을 지원하기 위해 다음과 같은 핵심 특징을 갖추고 있습니다.

- 강력한 사고 모드 (Thinking Mode): 다양한 시나리오에 맞춰 다각적인 사고 방식을 제공하여 문제 해결 능력을 극대화합니다.

- 실시간 스트리밍 출력 (Streaming Output): 실시간 응답을 지원하여 사용자 인터랙션 경험을 개선하고 대기 시간을 줄입니다.

- 정밀한 함수 호출 (Function Calling): 외부 툴셋과의 통합이 용이하며, 오류 없는 도구 호출 기능을 통해 대화에서 실행으로의 전환을 완벽하게 지원합니다.

- 지능형 컨텍스트 캐싱 (Context Caching): 긴 대화 환경에서 성능을 최적화하고 효율성을 높이는 캐싱 메커니즘을 제공합니다.

- 구조화된 출력 (Structured Output): JSON 등 구조화된 데이터 형식을 지원하여 기존 시스템과의 통합이 매우 간편합니다.

- MCP 통합: 외부 MCP 도구 및 데이터 소스를 유연하게 연결하여 사용 사례를 무한히 확장할 수 있습니다.

Introducing GLM-5-Turbo: OpenClaw 네이티브 혁신

1. OpenClaw 네이티브 모델의 강점

GLM-5-Turbo는 훈련 데이터 구성부터 최적화 목표 설계까지 실제 에이전트 워크플로우를 기반으로 구축되었습니다.

- 도구 호출(Tool Calling): 정확한 호출을 보장하고 실패율을 낮추어 멀티스텝 작업의 안정성을 확보했습니다.

- 지시 이행(Instruction Following): 다층적이고 긴 명령어를 정확히 분해하고 계획하여 에이전트 간의 협업을 지원합니다.

- 예약 및 지속 작업: 시간 차원의 이해도가 높아 예약된 트리거 작업이나 중단 없는 장기 작업을 안정적으로 수행합니다.

- 고처리량 롱 체인(High-Throughput Long Chains): 데이터 처리량이 많은 논리 체인에서도 빠른 속도와 안정적인 응답을 유지합니다.

2. ZClawBench: 성능의 검증

에이전트 성능을 객관적으로 평가하기 위해 도입된 ZClawBench 결과에 따르면, GLM-5-Turbo는 기존 GLM-5 및 타사 선도 모델들을 상회하는 성능을 보여주었습니다. 특히 환경 설정, 소프트웨어 개발, 데이터 분석 등 실무 위주의 태스크에서 강력한 경쟁력을 증명했습니다.

Use Case

GLM-5-Turbo는 다음과 같은 실제 비즈니스 및 개발 시나리오에서 활용될 수 있습니다.

- 소프트웨어 개발 및 환경 설정: 복잡한 코딩 계획 수립 및 자동화된 개발 환경 구축.

- 데이터 분석 및 정보 검색: 대량의 데이터를 구조화하여 분석하고 유의미한 통찰력을 도출.

- 콘텐츠 생성 및 마케팅: 창의적인 슬로건 생성부터 장문의 리포트 작성까지 지원.

- 운영 자동화: 예약된 시간에 특정 태스크를 실행하거나 지속적인 모니터링 수행.

How to Use

GLM-5-Turbo는 API를 통해 손쉽게 연동할 수 있습니다. 아래는 기본적인 cURL 호출 예시입니다.

Basic Call (cURL)

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer your-api-key" \

-d '{

"model": "glm-5-turbo",

"messages": [

{

"role": "user",

"content": "마케팅 전문가로서 우리 제품을 위한 매력적인 슬로건을 만들어줘."

},

{

"role": "assistant",

"content": "네, 매력적인 슬로건 작성을 위해 제품에 대해 더 자세히 알려주세요."

},

{

"role": "user",

"content": "Z.AI Open Platform"

}

],

"thinking": {

"type": "enabled"

},

"max_tokens": 4096,

"temperature": 1.0

}'

Streaming Call

실시간 응답이 필요한 경우 "stream": true 옵션을 추가하여 스트리밍 방식으로 데이터를 수신할 수 있습니다.

FAQ

Q: GLM-5-Turbo가 지원하는 최대 컨텍스트 길이는 얼마인가요?

A: GLM-5-Turbo는 최대 200K의 컨텍스트 길이를 지원하며, 출력 토큰은 최대 128K까지 가능합니다.

Q: OpenClaw 환경이 아닌 곳에서도 사용할 수 있나요?

A: 네, GLM-5-Turbo는 OpenClaw 시나리오에 최적화되어 있지만, 일반적인 텍스트 생성, 함수 호출, 데이터 분석 등 다양한 범용 AI 작업에도 매우 뛰어난 성능을 발휘합니다.

Q: 어떤 SDK를 지원하나요?

A: 공식 Python SDK와 Java SDK를 지원하며, OpenAI Python SDK와도 호환되어 기존 코드를 쉽게 마이그레이션할 수 있습니다.

Q: ZClawBench 벤치마크 데이터는 어디서 확인할 수 있나요?

A: ZClawBench의 데이터셋과 평가 궤적은 공개되어 있으며, 커뮤니티를 통해 누구나 검증하고 개선에 참여할 수 있습니다.