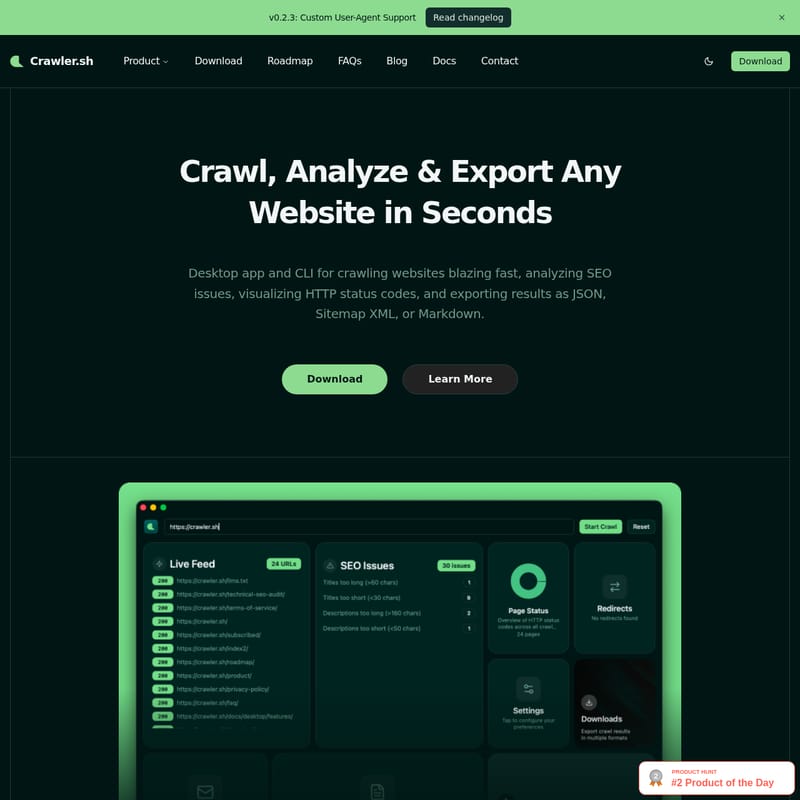

Crawler.sh

Crawler.sh - 초고속 웹 크롤링, SEO 분석 및 데이터 추출을 위한 데스크톱 및 CLI 솔루션

Crawler.sh는 웹사이트를 단 몇 초 만에 크롤링하고, 16가지 항목의 SEO 이슈를 분석하며, 데이터를 JSON, Markdown, Sitemap XML 등 다양한 형식으로 내보낼 수 있는 강력한 도구입니다. CLI와 데스크톱 앱을 모두 지원하며, 콘텐츠 추출 및 사이트 모니터링에 최적화되어 있습니다.

2026-03-04

--K

Crawler.sh 제품정보

Crawler.sh: 웹사이트 크롤링, SEO 분석 및 데이터 추출의 혁신적 솔루션

Crawler.sh는 모든 웹사이트를 단 몇 초 만에 크롤링하고 분석하여 데이터를 내보낼 수 있도록 설계된 강력한 데스크톱 앱 및 CLI(명령줄 인터페이스) 도구입니다. v0.2.3 업데이트를 통해 Custom User-Agent Support 기능이 추가되어 더욱 정교한 크롤링 환경을 제공합니다. 로컬 기반의 빠른 속도와 프라이버시 보호를 최우선으로 하는 Crawler.sh는 마케터, 개발자, 그리고 SEO 전문가를 위한 필수 도구입니다.

What's Crawler.sh

Crawler.sh는 단순한 크롤러를 넘어선 종합 웹 데이터 관리 솔루션입니다. 동일 도메인 내의 모든 페이지를 눈깜짝할 사이에 훑어내며, 수천 개의 페이지도 처리할 수 있는 높은 성능을 자랑합니다. 사용자는 Crawler.sh를 통해 웹사이트의 구조를 시각화하고, HTTP 상태 코드를 분석하며, 정밀한 SEO 감사를 수행할 수 있습니다.

이 도구는 크게 두 가지 방식으로 제공됩니다:

- CLI Tool: 터미널에서

crawl,info,export,seo등의 서브커맨드를 통해 파이프라인 작업을 수행하는 숙련된 사용자를 위한 도구. - Desktop Pro: 8개의 인터랙티브 카드가 포함된 시각적 대시보드와 실시간 크롤링 피드를 제공하는 직관적인 데스크톱 애플리케이션.

Features

1. 초고속 사이트 크롤링 (Site Crawling)

Crawler.sh는 동일 도메인 내에서 전체 사이트를 수초 내에 크롤링합니다. 사용자는 다음과 같은 상세 설정을 조절할 수 있습니다:

- 동시성 설정 (Configurable Concurrency): 작업 속도 조절.

- 깊이 제한 (Depth Limits): 크롤링할 페이지의 깊이 지정.

- 정중한 지연 시간 (Polite Delay): 서버 부하를 방지하기 위한 요청 간 간격 설정.

2. 정밀한 콘텐츠 추출 (Content Extraction)

모든 페이지에서 주요 본문 내용을 자동으로 추출하여 깨끗한 Markdown 형식으로 변환합니다. 여기에는 단어 수(Word count), 작성자 바이라인(Author byline), 요약문(Excerpt) 정보가 포함되어 데이터 자산화에 용이합니다.

3. 16가지 자동 SEO 분석 (SEO Analysis)

Crawler.sh는 매 페이지마다 16가지 카테고리의 자동 체크를 수행합니다. 발견된 이슈는 팀 공유를 위해 CSV나 TXT 형식으로 즉시 내보낼 수 있습니다.

- 누락된 타이틀 및 중복 메타 설명 감지

- Noindex 지시어 및 얇은 콘텐츠(Thin content) 확인

- 너무 긴 URL 분석 등

4. 다양한 출력 형식 지원 (Multiple Output Formats)

크롤링 중에는 NDJSON 형식으로 결과를 실시간 스트리밍하며, 완료 후에는 다음과 같은 형식으로 내보낼 수 있습니다:

- JSON Array: 데이터 연동용.

- Sitemap XML: W3C 표준 준수 사이트맵.

- Markdown: 콘텐츠 아카이빙용.

- CSV/TXT: SEO 리포트용.

Use Case

Crawler.sh는 다양한 업무 환경에서 워크플로우를 최적화합니다.

- SEO 감사 (SEO Auditing): 검색 엔진 순위에 영향을 미치기 전에 기술적인 SEO 문제를 사전에 발견하고 수정합니다.

- 콘텐츠 아카이빙 (Content Archiving): 웹사이트 마이그레이션이나 백업을 위해 기존 콘텐츠를 Markdown 형태로 깔끔하게 추출합니다.

- 사이트맵 생성 (Sitemap Generation): 라이브 크롤링 데이터를 기반으로 정확한 Sitemap XML을 생성하여 유지보수 효율을 높입니다.

- 사이트 모니터링 (Site Monitoring): 정기적인 크롤링을 통해 깨진 링크(Broken links)나 상태 코드 변화를 실시간으로 감지합니다.

How to Use

Crawler.sh는 설치 후 매우 간단한 명령어로 작업을 시작할 수 있습니다.

기본 크롤링 실행

터미널에서 다음 명령어를 입력하면 기본 설정(100페이지, 깊이 10)으로 크롤링이 시작됩니다:

crawler crawl https://example.com

이 작업의 결과물은 example-com.crawl 파일(NDJSON 형식)로 저장됩니다.

워크플로우 단계

- Basic Crawl: 기본 설정으로 신속한 데이터 수집.

- Deep Crawl: 사이트 전체 구조 파악을 위한 심층 크롤링.

- Inspect Results: 실시간 피드와 배지를 통한 상태 확인.

- SEO Report: 자동 분석 결과 확인 및 개선안 도출.

- Export Formats: 필요한 형식으로 데이터 내보내기.

- Full Pipeline: 전체 자동화 파이프라인 구축.

FAQ

Q1: Crawler.sh의 CLI와 데스크톱 앱의 차이점은 무엇인가요?

A: 하나의 구독권으로 두 가지를 모두 사용할 수 있습니다. CLI는 명령줄 기반의 자동화와 파이프라인 구축에 적합하며, 데스크톱 앱은 시각적인 대시보드와 대화형 카드를 통해 실시간으로 상태를 확인하고자 하는 사용자에게 적합합니다.

Q2: SEO 분석 기능은 어떤 항목들을 체크하나요?

A: 타이틀 누락, 중복 메타 설명, noindex 태그, 부족한 콘텐츠량, 너무 긴 URL 등 총 16가지 카테고리를 자동으로 검사하여 리포트를 제공합니다.

Q3: 데이터는 어디에 저장되나요?

A: Crawler.sh는 로컬 기반 도구입니다. 모든 데이터 처리는 사용자의 기기에서 이루어지며, 프라이버시 친화적인 환경을 제공합니다.

Q4: 구독 가격은 어떻게 되나요?

A: 연간 $99의 비용으로 CLI 툴과 Desktop Pro 앱을 모두 이용할 수 있습니다. 여기에는 모든 업데이트와 모든 출력 형식 지원이 포함됩니다.

Crawler.sh와 함께라면 수천 페이지의 웹사이트 분석도 더 이상 어렵지 않습니다. 지금 바로 다운로드하여 웹사이트의 잠재력을 극대화하세요.