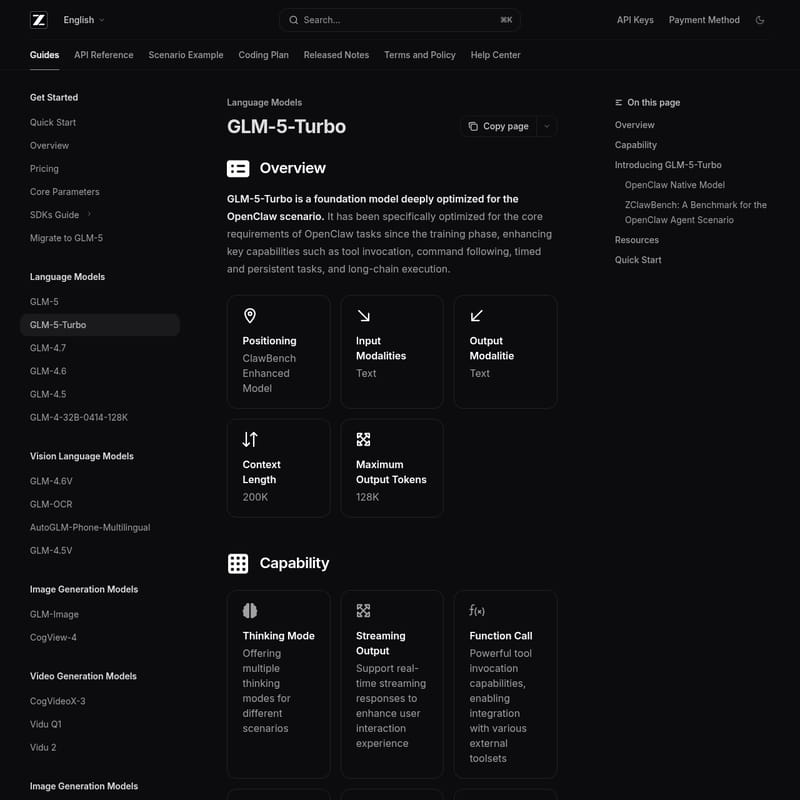

GLM-5-Turbo

GLM-5-Turbo:OpenClawシナリオに最適化された次世代基盤モデル

GLM-5-Turboは、OpenClawシナリオのために深く最適化されたZ.AIの最新基盤モデルです。200Kのコンテキスト長と128Kの最大出力トークンを備え、複雑なツール呼び出し、指示追従、長期タスクの実行において卓越した性能を発揮します。ZClawBenchでの評価により、従来のGLM-5を凌駕する実力が証明されており、エージェント型ワークフローやビジネス自動化に最適なモデルです。

2026-03-18

--K

GLM-5-Turbo 製品情報

GLM-5-Turbo:OpenClawシナリオ向けに最適化された次世代基盤モデル

GLM-5-Turboは、Z.AIが提供する最新の基盤モデルであり、特にOpenClawシナリオにおいて最高峰のパフォーマンスを発揮するように設計されています。トレーニング段階からOpenClawタスクの核心的な要件を反映させることで、ツール呼び出し、指示追従、計画的なタスク実行、および長鎖実行能力を劇的に向上させています。

GLM-5-Turboとは(What's GLM-5-Turbo)

GLM-5-Turboは、OpenClawネイティブモデルとして位置づけられたAIモデルです。テキスト入力およびテキスト出力に対応しており、200Kのコンテキスト長と128Kの最大出力トークンをサポートしています。このモデルは、対話から実行へとシフトする現代のAIエージェントのニーズに応え、複雑で動的なタスクを完遂するために開発されました。

GLM-5-Turboは、実世界のエージェントワークフローに基づいた多様なOpenClawタスクシナリオを系統的に学習しており、単なる対話エンジンを超えた「実行能力」を備えています。

GLM-5-Turboの主な特徴(Features)

1. OpenClawネイティブの最適化

GLM-5-Turboは、OpenClawエコシステムにおけるエージェントタスクを想定し、以下の4つのコア能力が強化されています。

- 精緻なツール呼び出し(Tool Calling): 外部ツールやスキルの呼び出し精度を高め、マルチステップのタスクにおける安定性と信頼性を確保しました。

- 高度な指示追従(Instruction Following): 複雑で多層的な指示を理解・分解する能力が向上。目標を正確に特定し、複数のエージェント間でのタスク分担もサポートします。

- スケジュールおよび持続的タスク: 時間的な要件を深く理解し、長時間の実行が必要なタスクでも中断することなく継続可能です。

- 高スループットな長鎖実行: 大規模なデータ処理や長い論理チェーンを伴うタスク(Lobsterタスク等)において、高速かつ安定したレスポンスを提供します。

2. 多彩な機能セット

- 思考モード(Thinking Mode): さまざまなシナリオに合わせて、複数の思考モードを選択可能です。

- ストリーミング出力: リアルタイムでレスポンスを生成し、ユーザー体験を向上させます。

- コンテキスト・キャッシング: 長い会話におけるパフォーマンスを最適化するためのインテリジェントなキャッシュ機構を搭載しています。

- 構造化出力(Structured Output): JSON形式などの構造化データ出力をサポートし、システム統合を容易にします。

- MCP対応: 外部のMCPツールやデータソースを柔軟に統合し、ユースケースを拡張できます。

3. ZClawBenchによる実証済みの性能

Z.AIは、エージェントタスクの評価基準としてZClawBenchを導入しました。このベンチマークにおいて、GLM-5-Turboは従来のGLM-5を大幅に上回るスコアを記録し、主要なタスクカテゴリで業界をリードする性能を示しています。

使用例(Use Case)

GLM-5-Turboは、以下のような幅広い専門分野や業務シナリオで活用されています。

- ソフトウェア開発: 環境構築からコード生成、デバッグまでの一連のワークフローの自動化。

- データ分析と調査: 大規模な情報検索、データの抽出、および詳細なレポート作成。

- 業務自動化: 金融専門家や運用エンジニアによる、スケジュール設定された定型業務の実行。

- コンテンツ制作: マーケティング担当者やクリエイターによる、一貫性のある長文コンテンツや戦略の立案。

- マルチエージェント連携: 複雑な指示を分解し、複数のスキル(Skill)を組み合わせて解決する高度なエージェント運用。

使いかた(How to Use)

GLM-5-Turboは、cURLや公式SDKを通じて簡単に統合できます。以下は、cURLを使用した基本的な呼び出し例です。

基本的な呼び出し(Basic Call)

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer your-api-key" \

-d '{

"model": "glm-5-turbo",

"messages": [

{

"role": "user",

"content": "マーケティングエキスパートとして、私の製品の魅力的なスローガンを作成してください。"

},

{

"role": "assistant",

"content": "承知いたしました。スローガンを作成するために、製品の詳細を教えていただけますか?"

},

{

"role": "user",

"content": "Z.AI Open Platform"

}

],

"thinking": {

"type": "enabled"

},

"max_tokens": 4096,

"temperature": 1.0

}'

また、"stream": true をパラメータに加えることで、ストリーミング呼び出しも利用可能です。

よくある質問(FAQ)

Q: GLM-5-TurboとGLM-5の主な違いは何ですか? A: GLM-5-Turboは、特にOpenClawシナリオに特化してトレーニングされており、ツール呼び出しの安定性、指示の分解能力、そして長時間のタスク実行においてGLM-5よりも優れたパフォーマンスを発揮します。

Q: コンテキスト長はどのくらいですか? A: GLM-5-Turboは、最大200Kトークンのコンテキスト長をサポートしており、大規模なドキュメントや長い対話履歴の処理に適しています。

Q: どのような出力形式をサポートしていますか? A: 通常のテキスト回答に加え、システム統合に便利なJSONなどの構造化出力や、リアルタイムなユーザー体験を提供するストリーミング出力に対応しています。

Q: 外部ツールとの連携は可能ですか? A: はい、強力なFunction Calling機能とMCP(Model Context Protocol)対応により、外部のツールセットやデータソースと柔軟に連携できます。