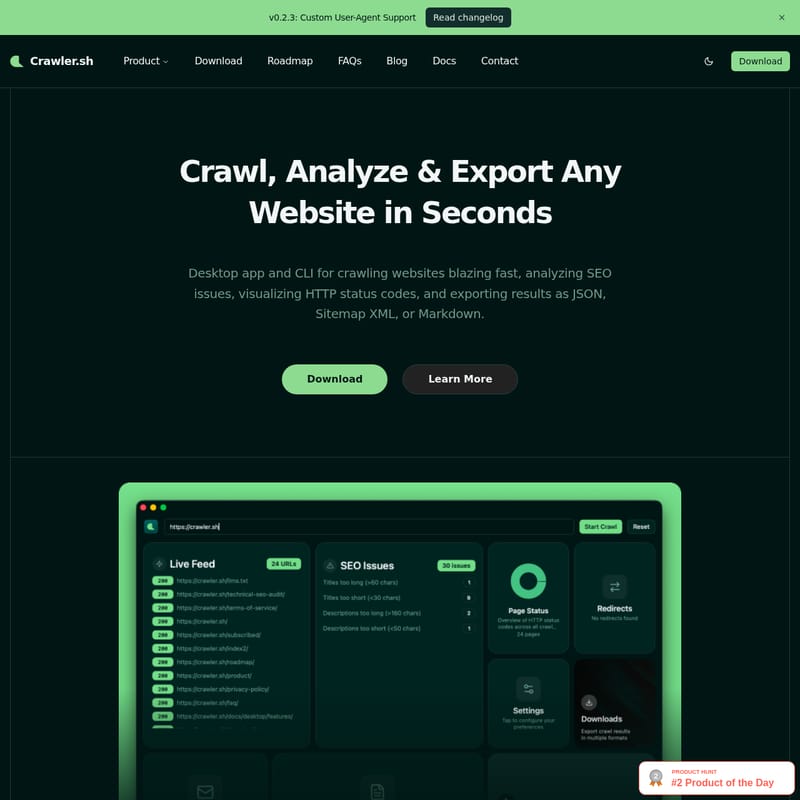

Crawler.sh

Crawler.sh:SEO分析とコンテンツ抽出を高速化するデスクトップアプリ&CLIツール

Crawler.shは、ウェブサイトを数秒でクロール・分析・エクスポートできる高速なデスクトップアプリ兼CLIツールです。16項目のSEO自動チェック、クリーンなMarkdown形式でのコンテンツ抽出、Sitemap XMLやJSONへのエクスポート機能を備え、ローカル環境でプライバシーを保護しながらサイト監視やSEO監査、アーカイブ作成を効率化します。最新のv0.2.3ではカスタムUser-Agentにも対応しています。

2026-03-04

--K

Crawler.sh 製品情報

Crawler.sh:ウェブサイトのクロール・分析・エクスポートを数秒で実現する究極のツール

現代のウェブ開発者やSEO担当者にとって、ウェブサイトの構造と品質を迅速かつ正確に把握することは不可欠です。Crawler.shは、デスクトップアプリとCLI(コマンドラインインターフェース)の両方で提供される強力なツールであり、ウェブサイトのクロール、SEO問題の分析、HTTPステータスコードの可視化、そして多様な形式でのデータエクスポートを驚異的なスピードで実現します。

最新バージョン v0.2.3 では、カスタムUser-Agentのサポートが追加され、より柔軟なクロール設定が可能になりました。Crawler.shは、ローカル環境で動作するプライバシー重視のツールとして、あらゆるウェブワークフローを最適化します。

Crawler.shとは?

Crawler.shは、ウェブサイト全体を数秒でクロールし、SEO上の課題を検出してデータを抽出するためのデスクトップアプリおよびCLIツールです。数千ページに及ぶ大規模なサイトでも、設定可能な同時実行数や深度制限、ポリライトディレイ(クロール間隔)を調整することで、ドメイン内を高速かつ安全にスキャンします。

このツールは、SEO監査、コンテンツのアーカイブ化、サイトマップの生成、サイトモニタリングなど、多岐にわたる用途で活用できるよう設計されています。サブスクリプション一つで、パワフルなCLIツールと直感的なデスクトッププロ版の両方を利用できるのが大きな特徴です。

Crawler.shの主な機能

Crawler.shは、効率的なサイト管理をサポートするための豊富な機能を備えています。

1. 高速なサイトクロール

ドメイン内に留まりながら、サイト全体を数秒でクロールします。同時実行数、クロールの深さの制限、リクエスト間の遅延設定など、詳細なカスタマイズが可能です。

2. コンテンツ抽出とMarkdown変換

あらゆるページからメインの記事コンテンツを抽出し、クリーンなMarkdown形式に自動変換します。各ページの単語数、著者情報、抜粋(エクスcerpt)も同時に取得可能です。

3. 16項目の自動SEO分析

すべてのページに対して以下の項目を含む16の自動チェックを実行します:

- タイトルの欠落

- メタディスクリプションの重複

- noindexディレクティブの検出

- 低品質なコンテンツ(Thin content)の特定

- 長すぎるURLの検出

- HTTPステータスコードの可視化

4. 多彩な出力フォーマット

クロール結果は、NDJSON、JSON、W3C準拠のSitemap XMLなど、ニーズに合わせた形式で出力できます。SEOレポートはCSVまたは人間が読みやすいTXT形式でエクスポート可能です。

Crawler.shの活用シーン(Use Case)

SEO監査(SEO Auditing)

検索順位に悪影響を与える前に、16の自動チェック機能を使用して、タイトル不足や重複した説明文、低品質なコンテンツなどの問題を特定します。

コンテンツのアーカイブ作成(Content Archiving)

ウェブサイトから読み取り可能なコンテンツをクリーンなMarkdownとして抽出します。サイトの移行、バックアップ、または他のツールへのコンテンツ投入に最適です。

サイトマップ生成(Sitemap Generation)

稼働中のサイトのクロール結果から、W3C準拠のSitemap XMLを生成します。手動メンテナンスなしでサイトマップを常に最新の状態に保つことができます。

サイトモニタリング(Site Monitoring)

定期的にサイトをクロールすることで、リンク切れやページの欠落、ステータスコードの変化を早期に発見し、ユーザーが気付く前に修正対応が可能です。

Crawler.shの使い方(How to Use)

Crawler.shは、CLIを通じて簡単に操作を開始できます。以下は基本的なワークフローの例です。

基本的なクロール

デフォルト設定(最大100ページ、深度10)でサイトをクロールする場合:

crawler crawl https://example.com

このコマンドにより、example-com.crawl(NDJSON形式)が出力されます。

高度なワークフロー

- Deep Crawl: 深い階層まで詳細にクロールを実行。

- Inspect Results: クロール結果を精査。

- SEO Report: SEOの問題を自動検出し、レポートを作成。

- Export: 必要なフォーマット(JSONやXML)でエクスポート。

料金プランと仕様

Crawler.shは、年間99ドルでCLIとデスクトップアプリの両方を提供しています。

CLI Tool ($99 / year)

crawl,info,export,seoサブコマンドの利用- NDJSON, JSON, Sitemap XML出力サポート

- Markdown形式のコンテンツ抽出

- 16カテゴリのSEO分析(CSV/TXTエクスポート)

Desktop Pro ($99 / year)

- 8つのインタラクティブカードを備えたビジュアルダッシュボード

- ステータスバッジ付きのリアルタイムクロールフィード

- URLごとの詳細なSEO問題パネル

- Markdownとしてのコンテンツアーカイブエクスポート

FAQ

Q: どのようなエクスポート形式に対応していますか? A: NDJSON、JSON、W3C準拠のSitemap XML、CSV、TXT、そしてコンテンツ抽出用のMarkdownに対応しています。

Q: クロールの速度制限などは設定できますか? A: はい、同時実行数(concurrency)やポリライトディレイ(リクエスト間の遅延)を設定できるため、サーバーに負荷をかけすぎないように調整可能です。

Q: プライバシー面はどうなっていますか? A: Crawler.shはローカルファーストのツールであり、データは自身のマシン上で処理されるため、プライバシーに配慮した運用が可能です。