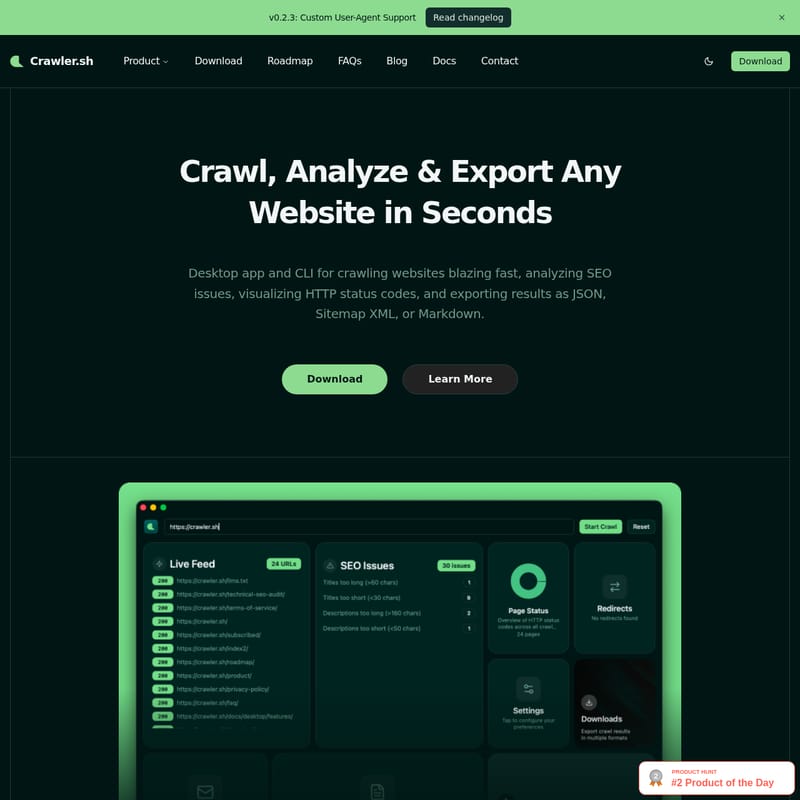

Crawler.sh

Crawler.sh : Solution d'audit SEO et d'extraction de contenu ultra-rapide pour bureaux et CLI

Crawler.sh est une application de bureau et un outil CLI puissant conçu pour crawler, analyser et exporter n'importe quel site web en quelques secondes. Il permet d'effectuer des audits SEO automatisés via 16 vérifications critiques, d'extraire du contenu au format Markdown et de générer des sitemaps XML. Local-first et respectueux de la vie privée, l'outil propose des formats d'exportation variés comme JSON et NDJSON. Que ce soit pour le monitoring de sites, l'archivage de contenu ou l'optimisation technique, Crawler.sh offre une performance exceptionnelle pour les professionnels du web.

2026-03-04

--K

Crawler.sh Informations sur le produit

Crawler.sh : L'Outil Ultime pour Crawler, Analyser et Exporter n'importe quel Site Web

Dans l'univers du référencement naturel, la rapidité et la précision des données sont essentielles. Crawler.sh s'impose comme une solution de pointe, combinant une application de bureau intuitive et une interface en ligne de commande (CLI) robuste. Ce logiciel permet de crawler des sites entiers, d'analyser les problèmes SEO et d'exporter des données structurées en un temps record.

Qu'est-ce que Crawler.sh ?

Crawler.sh est une application hybride (Desktop et CLI) conçue pour le crawling de sites web à haute performance. Contrairement à de nombreux outils basés sur le cloud, Crawler.sh fonctionne localement sur votre machine, garantissant une confidentialité totale et une rapidité d'exécution sans précédent.

Que vous soyez un consultant SEO, un développeur ou un gestionnaire de contenu, Crawler.sh vous permet de scanner des milliers de pages en quelques secondes, de visualiser les codes d'état HTTP et d'extraire le contenu textuel de manière propre et structurée.

Les Fonctionnalités de Crawler.sh

L'outil Crawler.sh regorge de fonctionnalités conçues pour faciliter l'audit technique et la gestion de contenu.

Crawling de Site Ultra-Rapide

Avec Crawler.sh, vous pouvez explorer des sites web complets tout en restant dans le même domaine. Le moteur est conçu pour être à la fois puissant et respectueux :

- Configuration de la concurrence : Ajustez la vitesse de scan selon vos besoins.

- Limites de profondeur : Contrôlez jusqu'où le crawler doit s'aventurer dans l'arborescence.

- Délai de courtoisie : Paramétrez des pauses entre les requêtes pour ne pas surcharger les serveurs.

Analyse SEO Automatisée

Chaque page crawlée par Crawler.sh subit 16 vérifications automatiques. L'outil identifie instantanément :

- Les titres manquants.

- Les descriptions meta dupliquées.

- Les directives "noindex".

- Le contenu pauvre (thin content).

- Les URLs trop longues.

- Et bien d'autres erreurs techniques.

Extraction de Contenu Intelligente

Crawler.sh ne se contente pas de lister des URLs. Il extrait le contenu principal des articles pour le convertir en Markdown propre. Pour chaque page, vous obtenez :

- Le corps du texte lisible.

- Le nombre de mots.

- La signature de l'auteur.

- Un extrait (excerpt) de la page.

Multiples Formats d'Exportation

La flexibilité est au cœur de Crawler.sh. Vous pouvez diffuser les résultats en temps réel au format NDJSON ou exporter les données finales vers :

- JSON (tableaux).

- Sitemap XML conforme aux standards W3C.

- CSV ou TXT pour les rapports SEO destinés aux équipes.

Cas d'Utilisation de Crawler.sh

Audit SEO Technique

Utilisez Crawler.sh pour lancer 16 tests automatisés sur chaque page. C'est l'outil idéal pour détecter les erreurs avant qu'elles n'impactent votre classement dans les moteurs de recherche.

Archivage et Migration de Contenu

Grâce à l'extraction en Markdown, Crawler.sh facilite la migration de sites ou la création de sauvegardes de contenu exploitables pour d'autres outils ou systèmes de gestion de contenu.

Génération de Sitemaps

Maintenez vos fichiers Sitemap XML à jour sans effort manuel. Crawler.sh génère des sitemaps précis basés sur un crawl en direct de votre site web.

Surveillance de Site (Monitoring)

Planifiez des crawls réguliers avec Crawler.sh pour identifier les liens cassés, les pages manquantes ou les changements de codes d'état HTTP avant que vos visiteurs ne les rencontrent.

Comment utiliser Crawler.sh

L'utilisation de Crawler.sh est simple, que vous préfériez l'interface graphique ou la ligne de commande.

Exemple de flux de travail via CLI :

- Crawl de base : Pour scanner un site avec les paramètres par défaut (100 pages, profondeur 10) :

crawler crawl https://exemple.com - Résultat : L'outil génère un fichier

exemple-com.crawlau format NDJSON. - Analyse et Export : Utilisez les sous-commandes

info,exportouseopour traiter vos données.

Utilisation via l'application Desktop Pro :

L'interface Desktop offre un tableau de bord visuel avec 8 cartes interactives, un flux de crawl en temps réel avec des badges de statut et un panneau dédié aux problèmes SEO par URL.

FAQ (Foire Aux Questions)

Q : Quels sont les formats d'exportation supportés par Crawler.sh ? R : Crawler.sh supporte les formats NDJSON, JSON, Sitemap XML, ainsi que le CSV et le TXT pour les rapports d'audit.

Q : L'outil Crawler.sh est-il respectueux de la vie privée ? R : Oui, Crawler.sh est une solution "local-first". Toutes les analyses et les crawls s'exécutent directement sur votre machine, garantissant la confidentialité de vos données.

Q : Quelle est la différence entre la version CLI et la version Pro ? R : Les deux versions sont incluses dans le même abonnement ($99/an). La version CLI est optimisée pour les pipelines de données et les scripts, tandis que la version Desktop Pro offre une interface visuelle avec des tableaux de bord interactifs.

Q : Puis-je configurer l'User-Agent dans Crawler.sh ? R : Oui, depuis la version v0.2.3, Crawler.sh supporte la personnalisation de l'User-Agent.

Q : Combien de vérifications SEO l'outil effectue-t-il ? R : Crawler.sh effectue automatiquement 16 catégories de vérifications SEO sur chaque page crawlée.