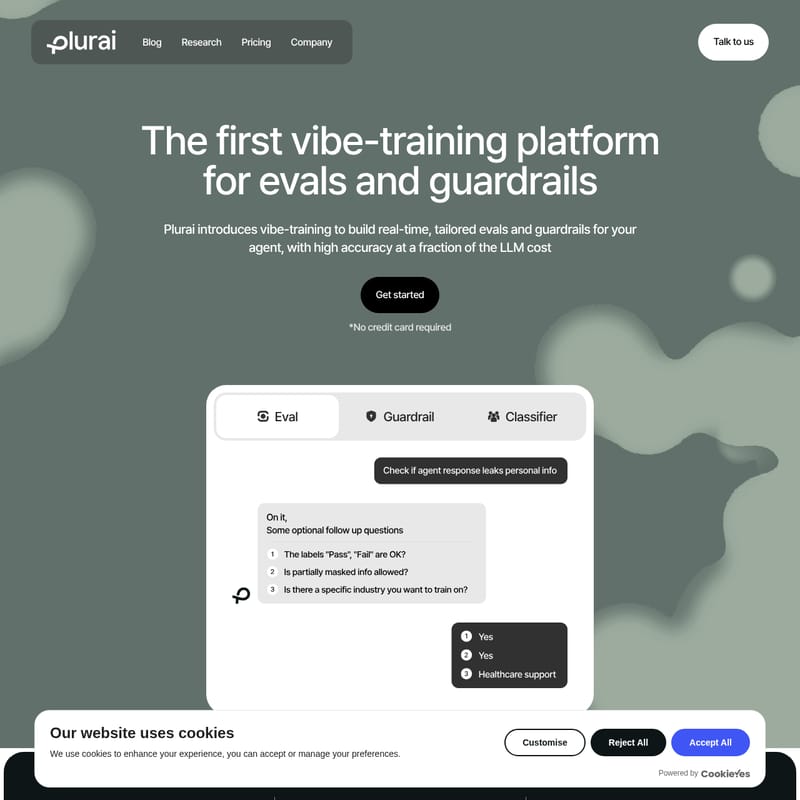

Plurai

Plurai: Plataforma de Vibe-Training para Evals y Guardrails de Agentes de IA con Alta Eficiencia

Descubre Plurai, la primera plataforma de vibe-training diseñada para construir evals y guardrails personalizados en tiempo real. Mejora tus agentes de IA con alta precisión, reduciendo costos significativamente frente a LLMs tradicionales y logrando latencias de inferencia de menos de 100ms.

2026-05-01

--K

Plurai Información del producto

Plurai: La Primera Plataforma de Vibe-Training para Evals y Guardrails

En el dinámico mundo de la inteligencia artificial, la capacidad de evaluar y proteger a los agentes en tiempo real es fundamental para alcanzar un nivel de implementación en el mundo real. Plurai se presenta como la primera plataforma de vibe-training diseñada específicamente para construir evals (evaluaciones) y guardrails (barreras de seguridad) adaptados y en tiempo real para sus agentes. Gracias a un enfoque innovador, Plurai ofrece una precisión excepcional a una fracción del costo de los modelos de lenguaje grandes (LLM) convencionales.

¿Qué es Plurai?

Plurai introduce el concepto de vibe-training para facilitar la creación de evals y guardrails personalizados. Esta plataforma permite que los desarrolladores de IA superen las limitaciones de los enfoques tradicionales de "LLM-as-judge", los cuales suelen ser costosos, lentos y difíciles de escalar a una cobertura de producción completa.

Plurai se especializa en la optimización de modelos de lenguaje pequeños (SLMs), los cuales son entrenados mediante un proceso propietario de calibración de intención. Esto permite que Plurai entienda profundamente las tareas específicas del usuario, generando conjuntos de pruebas de alta calidad y evaluadores consistentes que operan con una eficiencia sin precedentes.

Características Principales de Plurai

La tecnología de Plurai no solo se enfoca en la precisión, sino también en la viabilidad económica y técnica para entornos de producción. Estas son sus características más destacadas:

1. Rendimiento Superior frente a GPT 5.2

Plurai ha demostrado resultados sustancialmente mejores en comparación con modelos líderes del mercado como GPT 5.2:

- Reducción de la tasa de fallos: Logra una reducción de errores superior al 43% en comparación con GPT 5.2.

- Reducción de costos: Ofrece una eficiencia económica de más de 8 veces (8x) respecto a los costos de GPT 5.2.

2. Latencia de Inferencia Ultra Baja

Para aplicaciones que requieren respuestas inmediatas, Plurai garantiza una latencia de inferencia inferior a 100ms. Esto lo convierte en la solución ideal para guardrails en tiempo real que no pueden permitirse retrasos en la experiencia del usuario.

3. Modelos de Lenguaje Pequeños (SLMs) Optimizados

Plurai utiliza SLMs construidos específicamente para las tareas solicitadas. Mediante la generación de datos sintéticos de alta fidelidad, la plataforma puede entrenar evaluadores precisos incluso si el usuario no dispone de conjuntos de datos históricos o etiquetados previamente.

4. Flexibilidad de Implementación

Para las empresas que requieren el máximo control sobre sus datos y seguridad, Plurai ofrece despliegue on-prem dentro de su propia VPC (Nube Privada Virtual). Esto asegura:

- Máxima seguridad de la información.

- Control total sobre los datos.

- Latencias aún más reducidas.

5. Evaluadores Basados en LLM

Aunque los SLMs son ideales para escala y tiempo real, Plurai también ofrece evaluadores optimizados basados en LLM para obtener la máxima precisión en flujos de trabajo de evaluación offline o datos muestreados.

Casos de Uso de Plurai

Los modelos y herramientas de Plurai, incluyendo su producto Proton, pueden aplicarse a una amplia gama de tareas semánticas críticas para el éxito de un agente de IA. Algunos de los casos de uso más comunes incluyen:

- Evaluación de Conversaciones: Analizar la calidad y el flujo de las interacciones entre el agente y el usuario.

- Similitud Semántica: Determinar qué tan cerca está una respuesta generada de los objetivos deseados.

- Validación de Grounding (Anclaje): Asegurar que las respuestas del agente se basen estrictamente en la información proporcionada o permitida.

- Cumplimiento de Políticas (Policy Compliance): Garantizar que el comportamiento del agente se mantenga dentro de los límites éticos y legales definidos por la empresa.

- Clasificadores Personalizados: Crear filtros específicos para detectar intenciones o contenidos no deseados.

"Traiga su agente al nivel del mundo real ahora mismo. Plurai elimina el compromiso entre velocidad y seguridad en su proceso de desarrollo de IA."

Preguntas Frecuentes (FAQ)

¿Cómo utilizo los evals y guardrails en mis agentes?

Puede utilizar los modelos de Plurai en una amplia variedad de tareas semánticas, incluyendo evaluación de conversaciones, similitud semántica, validación de grounding, cumplimiento de políticas y más. Le invitamos a explorar nuestro catálogo de casos de uso para ver todas las posibilidades.

¿En qué se diferencia Plurai de los evals que ya tengo?

Plurai utiliza un proceso propietario de calibración de intención para comprender profundamente su tarea y generar un conjunto de pruebas de alta calidad y un evaluador consistente. Esto permite obtener evals y guardrails de grado de producción impulsados por modelos de lenguaje pequeños (SLMs) optimizados, que son mucho más eficientes en costos y escalables que los enfoques tradicionales de LLM como juez.

¿Se puede implementar de forma local (on-prem)?

Sí, Plurai puede desplegarse en su propia VPC para garantizar la máxima seguridad, control de datos y una latencia aún más baja. Puede contactarnos para discutir sus requisitos de infraestructura y despliegue.

¿Qué hace que sus SLMs sean tan precisos y rentables?

Los SLMs de Plurai están diseñados específicamente para sus tareas mediante nuestro proceso de calibración de intención y generación de datos sintéticos. No requerimos datos etiquetados previos. Si no tiene conjuntos de datos históricos, generamos datos sintéticos de alta fidelidad adaptados a su caso de uso.

Al entrenar y optimizar los evaluadores en conjuntos de datos altamente específicos en lugar de depender de LLMs de propósito general, logramos una alta precisión con una latencia y un costo mucho menores. El resultado es una cobertura de grado de producción que puede ejecutar de forma continua.

¿Solo ofrecen SLMs o tienen otros modelos?

Además de los SLMs creados específicamente, también ofrecemos evaluadores basados en LLM optimizados para obtener la máxima precisión a un costo competitivo. Estos son ideales para datos muestreados y flujos de evaluación fuera de línea. Para pruebas a gran escala o guardrails en tiempo real, los SLMs suelen ser la mejor opción.

¿El producto Proton de Plurai es solo para evals y guardrails?

No, puede utilizar nuestros modelos en una amplia gama de tareas semánticas. Proton y el resto de nuestras herramientas son versátiles para la validación de grounding, similitud semántica y cumplimiento de políticas, entre otros.