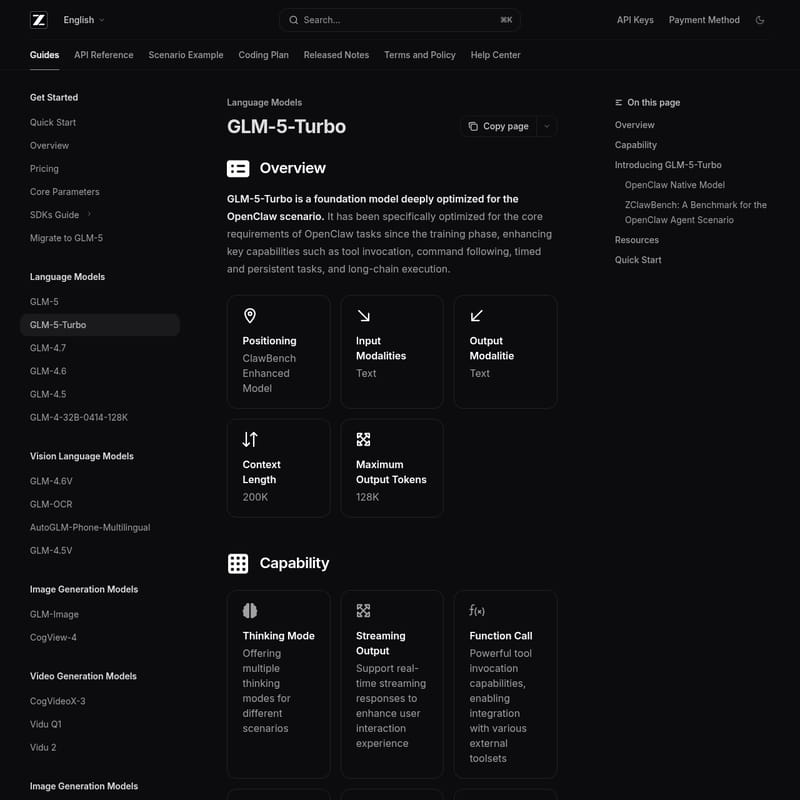

GLM-5-Turbo

GLM-5-Turbo: El Modelo Nativo de OpenClaw para Tareas de Larga Cadena y Ejecución de Herramientas

GLM-5-Turbo es un modelo de lenguaje avanzado y optimizado específicamente para el escenario OpenClaw. Diseñado para flujos de trabajo de agentes complejos, ofrece una ventana de contexto de 200K y capacidades superiores en invocación de herramientas, seguimiento de instrucciones y ejecución de tareas persistentes. Con soporte para pensamiento profundo y salidas estructuradas, GLM-5-Turbo supera los estándares actuales en eficiencia y estabilidad para entornos empresariales y de desarrollo.

2026-03-18

--K

GLM-5-Turbo Información del producto

GLM-5-Turbo: La Revolución de los Modelos Nativos para OpenClaw

En el ecosistema actual de la inteligencia artificial, la capacidad de ejecutar tareas complejas de manera autónoma es fundamental. GLM-5-Turbo se presenta como un modelo fundacional profundamente optimizado para el escenario OpenClaw. Desde su fase de entrenamiento, este modelo ha sido diseñado para satisfacer los requisitos básicos de las tareas de agentes, mejorando capacidades críticas como la invocación de herramientas, el seguimiento de comandos y la ejecución de cadenas largas de razonamiento.

¿Qué es GLM-5-Turbo?

GLM-5-Turbo es un modelo de lenguaje de última generación posicionado como un modelo mejorado para ClawBench. A diferencia de otros modelos genéricos, GLM-5-Turbo es un modelo nativo de OpenClaw, lo que significa que su arquitectura y datos de entrenamiento han sido construidos sistemáticamente basándose en flujos de trabajo de agentes del mundo real.

Con una modalidad de entrada y salida de texto, este modelo destaca por su impresionante longitud de contexto de 200K y una capacidad máxima de salida de 128K tokens, lo que lo hace ideal para procesar volúmenes masivos de información sin perder la coherencia o el rastro de las instrucciones originales.

Características Principales de GLM-5-Turbo

El éxito de GLM-5-Turbo radica en sus capacidades técnicas avanzadas, diseñadas para ofrecer un rendimiento superior en entornos de producción:

- Modo de Pensamiento (Thinking Mode): Ofrece múltiples modos de razonamiento adaptados a diferentes escenarios, permitiendo una resolución de problemas más profunda.

- Salida en Streaming: Soporta respuestas en tiempo real para mejorar la experiencia de interacción del usuario.

- Llamada a Funciones (Function Call): Posee capacidades potentes de invocación de herramientas externas, facilitando la integración con diversos conjuntos de utilidades.

- Caché de Contexto (Context Caching): Implementa un mecanismo inteligente de almacenamiento en caché para optimizar el rendimiento en conversaciones extensas.

- Salida Estructurada: Soporta formatos como JSON, lo que facilita la integración directa con sistemas y aplicaciones de software.

- Integración MCP: Permite integrar de forma flexible herramientas externas de MCP y fuentes de datos para expandir los casos de uso.

Capacidades Avanzadas y OpenClaw

La optimización de GLM-5-Turbo se centra en cuatro pilares fundamentales que lo distinguen de sus predecesores:

1. Invocación de Herramientas Precisa

El modelo ha fortalecido su capacidad para llamar a herramientas externas y habilidades variadas. Esto garantiza una mayor estabilidad y fiabilidad en tareas de múltiples pasos, permitiendo que las tareas de OpenClaw pasen del simple diálogo a la ejecución efectiva.

2. Seguimiento de Instrucciones Complejas

Demuestra una comprensión y descomposición superior de instrucciones multicapa. GLM-5-Turbo puede identificar objetivos con precisión, planificar pasos intermedios y apoyar la división de tareas colaborativas entre múltiples agentes.

3. Tareas Programadas y Persistentes

Optimizado para escenarios que involucran disparadores programados y ejecución continua. El modelo entiende mejor las dimensiones temporales y mantiene la continuidad de la ejecución durante tareas complejas y prolongadas.

4. Cadenas Largas de Alto Rendimiento

Para tareas que requieren un alto flujo de datos y cadenas lógicas extensas (conocidas como tareas Lobster), GLM-5-Turbo mejora la eficiencia y la estabilidad de la respuesta, siendo apto para flujos de trabajo empresariales reales.

Casos de Uso (Use Case)

El despliegue de GLM-5-Turbo a través del benchmark ZClawBench ha demostrado su eficacia en diversos sectores:

- Desarrollo de Software: Configuración de entornos y depuración de código mediante agentes autónomos.

- Análisis de Datos y Finanzas: Procesamiento de grandes volúmenes de datos financieros y creación de informes detallados.

- Creación de Contenido: Generación de material complejo y estructurado para expertos en marketing y creadores.

- Operaciones e Ingeniería: Gestión de tareas persistentes y flujos de trabajo automatizados que requieren estabilidad a largo plazo.

Cómo Usar GLM-5-Turbo (Quick Start)

Para comenzar a utilizar GLM-5-Turbo, puede realizar llamadas a través de la API de Z.AI utilizando cURL o los SDK oficiales. Aquí tiene un ejemplo de una llamada básica:

Nota: Reemplace

your-api-keycon su clave de API real.

curl -X POST "https://api.z.ai/api/paas/v4/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer your-api-key" \

-d '{

"model": "glm-5-turbo",

"messages": [

{

"role": "user",

"content": "Como experto en marketing, crea un eslogan atractivo para mi producto."

},

{

"role": "user",

"content": "Z.AI Open Platform"

}

],

"thinking": {

"type": "enabled"

},

"max_tokens": 4096,

"temperature": 1.0

}'

Preguntas Frecuentes (FAQ)

¿Qué hace que GLM-5-Turbo sea diferente de GLM-5? GLM-5-Turbo ofrece mejoras sustanciales en escenarios OpenClaw, superando a GLM-5 y a otros modelos líderes en categorías clave de tareas gracias a su entrenamiento específico en flujos de trabajo de agentes.

¿Cuál es el límite de tokens de este modelo? El modelo soporta una longitud de contexto de hasta 200,000 tokens y puede generar hasta 128,000 tokens de salida.

¿Qué es ZClawBench? Es un benchmark de extremo a extremo diseñado específicamente para evaluar tareas de agentes en el ecosistema OpenClaw, basado en el análisis de casos de uso reales como la recuperación de información y el desarrollo de software.

¿Soporta salidas en formato JSON? Sí, el modelo cuenta con soporte nativo para Salida Estructurada (JSON), facilitando su integración técnica.