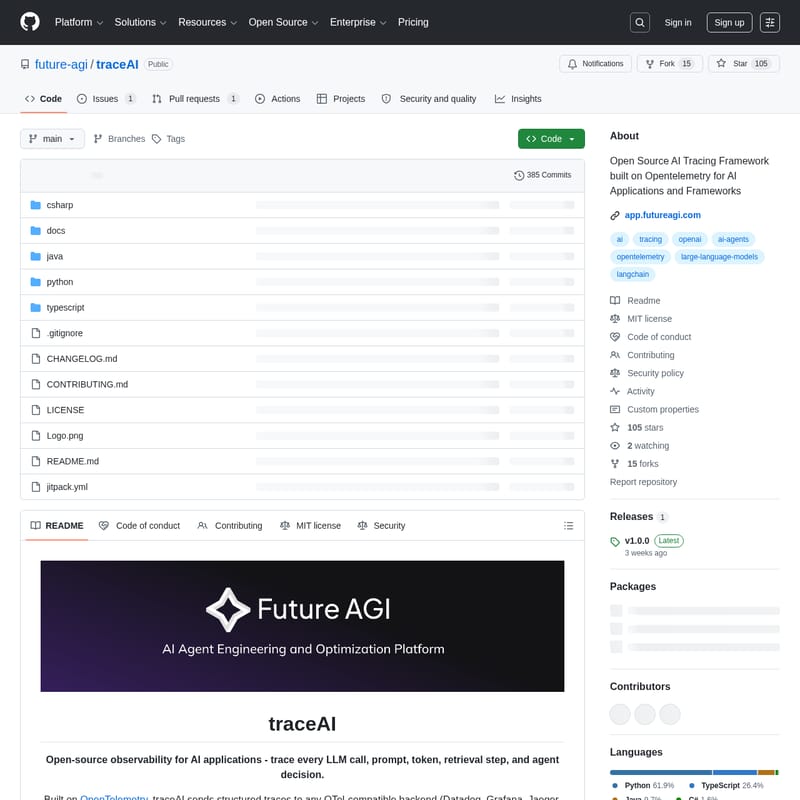

traceAI

traceAI: Open-Source AI-Observability-Framework basierend auf OpenTelemetry für umfassendes Tracing von KI-Anwendungen.

traceAI ist eine leistungsstarke Open-Source-Bibliothek für Entwickler, die volle Transparenz in ihre KI-Anwendungen bringen möchten. Durch die Nutzung von OpenTelemetry ermöglicht traceAI das detaillierte Tracking von LLM-Aufrufen, Prompts, Token-Verbrauch und Agenten-Entscheidungen. Mit Unterstützung für über 50 Frameworks in Python, TypeScript, Java und C# lässt es sich nahtlos in bestehende Observability-Backends wie Grafana, Jaeger oder Datadog integrieren, ohne dass neue Dashboards oder Anbieter erforderlich sind.

2026-04-03

534773.1K

traceAI Produktinformationen

traceAI: Open-Source Observability für Ihre KI-Anwendungen

In der modernen Softwareentwicklung ist Transparenz der Schlüssel zum Erfolg, insbesondere bei der Arbeit mit künstlicher Intelligenz. traceAI ist ein führendes Open-Source-Framework, das speziell für die Überwachung und das Tracing von KI-Anwendungen entwickelt wurde. Mit traceAI erhalten Entwickler tiefe Einblicke in jeden einzelnen LLM-Aufruf, Prompt, Token-Verbrauch und jede Entscheidung eines KI-Agenten.

Da traceAI auf dem Industriestandard OpenTelemetry (OTel) basiert, können strukturierte Traces direkt an Ihre bestehenden Backends wie Datadog, Grafana, Jaeger oder Future AGI gesendet werden. Sie benötigen keinen neuen Anbieter und kein zusätzliches Dashboard – Ihre KI-Telemetriedaten leben dort, wo auch Ihre restlichen Anwendungsdaten gespeichert sind.

Was ist traceAI?

traceAI ist eine Open-Source-Bibliothek, die Ihnen volle Sichtbarkeit in Ihre KI-Ökosysteme verschafft. Es fungiert als Bindeglied zwischen komplexen KI-Workflows und etablierten Observability-Tools. Das Tool erfasst nicht nur einfache Anfragen, sondern bietet eine detaillierte Aufschlüsselung von:

- Sämtlichen LLM-Aufrufen und Antworten.

- Verwendeten Prompts und deren Vervollständigungen.

- Präzisen Token-Zählungen (Input, Output und Gesamt).

- Allen Schritten innerhalb einer Retrieval-Kette.

- Entscheidungen und Werkzeugaufrufen von KI-Agenten.

Durch die Integration von traceAI nutzen Sie semantische Konventionen für LLMs, Vektordatenbanken und Agenten-Frameworks, was eine standardisierte Analyse über verschiedene Programmiersprachen wie Python, TypeScript, Java und C# hinweg ermöglicht.

Features von traceAI

Die Plattform bietet eine Vielzahl an Funktionen, die sie zur ersten Wahl für produktionsreife KI-Observability machen:

- Standardisiertes Tracing: Bildet KI-Workflows auf konsistente OpenTelemetry-Spans und Attribute ab.

- Zero-Config Setup: Ermöglicht eine Drop-in-Instrumentierung mit minimalen Codeänderungen.

- Multi-Framework-Unterstützung: Über 50 Integrationen für populäre Tools wie LangChain, LlamaIndex, OpenAI, Anthropic und viele mehr.

- Anbieterunabhängig: Kompatibel mit jedem OTel-kompatiblen Backend (Vendor Agnostic).

- Reichhaltiger Kontext: Erfasst Metadaten wie Temperatur,

top_p, Modellparameter und detaillierte Fehlerkontexte. - Produktionsbereit: Optimiert für hohe Performance durch asynchrone Unterstützung und Streaming-Tracking.

Use Case: Warum traceAI einsetzen?

traceAI eignet sich hervorragend für verschiedene Einsatzszenarien in der KI-Entwicklung:

- Fehlerbehebung (Debugging): Wenn ein Agent eine falsche Entscheidung trifft, hilft traceAI, den exakten Schritt in der Kette zu identifizieren, der zum Fehler geführt hat.

- Kostenkontrolle: Durch das präzise Tracking des Token-Verbrauchs über alle Modelle hinweg können Entwickler ihre Ausgaben optimieren.

- Performance-Optimierung: Analysieren Sie die Latenz jedes einzelnen LLM-Aufrufs oder Retrieval-Schritts, um Engpässe in Ihrer Anwendung zu finden.

- Compliance und Auditierung: Dokumentieren Sie jeden Prompt und jede Antwort für regulatorische Anforderungen oder zur Qualitätsverbesserung.

How to Use: Erste Schritte mit traceAI

Die Integration von traceAI ist denkbar einfach. Hier sind Beispiele für die gängigsten Sprachen:

Python Quickstart

-

Installation:

pip install traceai-openai -

Instrumentierung:

import os from fi_instrumentation import register from traceai_openai import OpenAIInstrumentor import openai # Tracer Provider registrieren trace_provider = register(project_name="meine_ai_app") # OpenAI automatisch instrumentieren OpenAIInstrumentor().instrument(tracer_provider=trace_provider) # OpenAI wie gewohnt nutzen - das Tracing erfolgt automatisch!

TypeScript Quickstart

-

Installation:

npm install @traceai/openai @traceai/fi-core -

Instrumentierung:

import { register } from "@traceai/fi-core"; import { OpenAIInstrumentation } from "@traceai/openai"; import { registerInstrumentations } from "@opentelemetry/instrumentation"; const tracerProvider = register({ projectName: "meine_ai_app" }); registerInstrumentations({ tracerProvider, instrumentations: [new OpenAIInstrumentation()], });

Unterstützte Frameworks und Datenbanken

traceAI bietet eine beeindruckende Kompatibilitätsmatrix für verschiedene Technologien:

- LLM-Provider: OpenAI, Anthropic, Google Vertex AI, AWS Bedrock, Mistral AI, Groq, Ollama, DeepSeek und weitere.

- Agent-Frameworks: LangChain, LlamaIndex, CrewAI, AutoGen, Pydantic AI.

- Vektordatenbanken: Pinecone, ChromaDB, Qdrant, Weaviate, Milvus, MongoDB Atlas, pgvector.

- Tools: Haystack, DSPy, Guardrails AI, Vercel AI SDK.

FAQ - Häufig gestellte Fragen

Muss ich für traceAI ein neues Dashboard verwenden? Nein. traceAI sendet Daten an jedes OpenTelemetry-kompatible Backend, das Sie bereits nutzen, wie zum Beispiel Grafana oder Jaeger.

Welche Sprachen werden unterstützt? Aktuell werden Python, TypeScript, Java und C# unterstützt. Eine Unterstützung für Go ist bereits auf der Roadmap.

Wie wirkt sich traceAI auf die Performance aus? traceAI ist auf Performance optimiert und nutzt asynchrone Prozesse, um die Latenz Ihrer KI-Anwendung so gering wie möglich zu halten.

Ist traceAI wirklich Open Source? Ja, das Projekt steht unter der MIT-Lizenz und lädt die Community zur aktiven Mitarbeit ein.