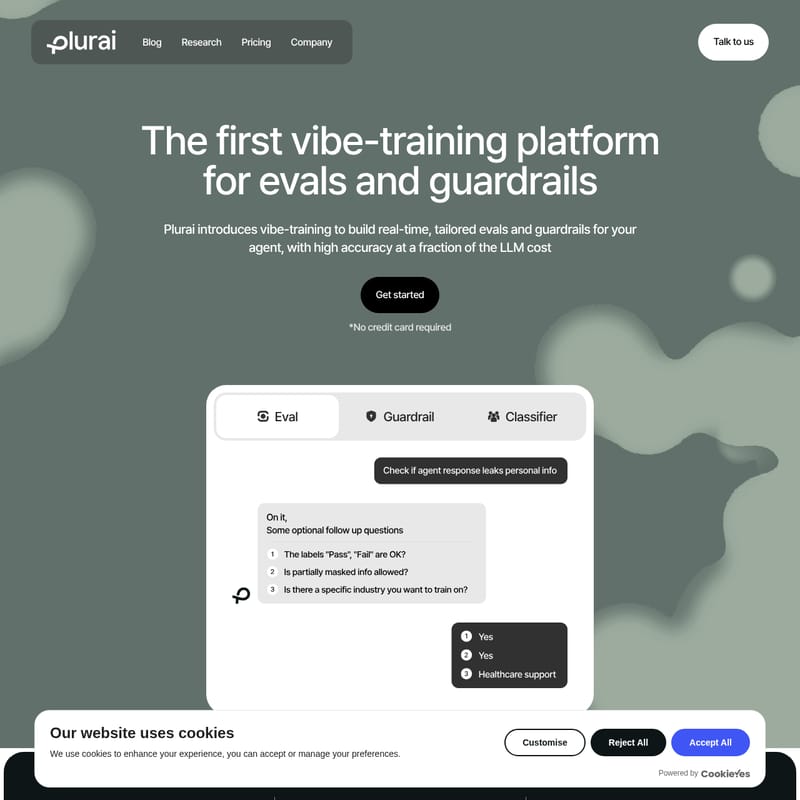

Plurai

Plurai: Die revolutionäre Vibe-Training-Plattform für Evals und Guardrails von KI-Agenten

Plurai ist die erste Plattform für Vibe-Training, die hocheffiziente Evals und Guardrails für KI-Agenten ermöglicht. Durch den Einsatz optimierter Small Language Models (SLMs) bietet Plurai maximale Präzision bei minimalen Kosten und Latenzzeiten.

2026-05-01

--K

Plurai Produktinformationen

Plurai: Die erste Vibe-Training-Plattform für hocheffiziente Evals und Guardrails

In der Welt der künstlichen Intelligenz ist die Sicherheit und Zuverlässigkeit von Agenten entscheidend für den produktiven Einsatz. Plurai stellt hierfür eine bahnbrechende Lösung vor: Die erste Plattform für Vibe-Training, mit der Sie maßgeschneiderte Evals (Evaluierungen) und Guardrails (Schutzmechanismen) in Echtzeit für Ihre KI-Agenten erstellen können. Plurai kombiniert dabei eine extrem hohe Genauigkeit mit einem Bruchteil der Kosten, die bei herkömmlichen Large Language Models (LLMs) anfallen würden.

Was ist Plurai?

Plurai ist eine spezialisierte Plattform, die darauf ausgelegt ist, KI-Agenten auf ein produktionsreifes Niveau zu heben. Der Kern von Plurai liegt im sogenannten Vibe-Training. Dieser innovative Ansatz ermöglicht es Unternehmen, spezifische Evaluatoren und Sicherheitsbarrieren zu entwickeln, die exakt auf die individuellen Anforderungen ihrer Agenten zugeschnitten sind.

Im Gegensatz zu herkömmlichen Methoden setzt Plurai auf Small Language Models (SLMs), die durch einen proprietären Prozess der Intent Calibration optimiert werden. Dies führt dazu, dass die Modelle die Aufgabenstellung tiefgreifend verstehen und konsistente Ergebnisse liefern. Plurai schließt die Lücke zwischen theoretischer KI-Entwicklung und praktischer Anwendungssicherheit, indem es die Geschwindigkeit der Entwicklung erhöht, ohne die Sicherheit zu vernachlässigen.

Die herausragenden Features von Plurai

Plurai bietet eine Reihe technischer Innovationen, die herkömmliche "LLM-as-Judge"-Ansätze übertreffen. Hier sind die wichtigsten Merkmale im Detail:

1. Optimierte Small Language Models (SLMs)

Plurai nutzt zweckgebundene SLMs, die speziell für Ihre Aufgaben trainiert werden. Diese Modelle bieten:

- Hohe Genauigkeit: Vergleichbar oder besser als große Modelle bei spezifischen Aufgaben.

- Kosteneffizienz: Über 8x geringere Kosten im Vergleich zu GPT 5.2.

- Geringe Latenz: Inferenzzeiten von unter 100 ms, ideal für Echtzeitanwendungen.

2. Intent Calibration und synthetische Daten

Einer der größten Vorteile von Plurai ist, dass keine großen Mengen an historischen, gelabelten Daten benötigt werden. Der Prozess umfasst:

- Tiefes Aufgabenverständnis: Durch Intent Calibration versteht das System genau, was evaluiert werden soll.

- Synthetische Datengenerierung: Plurai erzeugt hochpräzise synthetische Datensätze, um Modelle auch ohne vorhandene Datenbanken effektiv zu trainieren.

3. Signifikante Reduzierung der Fehlerraten

Durch den Einsatz von Plurai können Unternehmen die Fehlerraten ihrer KI-Systeme massiv senken. Im Vergleich zu GPT 5.2 erzielt Plurai eine Reduzierung der Fehlerrate um mehr als 43 %.

4. Flexibilität bei der Bereitstellung

Sicherheit und Datenkontrolle stehen bei Plurai an erster Stelle. Daher bietet die Plattform:

- Cloud-Nutzung: Schneller Start ohne Infrastrukturaufwand.

- On-Prem / VPC: Die Möglichkeit, Plurai in Ihrer eigenen Virtual Private Cloud (VPC) zu betreiben, sorgt für maximale Datensicherheit und noch geringere Latenzen.

5. Kombinierte Modell-Ansätze

Neben den SLMs bietet Plurai auch optimierte LLM-basierte Evaluatoren an. Diese eignen sich hervorragend für Offline-Workflows oder Stichprobenanalysen, während SLMs die erste Wahl für großflächige Echtzeit-Evals und Guardrails sind.

Use Case: Vielseitige Einsatzbereiche für Plurai

Die Modelle von Plurai, einschließlich des Produkts Proton, können über ein breites Spektrum semantischer Aufgaben hinweg eingesetzt werden. Zu den wichtigsten Anwendungsfällen gehören:

- Konversationsbewertung (Conversation Evaluation): Überprüfung der Qualität und Relevanz von Chatbot-Interaktionen.

- Semantische Ähnlichkeit (Semantic Similarity): Abgleich von Inhalten auf inhaltliche Übereinstimmung jenseits reiner Keywords.

- Grounding-Validierung (Grounding Validation): Sicherstellung, dass die Antworten eines Agenten auf verifizierten Fakten basieren und keine Halluzinationen enthalten.

- Richtlinienkonformität (Policy Compliance): Echtzeit-Überprüfung, ob die Interaktionen den Unternehmensrichtlinien und rechtlichen Vorgaben entsprechen.

- Echtzeit-Guardrails: Sofortiges Blockieren oder Korrigieren von unsicheren oder unerwünschten KI-Ausgaben.

Durch den Katalog an Anwendungsfällen können Nutzer genau sehen, wie Plurai ihre spezifischen Agenten-Workflows verbessern kann.

FAQ: Häufig gestellte Fragen zu Plurai

Wie verwende ich die Evals und Guardrails für meine Agenten? Sie können unsere Modelle für eine Vielzahl semantischer Aufgaben nutzen, darunter Konversationsbewertung, semantische Ähnlichkeit, Grounding-Validierung, Einhaltung von Richtlinien und mehr. In unserem Use-Case-Katalog finden Sie alle Möglichkeiten im Detail.

Wie unterscheidet sich Plurai von den Evals, die ich bereits habe? Plurai verwendet einen proprietären Intent-Calibration-Prozess, um Ihre Aufgabe tiefgreifend zu verstehen und hochwertige Testsets sowie konsistente Evaluatoren zu generieren. Dies ermöglicht Evals und Guardrails auf Produktionsniveau, die von optimierten Small Language Models (SLMs) angetrieben werden. Diese sind weit kosteneffizienter und skalierbarer als herkömmliche LLM-as-Judge-Ansätze, die oft zu teuer für eine vollständige Produktionsabdeckung sind.

Kann Plurai On-Premise betrieben werden? Ja, Plurai kann in Ihrer VPC (Virtual Private Cloud) bereitgestellt werden. Dies bietet maximale Sicherheit, volle Datenkontrolle und eine noch geringere Latenz. Kontaktieren Sie uns gerne, um Ihre Anforderungen an Infrastruktur und Deployment zu besprechen.

Was macht die SLMs von Plurai so präzise und kosteneffektiv? Unsere SLMs werden durch Intent Calibration und synthetische Datengenerierung gezielt für Ihre Aufgaben entwickelt. Wir benötigen keine vorab gelabelten Daten. Wenn Sie keine historischen Datensätze haben, generieren wir hochgradig passgenaue synthetische Daten für Ihren Anwendungsfall. Durch das Training auf zielgerichteten Datensätzen anstelle von Allzweck-LLMs erreichen wir eine hohe Genauigkeit bei deutlich geringeren Kosten.

Bietet Plurai nur SLMs oder auch andere Modelle an? Neben den spezialisierten SLMs bieten wir auch optimierte LLM-basierte Evaluatoren an, um maximale Genauigkeit bei wettbewerbsfähigen Kosten zu gewährleisten. Diese sind ideal für Offline-Evaluierungen. Für Echtzeit-Guardrails und großflächige Tests sind SLMs aufgrund ihrer Effizienz jedoch meist die bessere Wahl.

Ist das Produkt Proton nur für Evals und Guardrails gedacht? Unsere Modelle, einschließlich Proton, sind vielseitig einsetzbar. Sie decken Aufgaben wie semantische Ähnlichkeit, Grounding-Validierung und Richtlinienkonformität ab. Der Use-Case-Katalog bietet hierzu eine detaillierte Übersicht.

Fazit: Bringen Sie Ihren KI-Agenten auf das nächste Level

Mit Plurai eliminieren Sie den Kompromiss zwischen Geschwindigkeit und Sicherheit in der KI-Entwicklung. Nutzen Sie die Vorteile von Vibe-Training, um hocheffiziente, präzise und kostengünstige Evals und Guardrails zu implementieren. Starten Sie jetzt und erleben Sie, wie Plurai Ihre KI-Infrastruktur transformiert.