GPT‑5.4 mini and nano

GPT-5.4 mini und nano: Hocheffiziente KI-Modelle für Coding, Subagents und Computer-Nutzung von OpenAI.

Entdecken Sie GPT-5.4 mini und nano, die neuesten kleinen Modelle von OpenAI, die für maximale Geschwindigkeit und Effizienz optimiert wurden. Diese Modelle bringen die Stärken von GPT-5.4 in ein kompakteres Format, ideal für rechenintensive Aufgaben wie Programmierung, Datenextraktion und den Einsatz von autonomen Subagents. GPT-5.4 mini bietet eine beeindruckende Steigerung der Rechenleistung gegenüber dem Vorgänger, während GPT-5.4 nano als kostengünstigste Option für einfache Klassifizierungen dient. Mit verbesserter multimodaler Wahrnehmung und starken Benchmarks in SWE-Bench Pro und OSWorld-Verified setzen diese Modelle neue Maßstäbe für das Preis-Leistungs-Verhältnis in der KI-Entwicklung.

2026-03-20

191220.1K

GPT‑5.4 mini and nano Produktinformationen

Einführung in GPT-5.4 mini und GPT-5.4 nano: Die neue Generation effizienter KI-Modelle

OpenAI hat mit der Veröffentlichung von GPT-5.4 mini und GPT-5.4 nano einen bedeutenden Meilenstein in der Entwicklung kompakter Sprachmodelle gesetzt. Diese Modelle sind darauf ausgelegt, die Intelligenz und die Fähigkeiten des großen GPT-5.4-Modells in eine schnellere und kosteneffizientere Form zu bringen. Besonders in Bereichen, in denen Latenz und Durchsatz entscheidend sind, bieten GPT-5.4 mini und GPT-5.4 nano eine überlegene Performance für Entwickler und Unternehmen.

Was ist GPT-5.4 mini und nano?

GPT-5.4 mini und GPT-5.4 nano sind die bisher leistungsfähigsten kleinen Modelle von OpenAI. Sie wurden speziell für Workloads optimiert, bei denen die Antwortzeit (Latenz) das Benutzererlebnis direkt beeinflusst. Während GPT-5.4 mini eine signifikante Verbesserung gegenüber GPT-5 mini darstellt und in Bereichen wie Reasoning, Coding und Tool-Nutzung fast an das große GPT-5.4 heranreicht, ist GPT-5.4 nano die kleinste und günstigste Variante für einfache, hochvolumige Aufgaben.

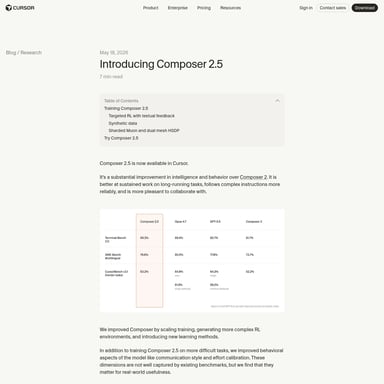

Die wichtigsten Benchmarks im Überblick

Die Leistungsfähigkeit von GPT-5.4 mini zeigt sich deutlich in den aktuellen Evaluationen (bei maximalem Reasoning-Aufwand 'xhigh'):

- SWE-Bench Pro (Public): GPT-5.4 mini erreicht 54,4 % und liegt damit nah an den 57,7 % des Hauptmodells.

- GPQA Diamond: Mit 88,0 % beweist das Modell eine enorme Intelligenz bei wissenschaftlichen Fragen.

- OSWorld-Verified: Hier glänzt GPT-5.4 mini mit 72,1 %, was die starke Fähigkeit zur Computer-Nutzung unterstreicht.

- Terminal-Bench 2.0: GPT-5.4 mini erzielt 60,0 %, ein deutlicher Sprung im Vergleich zu GPT-5 mini (38,2 %).

Features der neuen GPT-5.4 Modelle

Die neuen Modelle zeichnen sich durch eine Reihe von technischen Innovationen und optimierten Funktionen aus:

- Geschwindigkeit und Effizienz: GPT-5.4 mini läuft mehr als doppelt so schnell wie sein Vorgänger GPT-5 mini.

- Multimodale Fähigkeiten: Die Modelle können Bilder in Echtzeit verarbeiten und komplexe Benutzeroberflächen in Screenshots interpretieren.

- Erweitertes Kontextfenster: GPT-5.4 mini unterstützt ein Kontextfenster von 400k Token.

- Vielseitige API-Unterstützung: Integration von Text- und Buildeingaben, Tool-Nutzung, Function Calling sowie Web- und Dateisuche.

- Optimiertes Coding: Herausragende Leistung bei Code-Bearbeitung, Debugging-Loops und Frontend-Generierung.

Use Case: Einsatzgebiete für GPT-5.4 mini und nano

Die Anwendungsbereiche für GPT-5.4 mini und GPT-5.4 nano sind vielfältig und zielen auf maximale Produktivität ab.

1. Coding-Assistenten

Entwickler profitieren von einer extrem niedrigen Latenz. GPT-5.4 mini eignet sich hervorragend für iterative Aufgaben wie die Navigation in Codebasen oder das schnelle Debugging, ohne den Arbeitsfluss durch lange Wartezeiten zu unterbrechen.

2. Einsatz von Subagents

In komplexen Systemen wie Codex kann ein großes Modell (GPT-5.4) die Planung übernehmen, während spezialisierte GPT-5.4 mini Subagents parallele Teilaufgaben ausführen. Dazu gehören:

- Durchsuchen von Codebasen.

- Überprüfung großer Dokumente.

- Verarbeitung unterstützender Dateien.

3. Computer Use (Computer-Nutzung)

GPT-5.4 mini kann visuelle Informationen von Bildschirmen schnell interpretieren, um Aufgaben innerhalb von Software-Oberflächen autonom oder assistierend auszuführen.

4. Datenverarbeitung mit GPT-5.4 nano

Für Aufgaben, bei denen Kosten und Geschwindigkeit an erster Stelle stehen, ist GPT-5.4 nano ideal:

- Klassifizierung von großen Datenmengen.

- Datenextraktion aus unstrukturierten Texten.

- Ranking von Suchergebnissen.

Verfügbarkeit und Preise

GPT-5.4 mini ist ab sofort über die API, in Codex und für ChatGPT-Nutzer (Free und Go via 'Thinking'-Feature) verfügbar. Die Kosten belaufen sich auf 0,75 $ pro 1 Mio. Input-Token und 4,50 $ pro 1 Mio. Output-Token.

GPT-5.4 nano ist exklusiv über die API erhältlich und bietet mit 0,20 $ pro 1 Mio. Input-Token und 1,25 $ pro 1 Mio. Output-Token ein unschlagbares Preis-Leistungs-Verhältnis.

FAQ

Wie schnell ist GPT-5.4 mini im Vergleich zu GPT-5 mini? GPT-5.4 mini läuft mehr als zweimal schneller als das GPT-5 mini Modell und bietet dabei eine deutlich höhere Genauigkeit in Benchmarks wie SWE-Bench Pro.

Kann GPT-5.4 mini Bilder verarbeiten? Ja, GPT-5.4 mini ist ein multimodales Modell und unterstützt sowohl Text- als auch Bildinput über die API.

Was ist der Hauptvorteil von GPT-5.4 nano? GPT-5.4 nano ist das kostengünstigste Modell der GPT-5.4-Familie. Es ist für extrem hohe Volumina bei einfachsten Aufgaben wie Klassifizierung und Ranking optimiert.

Ist GPT-5.4 mini in ChatGPT verfügbar? Ja, Free- und Go-Nutzer können GPT-5.4 mini über das „Thinking“-Feature im Plus-Menü nutzen. Für andere Nutzer dient es als Fallback bei Erreichen des Rate-Limits von GPT-5.4.

„GPT-5.4 mini liefert eine starke End-to-End-Leistung... es erreichte höhere Erfolgsquoten und eine stärkere Quellenzuordnung als das größere GPT-5.4 Modell bei bestimmten Aufgaben.“ — Aabhas Sharma, CTO bei Hebbia.