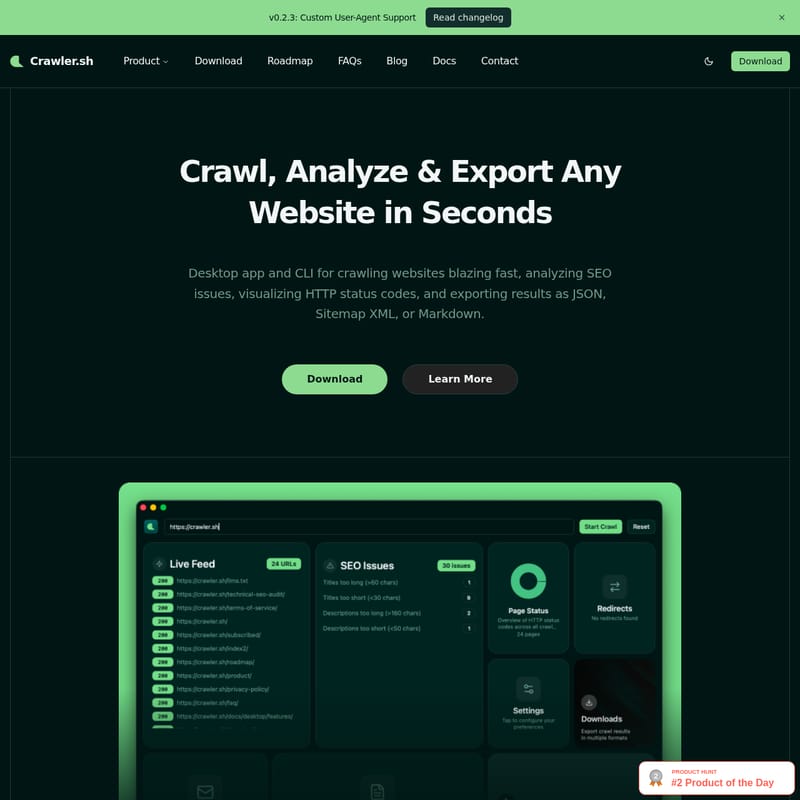

Crawler.sh

Crawler.sh – Highspeed-Web-Crawler für SEO-Analyse, Content-Extraktion und Sitemap-Erstellung

Crawler.sh ist ein leistungsstarkes Tool für Desktop und CLI, das Websites in Sekundenschnelle crawled. Es bietet automatisierte SEO-Audits mit 16 Prüfkategorien, extrahiert Webinhalte direkt als Markdown und ermöglicht Exporte in Formate wie JSON oder Sitemap XML. Ideal für SEO-Experten und Entwickler, die lokale, datenschutzfreundliche Analysen und Content-Archivierungen durchführen möchten.

2026-03-04

--K

Crawler.sh Produktinformationen

Crawler.sh: Websites in Sekundenschnelle crawlen, analysieren und exportieren

In der heutigen digitalen Landschaft ist die Geschwindigkeit und Präzision der Datenanalyse entscheidend. Crawler.sh bietet eine hochperformante Lösung als Desktop-App und CLI-Tool, um Websites blitzschnell zu crawlen, SEO-Probleme zu identifizieren und Ergebnisse in verschiedenen Formaten wie JSON, Sitemap XML oder Markdown zu exportieren.

Was ist Crawler.sh?

Crawler.sh ist ein spezialisiertes Werkzeug für Web-Crawling und SEO-Analyse, das lokal auf Ihrem Rechner läuft. Es wurde entwickelt, um den Prozess der Website-Überprüfung zu automatisieren und dabei maximale Privatsphäre und Geschwindigkeit zu gewährleisten. Ob als leistungsstarkes Kommandozeilen-Tool (CLI) oder als intuitive Desktop-Anwendung mit visuellem Dashboard – Crawler.sh ermöglicht es Ihnen, jede beliebige Website innerhalb einer Domain zu erfassen, HTTP-Statuscodes zu visualisieren und tiefgreifende Analysen durchzuführen.

Das Tool zeichnet sich durch seine Flexibilität aus: Es unterstützt konfigurierbare Parallelität, Tiefenbeschränkungen und höfliche Verzögerungen (Polite Delay) zwischen den Anfragen, um tausende von Seiten effizient zu verarbeiten, ohne die Zielserver zu überlasten.

Funktionen von Crawler.sh

Crawler.sh bietet ein breites Spektrum an Funktionen, die sowohl für technische SEOs als auch für Content-Strategen unverzichtbar sind:

1. Highspeed Site Crawling

Mit Crawler.sh können Sie gesamte Websites in Sekunden erfassen. Das Tool bleibt dabei strikt innerhalb der angegebenen Domain. Sie haben die volle Kontrolle über:

- Konfigurierbare Parallelität: Bestimmen Sie, wie viele Anfragen gleichzeitig verarbeitet werden.

- Tiefenbeschränkung: Legen Sie fest, wie tief der Crawler in die Seitenstruktur vordringen soll.

- Polite Delay: Schonen Sie Serverressourcen durch einstellbare Pausen.

2. Automatisierte SEO-Analyse

Führen Sie 16 automatisierte Prüfungen auf jeder Seite durch. Crawler.sh erkennt kritische Probleme, bevor diese Ihr Ranking beeinträchtigen, darunter:

- Fehlende Seitentitel

- Doppelte Meta-Beschreibungen

- Noindex-Direktiven

- Thin Content (dünner Inhalt)

- Zu lange URLs

- Export der Fehlerberichte als CSV oder TXT.

3. Intelligente Content-Extraktion

Extrahieren Sie den Hauptinhalt jeder Seite als sauberes Markdown. Crawler.sh liefert Ihnen automatisch:

- Den bereinigten Artikelinhalt

- Wortanzahl pro Seite

- Autorenangaben (Byline)

- Exzerpte/Zusammenfassungen

4. Vielfältige Exportformate

Die Datenhoheit liegt bei Ihnen. Exportieren Sie Ergebnisse in Formate wie:

- NDJSON & JSON: Ideal für die Weiterverarbeitung in anderen Tools.

- Sitemap XML: W3C-konforme Sitemaps für Suchmaschinen.

- Markdown: Perfekt für Content-Migrationen.

- CSV & TXT: Für detaillierte SEO-Berichte.

Use Case: Einsatzbereiche von Crawler.sh

Crawler.sh ist für verschiedene professionelle Workflows optimiert:

SEO-Auditing

Nutzen Sie die 16 automatisierten Checks, um technische Fehler auf Ihrer Website aufzuspüren. Identifizieren Sie doppelte Beschreibungen oder fehlende Titel in Echtzeit und verbessern Sie so Ihre On-Page-Optimierung.

Content-Archivierung

Überführen Sie Webinhalte direkt in sauberes Markdown. Dies ist ideal für Backups, Website-Migrationen oder um Content-Pipelines für LLMs (Large Language Models) zu füttern.

Sitemap-Generierung

Erstellen Sie aus einem Live-Crawl automatisch W3C-konforme Sitemap-XML-Dateien. So halten Sie Ihre Sitemaps ohne manuellen Aufwand immer aktuell.

Website-Monitoring

Überwachen Sie Ihre Seite regelmäßig auf kaputte Links (Broken Links), fehlende Seiten oder Änderungen bei den HTTP-Statuscodes, um die User Experience stabil zu halten.

So verwenden Sie Crawler.sh (How to Use)

Die Bedienung von Crawler.sh ist sowohl über die CLI als auch über die Desktop-App denkbar einfach.

Basis-Crawl via CLI

Um einen Standard-Crawl mit 100 Seiten und einer Tiefe von 10 Ebenen zu starten, nutzen Sie folgenden Befehl:

crawler crawl https://example.com

Das Ergebnis wird standardmäßig als example-com.crawl im NDJSON-Format ausgegeben.

Desktop-Anwendung

In der Desktop Pro Version profitieren Sie von einer grafischen Oberfläche:

- Geben Sie die URL in das Dashboard ein.

- Verfolgen Sie den Real-Time-Feed mit Status-Badges.

- Nutzen Sie die 8 interaktiven Karten zur Visualisierung der Daten.

- Exportieren Sie die Ergebnisse über das SEO-Panel direkt nach URL-Details.

FAQ – Häufig gestellte Fragen

Welche Versionen von Crawler.sh gibt es? Es gibt ein CLI-Tool und eine Desktop Pro App. Ein Abonnement deckt beide Versionen ab.

Was kostet Crawler.sh? Sowohl das CLI-Tool als auch die Desktop Pro Version kosten jeweils $99 pro Jahr.

Unterstützt das Tool Custom User-Agents? Ja, seit Version v0.2.3 wird Custom User-Agent Support unterstützt.

Welche SEO-Fehler kann Crawler.sh finden? Das Tool führt 16 Kategorien von Checks durch, darunter Prüfungen auf Thin Content, fehlende Titel, doppelte Meta-Beschreibungen und Noindex-Tags.

Kann ich die Daten in Excel weiterverarbeiten? Ja, SEO-Berichte können als CSV exportiert werden, was einen einfachen Import in Tabellenkalkulationsprogramme ermöglicht.

Ist Crawler.sh datenschutzfreundlich? Ja, Crawler.sh arbeitet lokal auf Ihrer eigenen Maschine (local-first) und ist somit sehr privatsphäre-freundlich.