Loopy

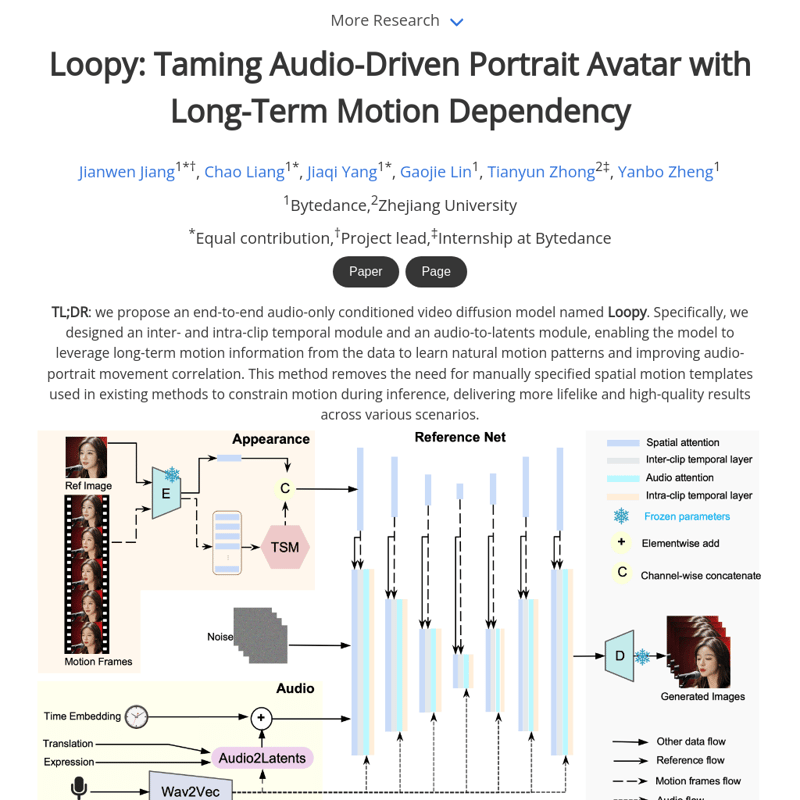

Loopy:長期モーション依存を持つオーディオ駆動のポートレートアバター

Loopyは、音声だけを条件とした映像拡散モデルで、自然な動きと音声の動きの相関を改善します。ユーザーはオーディオに基づいて異なるスタイルでアバターの動きを生成でき、手動での空間運動テンプレートは必要ありません。

2024-09-07

--K

Loopy 製品情報

Loopy: 音声駆動のポートレートアバター

What's Loopy

Loopyは、音声のみを条件としたエンドツーエンドの映像拡散モデルです。このモデルは、長期的なモーション情報を活用して自然な動きのパターンを学習し、音声とポートレートの動きの相関を改善します。音声のみを利用することで、従来の方法では必要とされていた手動で指定された空間運動テンプレートを排除します。これにより、より生々しく、高品質な結果を様々なシナリオで提供します。

Features

鮮明な動きの生成

Loopyは様々な視覚スタイルや音声スタイルをサポートしており、音声のみから非発話的な動きや感情に基づいた眉や目の動き、自然な頭の動きなどを生成します。すべての結果は、参照画像の最初のフレームを使用し、空間条件なしで音声のみを基にしています。

動作の多様性

Loopyは、同一の参照画像に対して異なる音声入力に基づき、動きに適応した合成結果を生成できます。例えば、迅速なものや穏やかなもの、現実的な歌唱パフォーマンスなど多様なスタイルでのアニメーションが可能です。

歌唱の結果

Loopyは、歌唱に特化した追加の結果も表示します。これによって、音声に基づいたアニメーションが一段と進化しています。

その他の映像結果

Loopyは、側面からの入力画像に対しても効果的に対応できます。現実的なポートレートの入力に関しても、高い精度で結果を提供します。

Use Case

Loopyの用途は多岐にわたります。例えば、アニメーションキャラクターの制作や、音声に基づくエンターテインメントコンテンツの作成、さらには教育や研究におけるプレゼンテーションに利用されます。アバターがユーザーの音声にリアルタイムで反応することで、より没入感のある体験を提供します。

FAQ

Loopyはどのように機能しますか?

Loopyは、オーディオから得られる情報を基に動きの合成を行います。独自の時間的モジュールを使って、参考画像の動きを生成します。

どのようなデータが使用されますか?

Loopyは、一般的なデータソースから収集した画像や音声を使用します。すべてのデモで使用される画像と音声は、公開されているソースから取得されています。

私の声でどのようにアバターが反応しますか?

Loopyは、あなたの声の特徴を分析し、それに基づくリアルタイムのアニメーションを生成します。

どんなシナリオに適応しますか?

Loopyは、さまざまなシナリオで高品質な結果を提供できます。歌唱パフォーマンス、会話、感情表現など、多岐にわたる場面での利用が可能です。

倫理的懸念について

この技術の目的は研究に限られており、使用される画像や音声は公共のソースから取得されています。何か懸念がある場合は、私たちにご連絡いただければ、速やかに削除いたします。